太離譜!曝GPT-4o mini沒做安全測試就開慶功會!OpenAI嚴重違背政府協議,被立法者犀利追問12條 原創

編輯 | 伊風

出品 | 51CTO技術棧(微信號:blog51cto)

OpenAI又被曝違約了!這次是違反了對白宮的安全承諾。

去年夏天,OpenAI向美國政府承諾,將嚴格對其前沿的突破性技術進行安全測試,以確保AI不會造成損害,比如教用戶制造生化武器或幫助黑客開發新型網絡攻擊。

然而,為了應對OpenAI領導層設定的GPT-4o mni 5月份的“deadline”。OpenAI的安全團隊中的一些成員感到壓力,并“加快”了對新模型的安全測試過程。

根據三位熟悉情況但因害怕被報復的匿名人士透露,在模型GPT-4o mni的測試開始之前,OpenAI就已經在舉辦產品發布的慶功宴了!員工被邀請在OpenAI的舊金山辦公室中舉辦產品的慶祝派對。

根據其中一個舉報者說:“他們在不知道GPT-4o mni是否安全發布之前就計劃了發布后的派對。”這位人士在匿名討論敏感公司信息時表示:“我們基本上在這個(確保AI安全的)過程中失敗了。”

OpenAI搶發產品也算是老傳統了。此前,OpenAI前董事會成員曾在采訪中透露,奧特曼沒有報告董事會,就直接發布了ChatGPT。而當時的董事會成員甚至是瀏覽X才得到了該消息。

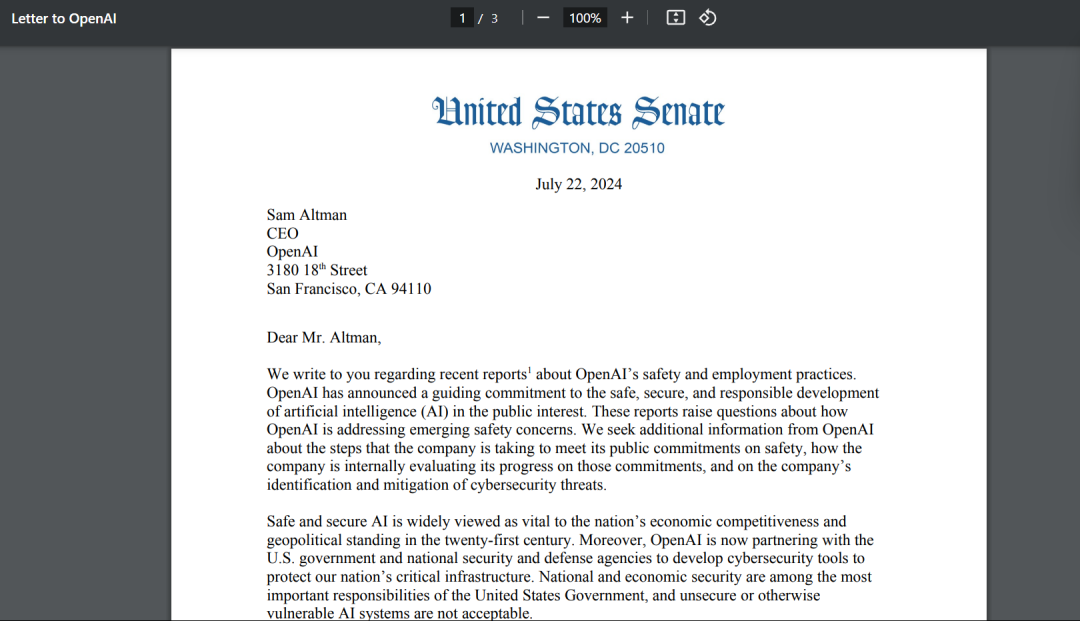

為了能進一步約束OpenAI的安全行為,保障前沿AI巨頭可以將公共安全放在商業利益之上,參議院的民主黨人和一名獨立議員已公開致信奧特曼,犀利質問公司在對待批評者方面的安全標準和實踐。

圖片

圖片

完整文件地址:https://www.schatz.senate.gov/imo/media/doc/letter_to_openai.pdf

這封信件中最重要的部分之一(最先由《華盛頓郵報》獲得)是第9項內容:“OpenAI是否承諾將其下一個基礎模型提供給美國政府機構進行預部署測試、審查、分析和評估?”

信中列出了另外11個需要解決的要點,包括確保OpenAI承諾將其計算能力的20%用于安全研究,以及制定防止惡意行為者或外國對手竊取OpenAI產品的協議。

以下是信中12個問題的完整內容:

1.OpenAI是否計劃遵守其先前公開承諾,將其計算資源的20%用于AI安全研究?

a.如果是,請描述OpenAI已經采取的、正在采取的或將采取的步驟,以將其計算資源的20%用于AI安全研究。

b. 如果不是,OpenAI用于AI安全研究的計算資源比例是多少?

2. 您能否確認貴公司不會對現任和前任員工執行永久性的非貶損協議?

3. 您能否進一步承諾從雇傭協議中刪除任何可能用來懲罰公開提出公司實踐問題的員工的條款,例如防止員工在私人“要約收購”事件中出售其股權的能力?

a. 如果不能,請解釋原因,并說明任何內部保護措施,以確保這些條款不會被用來在經濟上阻止告密者。

4. OpenAI是否有程序讓員工提出有關網絡安全和安全的問題?這些問題提出后如何處理?

a. OpenAI員工是否提出過對公司網絡安全實踐的擔憂?

5. OpenAI現有或計劃實施哪些安全和網絡安全協議,以防止惡意行為者或外國對手竊取AI模型、研究或知識產權?

6. OpenAI供應商行為準則要求您的供應商實施嚴格的非報復政策,并為告密者提供報告問題的渠道,而無需擔心報復。OpenAI本身是否遵循這些做法?

a. 如果是,請描述OpenAI的非報復政策和告密者報告渠道,以及這些渠道向誰報告。

7. OpenAI是否允許獨立專家在發布前測試和評估OpenAI系統的安全性和可靠性?

8. 公司目前是否計劃在其安全和安全測試、評估程序、流程和技術以及治理結構(如其安全和安全委員會)中,邀請獨立專家參與安全和負責任的AI開發?

9. OpenAI是否承諾將其下一個基礎模型提供給美國政府機構進行預部署測試、審查、分析和評估?

10.OpenAI的發布后監控實踐是什么?在最近發布的大型語言模型部署后,您的團隊觀察到了哪些誤用模式和安全風險?這些風險必須達到多大規模,您的監控實踐才有很大可能性捕捉到它們?請分享您的團隊在發布后測量中的經驗教訓,以及為改進您的政策、系統和模型更新而采取的步驟。

11.您計劃向公眾提供已部署模型的回顧性影響評估嗎?

12.請提供有關OpenAI計劃如何實現其對拜登-哈里斯政府的自愿安全和安全承諾的文件。

參考鏈接:

1.https://www.washingtonpost.com/technology/2024/07/12/openai-ai-safety-regulation-gpt4/

2.https://www.schatz.senate.gov/imo/media/doc/letter_to_openai.pdf

本文轉載自??51CTO技術棧??,作者:伊風