從經(jīng)典到創(chuàng)新,揭秘?cái)U(kuò)散模型的6大王牌與5大創(chuàng)新思路 精華

1. 擴(kuò)散模型研究現(xiàn)狀

1.1 定義與基本原理

擴(kuò)散模型是一種深度生成模型,其靈感來源于非平衡熱力學(xué)。它通過定義一個馬爾可夫鏈,逐漸向真實(shí)數(shù)據(jù)中添加隨機(jī)噪聲(前向過程),然后學(xué)習(xí)反向擴(kuò)散過程(逆擴(kuò)散過程),從噪聲中構(gòu)建所需的數(shù)據(jù)樣本。

擴(kuò)散模型包括兩個主要步驟:前向擴(kuò)散過程和反向去噪過程。在前向擴(kuò)散過程中,模型逐步向數(shù)據(jù)添加噪聲,直到數(shù)據(jù)完全轉(zhuǎn)化為噪聲;在反向去噪過程中,模型從純噪聲開始,逐步去除噪聲,恢復(fù)出真實(shí)的數(shù)據(jù)樣本。

1.2 發(fā)展歷程與里程碑

擴(kuò)散模型的研究可以追溯到2015年,Sohl-Dickstein等人首次提出了基于非平衡熱力學(xué)的生成模型框架。然而,直到2020年,Ho等人提出的去噪擴(kuò)散概率模型(DDPM)在圖像生成領(lǐng)域取得了突破性進(jìn)展,使得擴(kuò)散模型開始受到廣泛關(guān)注。此后,擴(kuò)散模型的研究迅速發(fā)展,出現(xiàn)了多種改進(jìn)和創(chuàng)新策略,如DDIM、Score-based模型等。2021年,OpenAI發(fā)布的DALL-E和DALL-E 2進(jìn)一步推動了擴(kuò)散模型在文本到圖像生成領(lǐng)域的應(yīng)用。2022年,Stable Diffusion的開源使得擴(kuò)散模型在藝術(shù)創(chuàng)作和內(nèi)容生成領(lǐng)域得到了廣泛應(yīng)用。

2. 經(jīng)典擴(kuò)散模型

2.1 DDPM

去噪擴(kuò)散概率模型(DDPM)是擴(kuò)散模型領(lǐng)域的奠基之作,由Ho等人于2020年提出。DDPM通過定義一個馬爾可夫鏈,逐步向數(shù)據(jù)添加噪聲,然后學(xué)習(xí)逆向去噪過程,從而生成高質(zhì)量的圖像樣本。DDPM在圖像生成任務(wù)中取得了突破性進(jìn)展,其生成的圖像質(zhì)量在多個基準(zhǔn)數(shù)據(jù)集上超越了當(dāng)時的生成對抗網(wǎng)絡(luò)(GANs)。DDPM的成功主要?dú)w功于其獨(dú)特的訓(xùn)練策略和對噪聲過程的精確建模,為后續(xù)擴(kuò)散模型的研究奠定了基礎(chǔ)。

2.2 Score-based SDE

基于分?jǐn)?shù)的隨機(jī)微分方程(Score-based SDE)模型由Song等人提出,該模型通過學(xué)習(xí)數(shù)據(jù)分布的梯度(即分?jǐn)?shù))來指導(dǎo)擴(kuò)散過程。與傳統(tǒng)的擴(kuò)散模型不同,Score-based SDE不需要顯式地建模噪聲過程,而是通過估計(jì)數(shù)據(jù)分布的分?jǐn)?shù)來實(shí)現(xiàn)去噪。這種方法在理論上更加靈活,能夠更好地捕捉數(shù)據(jù)的復(fù)雜結(jié)構(gòu)和分布特征。Score-based SDE在圖像合成、風(fēng)格遷移等任務(wù)中表現(xiàn)出色,其生成的樣本具有更高的多樣性和真實(shí)性。

2.3 SDE-based Diffusion

基于隨機(jī)微分方程(SDE-based)的擴(kuò)散模型將擴(kuò)散過程建模為一個連續(xù)的隨機(jī)過程,通過求解隨機(jī)微分方程來生成數(shù)據(jù)樣本。與傳統(tǒng)的離散擴(kuò)散模型相比,SDE-based擴(kuò)散模型能夠更自然地描述數(shù)據(jù)的動態(tài)變化過程,具有更好的理論基礎(chǔ)和更高的生成效率。該模型在處理高維數(shù)據(jù)和復(fù)雜分布時具有優(yōu)勢,已在圖像生成、視頻合成等領(lǐng)域取得了顯著成果。

2.4 Denoising Diffusion Probabilistic Models

去噪擴(kuò)散概率模型(Denoising Diffusion Probabilistic Models)是DDPM的改進(jìn)版本,由Nichol和Dhariwal于2021年提出。該模型在DDPM的基礎(chǔ)上引入了多種優(yōu)化策略,如改進(jìn)的噪聲調(diào)度、更靈活的網(wǎng)絡(luò)架構(gòu)等,進(jìn)一步提升了生成性能和效率。Denoising Diffusion Probabilistic Models在多個圖像生成任務(wù)中取得了新的突破,其生成的圖像質(zhì)量達(dá)到了新的高度。

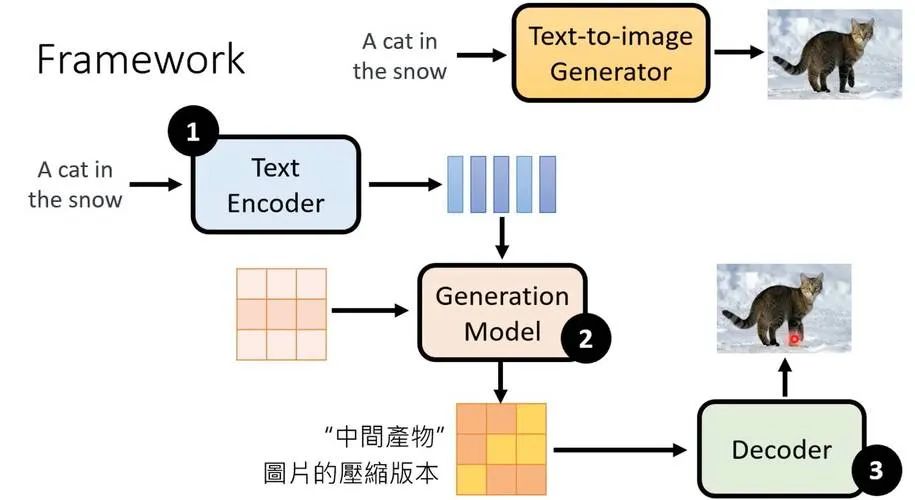

2.5 Latent Diffusion Models

潛在擴(kuò)散模型(Latent Diffusion Models)由Rombach等人提出,該模型通過在潛在空間中進(jìn)行擴(kuò)散過程來生成數(shù)據(jù)。與在像素空間中進(jìn)行擴(kuò)散的傳統(tǒng)模型相比,潛在擴(kuò)散模型能夠更高效地捕捉數(shù)據(jù)的高級特征和語義信息。該模型在圖像生成、圖像修復(fù)等任務(wù)中表現(xiàn)出色,能夠生成具有豐富細(xì)節(jié)和高度一致性的圖像樣本。

2.6 Guided Diffusion

引導(dǎo)擴(kuò)散模型(Guided Diffusion)通過引入額外的條件信息來引導(dǎo)擴(kuò)散過程,從而實(shí)現(xiàn)對生成樣本的精確控制。該模型在文本到圖像生成、圖像修復(fù)等任務(wù)中具有重要應(yīng)用,能夠根據(jù)給定的條件生成符合要求的數(shù)據(jù)樣本。引導(dǎo)擴(kuò)散模型的成功在于其能夠?qū)U(kuò)散過程與條件信息相結(jié)合,實(shí)現(xiàn)對生成過程的靈活控制。

3. 擴(kuò)散模型的創(chuàng)新策略

3.1 采樣速度優(yōu)化

為了提高擴(kuò)散模型的采樣效率,研究人員提出了多種高效采樣策略,包括SDE求解器、ODE求解器等。這些方法通過優(yōu)化采樣步驟,減少了計(jì)算成本,提高了生成速度。

- SDE求解器:通過引入隨機(jī)微分方程(SDE)求解器,研究人員能夠在減少采樣步驟的同時保持高質(zhì)量的生成效果。例如,Song等人提出的SDE求解器在CIFAR-10數(shù)據(jù)集上實(shí)現(xiàn)了9.89的Inception分?jǐn)?shù)和2.20的FID分?jǐn)?shù)。

- ODE求解器:常微分方程(ODE)求解器通過確定性的方法進(jìn)行采樣,進(jìn)一步提高了采樣效率。Chen等人提出的ODE求解器在ImageNet數(shù)據(jù)集上取得了新的最先進(jìn)的生成質(zhì)量,F(xiàn)ID分?jǐn)?shù)為3.85。

- 高階數(shù)值方法:如UniPC等高階數(shù)值方法,通過優(yōu)化時間步長,顯著提高了圖像生成性能。例如,優(yōu)化時間步長的采樣方法在CIFAR-10和ImageNet等數(shù)據(jù)集上顯著提高了圖像生成性能。

3.2 模型結(jié)構(gòu)改進(jìn)

擴(kuò)散模型的結(jié)構(gòu)改進(jìn)主要集中在優(yōu)化網(wǎng)絡(luò)架構(gòu)和引入新的模塊,以提高模型的生成質(zhì)量和效率。

- 擴(kuò)散Transformer模型:通過引入擴(kuò)散Transformer模型,研究人員在去噪擴(kuò)散步驟的早期階段減少了查詢-鍵交互的顯著冗余,提高了生成效率。該方法在CIFAR-10數(shù)據(jù)集上實(shí)現(xiàn)了2.01的最先進(jìn)FID分?jǐn)?shù)。

- 多解碼器架構(gòu):多解碼器架構(gòu)通過將時間間隔分割成多個階段,并在每個階段使用定制的多解碼器U-Net架構(gòu),提高了訓(xùn)練和采樣效率。例如,新的多階段框架在CIFAR-10和CelebA數(shù)據(jù)集上顯著提高了生成質(zhì)量和效率。

- 門控狀態(tài)空間模型(SSM):DIFFUSSM通過避免全局壓縮來有效處理更高分辨率的圖像,從而在整個擴(kuò)散過程中保留詳細(xì)的圖像表示。該方法在ImageNet和LSUN數(shù)據(jù)集上表現(xiàn)出色,顯著減少了總的FLOP使用。

3.3 多模態(tài)信息融合

擴(kuò)散模型在多模態(tài)學(xué)習(xí)任務(wù)中展現(xiàn)出強(qiáng)大的應(yīng)用潛力。通過結(jié)合文本、圖像、音頻等多種模態(tài)數(shù)據(jù),研究人員提高了模型的生成能力,拓展了應(yīng)用場景。

- 多模態(tài)擴(kuò)散模型:如Versatile Diffusion,通過整合文本和圖像的多模態(tài)擴(kuò)散模型,利用CLIP獲取文本和圖像上下文信息,實(shí)現(xiàn)了圖像到文本、文本到圖像等多模態(tài)生成任務(wù)。

- 多模態(tài)融合擴(kuò)散模型:Diff-IF提出了一種新的具有融合知識先驗(yàn)的多模態(tài)融合擴(kuò)散模型,通過融合先驗(yàn)構(gòu)建和最優(yōu)先驗(yàn)搜索技術(shù),解決了現(xiàn)有擴(kuò)散模型在多模態(tài)圖像融合中的缺乏GT限制。

- 多模態(tài)傳感器數(shù)據(jù)融合:DifFUSER架構(gòu)通過處理多模態(tài)傳感器數(shù)據(jù),實(shí)現(xiàn)更精細(xì)的特征對齊和噪聲處理,提高了模型在傳感器故障或數(shù)據(jù)缺失情況下的魯棒性。

3.4 數(shù)據(jù)增強(qiáng)與生成

擴(kuò)散模型在數(shù)據(jù)增強(qiáng)與生成方面也取得了顯著進(jìn)展,通過生成高質(zhì)量的數(shù)據(jù)樣本,提高了模型的泛化能力和魯棒性。

- 數(shù)據(jù)增強(qiáng)策略:如DataDream,通過少量真實(shí)樣本合成更符合實(shí)際數(shù)據(jù)分布的分類數(shù)據(jù)集,提高了下游圖像分類任務(wù)的性能。

- 生成少數(shù)樣本:Self-Guided Generation框架通過生成那些在數(shù)據(jù)流形低密度區(qū)域的少樣本,提高了模型在低概率區(qū)域的生成能力。

- 創(chuàng)意生成:ProCreate通過在生成過程中引入?yún)⒖紙D像集,并積極地引導(dǎo)生成圖像的嵌入,增加了樣本的多樣性和創(chuàng)新性。

3.5 可解釋性與可控性增強(qiáng)

為了提高擴(kuò)散模型的可解釋性和可控性,研究人員提出了多種方法,包括逆方差學(xué)習(xí)、特殊結(jié)構(gòu)數(shù)據(jù)建模等。

- 逆方差學(xué)習(xí):通過精確估計(jì)最優(yōu)逆方差,提高了模型的似然估計(jì)準(zhǔn)確性,提升了生成質(zhì)量。

- 特殊結(jié)構(gòu)數(shù)據(jù)建模:如流形結(jié)構(gòu)數(shù)據(jù)建模、置換不變圖生成模型等,提高了擴(kuò)散模型在特殊數(shù)據(jù)上的生成能力。

- 分布引導(dǎo)去偏置:通過分布引導(dǎo)方法,強(qiáng)制生成的圖像遵循指定的屬性分布,減少了模型在生成圖像中的偏差,提高了公平性。

4. 擴(kuò)散模型的挑戰(zhàn)與機(jī)遇

4.1 計(jì)算資源需求

擴(kuò)散模型在訓(xùn)練和推理過程中對計(jì)算資源的需求較高,這主要體現(xiàn)在以下幾個方面:

- 顯存占用大:擴(kuò)散模型通常需要處理大量的數(shù)據(jù)和復(fù)雜的網(wǎng)絡(luò)結(jié)構(gòu),導(dǎo)致顯存占用較大。例如,在訓(xùn)練高分辨率圖像生成模型時,需要存儲大量的中間特征圖和梯度信息,顯存需求可達(dá)數(shù)十GB甚至上百GB。這要求研究人員必須使用具有大顯存的高端顯卡,如NVIDIA A100等,否則可能會出現(xiàn)顯存不足導(dǎo)致訓(xùn)練中斷的情況。

- 訓(xùn)練時間長:擴(kuò)散模型的訓(xùn)練過程通常需要大量的迭代步驟,每個步驟都需要進(jìn)行復(fù)雜的計(jì)算。例如,DDPM模型在訓(xùn)練時需要進(jìn)行上千步的迭代,每一步都要更新模型參數(shù),這使得整個訓(xùn)練過程可能需要數(shù)天甚至數(shù)周的時間。此外,為了獲得更好的生成效果,研究人員往往需要進(jìn)行多次訓(xùn)練和調(diào)試,進(jìn)一步增加了計(jì)算資源的消耗。

- 采樣效率低:在生成樣本時,擴(kuò)散模型需要進(jìn)行多次采樣,每次采樣都需要運(yùn)行整個模型。例如,DDPM在生成一張圖像時可能需要進(jìn)行1000步采樣,每一步都要進(jìn)行去噪操作,這使得采樣效率較低。雖然一些改進(jìn)方法如DDIM和PLMS等可以加速采樣過程,但在處理大規(guī)模數(shù)據(jù)集或高分辨率圖像時,采樣效率仍然是一個挑戰(zhàn)。

4.2 模型穩(wěn)定性和魯棒性

擴(kuò)散模型在訓(xùn)練和應(yīng)用過程中面臨著穩(wěn)定性和魯棒性的挑戰(zhàn):

- 訓(xùn)練不穩(wěn)定:擴(kuò)散模型的訓(xùn)練過程容易受到各種因素的影響,導(dǎo)致訓(xùn)練不穩(wěn)定。例如,在訓(xùn)練過程中,如果噪聲調(diào)度不合理或模型參數(shù)設(shè)置不當(dāng),可能會出現(xiàn)梯度爆炸或梯度消失的問題。這會導(dǎo)致模型無法正常收斂,生成的樣本質(zhì)量下降,甚至出現(xiàn)訓(xùn)練失敗的情況。此外,擴(kuò)散模型對數(shù)據(jù)的分布和質(zhì)量也有較高的要求,如果數(shù)據(jù)存在異常值或分布不均勻,也可能影響模型的穩(wěn)定性。

- 對輸入數(shù)據(jù)敏感:擴(kuò)散模型對輸入數(shù)據(jù)的變化較為敏感,容易受到噪聲和擾動的影響。例如,在圖像生成任務(wù)中,如果輸入的噪聲數(shù)據(jù)存在微小的變化,可能會導(dǎo)致生成的圖像出現(xiàn)較大的差異。這使得模型在面對實(shí)際應(yīng)用中的復(fù)雜數(shù)據(jù)時,可能無法保持穩(wěn)定的性能表現(xiàn)。此外,擴(kuò)散模型在處理具有長程依賴關(guān)系的數(shù)據(jù)時,也容易受到數(shù)據(jù)中噪聲的干擾,導(dǎo)致生成結(jié)果的準(zhǔn)確性和一致性下降。

- 泛化能力有限:盡管擴(kuò)散模型在訓(xùn)練數(shù)據(jù)上能夠生成高質(zhì)量的樣本,但其泛化能力仍然有限。在面對與訓(xùn)練數(shù)據(jù)分布差異較大的數(shù)據(jù)時,模型的生成效果可能會顯著下降。例如,在文本到圖像生成任務(wù)中,如果輸入的文本描述與訓(xùn)練數(shù)據(jù)中的文本差異較大,生成的圖像可能無法準(zhǔn)確反映文本內(nèi)容,甚至出現(xiàn)與文本無關(guān)的圖像。這限制了擴(kuò)散模型在多樣化應(yīng)用場景中的應(yīng)用范圍。

4.3 數(shù)據(jù)隱私與倫理問題

擴(kuò)散模型在數(shù)據(jù)隱私和倫理方面也面臨著一些挑戰(zhàn):

- 數(shù)據(jù)泄露風(fēng)險:擴(kuò)散模型在訓(xùn)練過程中需要大量的數(shù)據(jù),如果數(shù)據(jù)中包含敏感信息,可能會導(dǎo)致數(shù)據(jù)泄露的風(fēng)險。例如,一些研究表明,擴(kuò)散模型可能會從訓(xùn)練數(shù)據(jù)中記憶并復(fù)現(xiàn)特定的圖像。這意味著,如果訓(xùn)練數(shù)據(jù)中包含個人隱私信息,如人臉圖像等,模型在生成樣本時可能會泄露這些隱私信息,引發(fā)隱私保護(hù)問題。

- 生成內(nèi)容的版權(quán)問題:擴(kuò)散模型生成的樣本可能涉及到版權(quán)問題。例如,在文本到圖像生成任務(wù)中,如果輸入的文本描述涉及到受版權(quán)保護(hù)的圖像內(nèi)容,生成的圖像可能會侵犯版權(quán)。此外,擴(kuò)散模型在生成過程中可能會結(jié)合多個數(shù)據(jù)源的信息,如果這些數(shù)據(jù)源中的內(nèi)容存在版權(quán)爭議,生成的樣本也可能面臨版權(quán)糾紛。

- 倫理道德問題:擴(kuò)散模型生成的內(nèi)容可能會引發(fā)一些倫理道德問題。例如,模型可能會生成具有誤導(dǎo)性或虛假性的圖像,如偽造的新聞圖片或虛假的醫(yī)療影像等。這可能會對社會產(chǎn)生不良影響,如誤導(dǎo)公眾輿論、損害個人名譽(yù)等。此外,擴(kuò)散模型在生成涉及特定群體或敏感話題的內(nèi)容時,可能會無意中放大偏見或歧視,引發(fā)倫理爭議。

5. 未來發(fā)展方向

5.1 模型優(yōu)化與改進(jìn)

擴(kuò)散模型的研究仍在不斷深入,未來的發(fā)展方向之一是模型的優(yōu)化與改進(jìn)。以下是幾個可能的研究方向:

- 提升采樣效率:盡管已有多種采樣加速策略被提出,但如何在保持生成質(zhì)量的同時,進(jìn)一步減少采樣步數(shù)和計(jì)算資源消耗,仍然是一個值得探索的問題。可以考慮開發(fā)更高效的數(shù)值求解器,或者設(shè)計(jì)更合理的采樣策略,如自適應(yīng)采樣、重要性采樣等,以提高采樣效率。

- 增強(qiáng)模型的泛化能力:當(dāng)前擴(kuò)散模型在處理與訓(xùn)練數(shù)據(jù)分布差異較大的數(shù)據(jù)時,泛化能力有限。未來可以通過引入更多的正則化技術(shù)、數(shù)據(jù)增強(qiáng)方法以及設(shè)計(jì)更合理的模型架構(gòu),來增強(qiáng)模型對不同數(shù)據(jù)分布的適應(yīng)性和泛化能力,使其在更多樣化的應(yīng)用場景中發(fā)揮作用。

- 提高模型的穩(wěn)定性和魯棒性:訓(xùn)練不穩(wěn)定和對輸入數(shù)據(jù)敏感是擴(kuò)散模型面臨的挑戰(zhàn)。未來的研究可以探索更穩(wěn)定的訓(xùn)練算法和優(yōu)化策略,如改進(jìn)的梯度下降方法、魯棒的損失函數(shù)設(shè)計(jì)等,以提高模型的穩(wěn)定性和魯棒性,使其在面對復(fù)雜數(shù)據(jù)和噪聲時仍能保持良好的性能。

- 降低計(jì)算資源需求:擴(kuò)散模型對計(jì)算資源的需求較高,限制了其在資源受限環(huán)境中的應(yīng)用。未來可以通過模型壓縮、知識蒸餾等技術(shù),將擴(kuò)散模型的知識遷移到更輕量級的模型中,或者開發(fā)更高效的模型架構(gòu),以降低模型的計(jì)算資源需求,使其在更多的設(shè)備和場景中得到應(yīng)用。

5.2 跨領(lǐng)域應(yīng)用探索

擴(kuò)散模型在多個領(lǐng)域展現(xiàn)出了強(qiáng)大的生成能力,未來可以進(jìn)一步探索其在更多領(lǐng)域的應(yīng)用:

- 醫(yī)療健康領(lǐng)域:除了醫(yī)學(xué)圖像生成和分析,擴(kuò)散模型還可以應(yīng)用于醫(yī)療數(shù)據(jù)的合成和增強(qiáng),如合成缺失的醫(yī)療記錄、生成個性化的治療方案等,為醫(yī)療研究和臨床決策提供支持。

- 金融領(lǐng)域:在金融數(shù)據(jù)分析和預(yù)測中,擴(kuò)散模型可以用于生成合成的金融數(shù)據(jù)集,幫助研究者和分析師更好地理解市場動態(tài)和風(fēng)險因素,或者用于金融產(chǎn)品的定價和風(fēng)險管理。

- 教育領(lǐng)域:擴(kuò)散模型可以用于生成個性化的學(xué)習(xí)材料和教學(xué)資源,如根據(jù)學(xué)生的學(xué)習(xí)進(jìn)度和興趣生成相應(yīng)的練習(xí)題、教學(xué)視頻等,提高教學(xué)效果和學(xué)習(xí)體驗(yàn)。

- 科學(xué)研究領(lǐng)域:在物理、化學(xué)、生物等基礎(chǔ)科學(xué)領(lǐng)域,擴(kuò)散模型可以用于模擬和生成復(fù)雜的科學(xué)現(xiàn)象和數(shù)據(jù),如分子結(jié)構(gòu)的生成、物理過程的模擬等,為科學(xué)研究提供新的工具和方法。

- 藝術(shù)創(chuàng)作領(lǐng)域:擴(kuò)散模型在藝術(shù)創(chuàng)作中具有廣闊的應(yīng)用前景,可以用于生成新穎的藝術(shù)作品、音樂創(chuàng)作、影視特效制作等,為藝術(shù)家和創(chuàng)作者提供靈感和工具。

5.3 理論研究與基礎(chǔ)建設(shè)

理論研究與基礎(chǔ)建設(shè)是推動擴(kuò)散模型發(fā)展的關(guān)鍵,未來可以從以下幾個方面加強(qiáng):

- 深入理解擴(kuò)散過程的理論基礎(chǔ):加強(qiáng)對擴(kuò)散過程的數(shù)學(xué)理論和物理機(jī)制的研究,深入理解其在不同數(shù)據(jù)類型和應(yīng)用場景中的行為和特性,為模型的設(shè)計(jì)和優(yōu)化提供更堅(jiān)實(shí)的理論基礎(chǔ)。

- 探索新的擴(kuò)散機(jī)制和原理:研究者可以探索新的擴(kuò)散機(jī)制和原理,突破現(xiàn)有的框架,提出更創(chuàng)新的模型和方法,拓展擴(kuò)散模型的應(yīng)用邊界和性能表現(xiàn)。

- 建立統(tǒng)一的理論框架和標(biāo)準(zhǔn):目前擴(kuò)散模型的研究相對分散,缺乏統(tǒng)一的理論框架和標(biāo)準(zhǔn)。未來可以建立一個統(tǒng)一的理論框架,整合現(xiàn)有的研究成果,制定相關(guān)的標(biāo)準(zhǔn)和規(guī)范,促進(jìn)擴(kuò)散模型的研究和應(yīng)用。

- 加強(qiáng)跨學(xué)科的合作與交流:擴(kuò)散模型的研究涉及計(jì)算機(jī)科學(xué)、數(shù)學(xué)、物理學(xué)、統(tǒng)計(jì)學(xué)等多個學(xué)科,加強(qiáng)跨學(xué)科的合作與交流,可以促進(jìn)不同領(lǐng)域之間的知識融合和技術(shù)互補(bǔ),推動擴(kuò)散模型的理論研究和應(yīng)用發(fā)展。

本文轉(zhuǎn)載自 ??智駐未來??,作者: 小智