生成式對(duì)抗網(wǎng)絡(luò)(GANs)的七大未解之謎

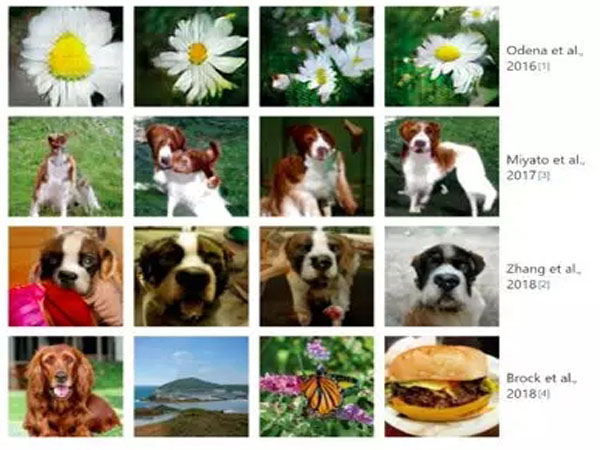

根據(jù)一些度量指標(biāo),在過去兩年,有關(guān)生成式對(duì)抗網(wǎng)絡(luò)(GANs)的研究中已經(jīng)取得了長(zhǎng)足進(jìn)步。圖像合成模型的實(shí)際改進(jìn)(如下所示),幾乎快得讓人跟不上。

然而,根據(jù)其它度量指標(biāo),研究并沒有很大的進(jìn)展。例如,關(guān)于評(píng)估GANs的方法仍存在著廣泛的分歧。鑒于目前圖像合成基準(zhǔn)似乎有點(diǎn)處于飽和的狀態(tài),現(xiàn)在是時(shí)候要反思下這個(gè)子領(lǐng)域的研究目標(biāo)。

本文將列出研究中的7個(gè)開放性問題,希望能在不久的將來,這些未解之謎能有答案。

如何在GANs和其它生成模型之間權(quán)衡?

除了GANs之外,目前還流行其它兩種生成式模型:流動(dòng)模型和自回歸模型。粗略地說,流動(dòng)模型可將一堆可逆變換應(yīng)用于先驗(yàn)樣本中,以便計(jì)算出觀測(cè)數(shù)據(jù)中的對(duì)數(shù)似然性。另一方面,自回歸模型可將觀測(cè)數(shù)據(jù)的分布因式分解為條件分布,并一次處理一個(gè)觀測(cè)成分(對(duì)于圖像,該模型可以一次處理一個(gè)像素)。

最近的研究表明這些模型具有不同的性能特征和權(quán)衡。一個(gè)耐人尋味的開放性問題是:如何準(zhǔn)確地描述這些權(quán)衡,并決定其是否是這些模型的基本特質(zhì)?

具體來說,讓我們暫時(shí)關(guān)注GANs和流動(dòng)模型之間計(jì)算成本的差異。乍一看,使用流動(dòng)模型似乎可能會(huì)使GANs的存在多余,原因是:流動(dòng)模型還考慮到精確的對(duì)數(shù)似然性計(jì)算和精確推理。因此如果訓(xùn)練流動(dòng)模型和GANs具有相同的計(jì)算成本,那么GANs可能沒有什么用。既然花費(fèi)了大量的精力訓(xùn)練GANs,那么看起來我們更要關(guān)心流動(dòng)模型是否會(huì)把GANs淘汰掉。

但是,訓(xùn)練GANs和流動(dòng)模型的計(jì)算成本似乎存在著巨大的差距。為了估計(jì)這個(gè)差距的大小,可以參考兩個(gè)在人臉數(shù)據(jù)集上訓(xùn)練的模型。

GLOW模型經(jīng)過訓(xùn)練,可以使用40個(gè)GPU連續(xù)2周生成256x256個(gè)名人的臉,涉及約2億個(gè)參數(shù)。相比之下,逐步發(fā)展的GANs經(jīng)過訓(xùn)練,可以在同樣的數(shù)據(jù)集上使用8個(gè)GPU,連續(xù)4天使用大約4600萬個(gè)參數(shù),生成1024x1024個(gè)圖像。

粗略地說,流動(dòng)模型要花費(fèi)17倍的使用GPU的天數(shù),以及使用4倍多的參數(shù),才能生成減少了16倍的像素。這種比較雖不嚴(yán)謹(jǐn),但是還是能給我們提供一些參考的。

為什么流動(dòng)模型效率較低?可能有以下兩個(gè)原因:首先,極大似然訓(xùn)練在計(jì)算層面比對(duì)抗訓(xùn)練更難。特別是,如果訓(xùn)練集的任何元素被生成模型確定為零概率,那么其將受到極其嚴(yán)厲的懲罰!另一方面,GAN生成器只會(huì)因?yàn)榻o訓(xùn)練集元素確定為零概率而間接地受到懲罰,并且這種懲罰不那么嚴(yán)厲。其次,規(guī)范化流程可能是表示某些函數(shù)的低效方法。

我們已經(jīng)討論過GANs模型和流動(dòng)模型之間的權(quán)衡,但是自回歸模型的權(quán)衡又是什么呢?事實(shí)證明,自回歸模型可以表示為不可并行的流動(dòng)模型(因?yàn)槎叨伎赡?。結(jié)果還表明,自回歸模型在時(shí)間和參數(shù)上比流動(dòng)模型更有效率。總的來說,GANs是高效并行但不可逆的,流動(dòng)模型是可逆并行但不高效的,而自回歸模型是可逆高效但不并行的。

這引出了一個(gè)開放性問題:

問題1:GANs和其它生成模型之間的基本權(quán)衡是什么?特別是能否對(duì)可逆性、并行性和參數(shù)/時(shí)間效率做出某種CAP定理類型的聲明。

解決這個(gè)問題的一種方法是研究混合了更多模型的模型混合體。該方法已被考慮用來混合GAN和流動(dòng)模型,但是這種方法仍未得到充分探索。

我們也不確定極大似然訓(xùn)練是否一定比GAN訓(xùn)練更難。的確,在GAN訓(xùn)練損失的情況下,并沒有明確禁止在訓(xùn)練數(shù)據(jù)點(diǎn)上放置零權(quán)值,但是如果生成器這樣做,那么一個(gè)足夠強(qiáng)大的判別器能夠做得比這個(gè)更好。不過,看起來GANs在實(shí)踐中似乎正在學(xué)習(xí)低支持度的分布。我們懷疑流動(dòng)模型關(guān)于每個(gè)參數(shù)的表達(dá)能力根本不如任意解碼器函數(shù),而且這在某些假設(shè)下是可證明的。

GANs可以為哪種分布建模?

大多數(shù)GAN的研究都側(cè)重于圖像合成,特別是在一些標(biāo)準(zhǔn)的(在深度學(xué)習(xí)社區(qū)中)圖像數(shù)據(jù)集上訓(xùn)練GANs,包括:MNIST、CIFAR-10、STL-10、CelebA 和Imagenet。

關(guān)于哪些數(shù)據(jù)集最容易建模,有一些非官方的說法。比如MNIST和CelebA被認(rèn)為比Imagenet、CIFAR-10、或STL-10更容易建模,因?yàn)樗鼈?ldquo;非常有規(guī)律”。其他人注意到,“大量的類使得ImageNet的圖像合成對(duì)GANs來說非常困難。”這些觀察得到了經(jīng)驗(yàn)事實(shí)的支持,即CelebA上圖像合成模型生成的圖像看起來比Imagenet上圖像合成模型更具說服力。

然而,在這個(gè)費(fèi)時(shí)費(fèi)力而且爭(zhēng)論不休的過程中,必須通過在越來越大和越復(fù)雜的數(shù)據(jù)集上進(jìn)行GANs的訓(xùn)練嘗試才能得出結(jié)論。這個(gè)過程主要研究了GANs對(duì)碰巧存在于對(duì)象識(shí)別的數(shù)據(jù)集的執(zhí)行方法。

與任何科學(xué)一樣,我們希望有一個(gè)簡(jiǎn)單的理論來解釋實(shí)驗(yàn)觀察數(shù)據(jù)。理想情況下,可以查看一個(gè)數(shù)據(jù)集,執(zhí)行一些需要計(jì)算而無需實(shí)際訓(xùn)練的模型,然后說出“這個(gè)數(shù)據(jù)集對(duì)于GAN來說很容易建模,但是對(duì)于VAE來說就不一樣。”這個(gè)問題上已經(jīng)取得了一些進(jìn)展,但仍存在以下問題:

問題2:給定一個(gè)分布,用GAN對(duì)該分布建模的難度有多大?

“為分布建模”是什么意思?是否對(duì)低支持表示感到滿意還是想要真正的密度模型?有沒有GAN永遠(yuǎn)無法學(xué)到的為分布建模的方法?對(duì)于一些合理的資源消耗模型,原則上是否有為GAN學(xué)習(xí),但是不能有有效學(xué)習(xí)的分布呢?對(duì)于GAN而言,這些問題的答案是否與其它生成模型不同?

以下兩種策略可以回答這些問題:

- 合成數(shù)據(jù)集:通過研究合成數(shù)據(jù)集來探究影響可學(xué)習(xí)性的特征。例如,作者創(chuàng)建了合成三角形的數(shù)據(jù)集。這個(gè)領(lǐng)域尚未得到充分的研究。為了進(jìn)行系統(tǒng)研究,合成數(shù)據(jù)集甚至可以由感興趣的量參數(shù)化,例如連接度或平滑度。這樣的數(shù)據(jù)集也可用于研究其它類型的生成模型。

- 修改現(xiàn)有的理論結(jié)果:現(xiàn)有理論結(jié)果加上嘗試修改假設(shè)導(dǎo)致數(shù)據(jù)集有不同的屬性。例如,可以獲取GANs應(yīng)用于給定單峰分布數(shù)據(jù)的結(jié)果,并了解當(dāng)數(shù)據(jù)分布變?yōu)槎嗄B(tài)時(shí)會(huì)發(fā)生什么。

如何在圖像合成之外擴(kuò)展GANs?

除了圖像到圖像的轉(zhuǎn)化和域適應(yīng)等應(yīng)用之外,大多數(shù)GAN的成功應(yīng)用都是在圖像合成方面。GAN在圖像之外的應(yīng)用主要集中在以下三個(gè)領(lǐng)域:

- 文本:文本的離散性使得 GANs的應(yīng)用變得困難。這是因?yàn)镚ANs依賴于從判別器開始將信號(hào)通過生成的內(nèi)容反向傳播到生成器。有兩種方法可以解決這個(gè)問題。首先,GAN只對(duì)離散數(shù)據(jù)的連續(xù)表示起作用,如下所示。第二種是使用實(shí)際的離散模型,并嘗試使用梯度估計(jì)來訓(xùn)練GAN。其實(shí)還有其它更復(fù)雜的處理方法,但就我們所知,它們與基于可能性的語言模型相比,都不能產(chǎn)生具有競(jìng)爭(zhēng)性(就困惑而言)的結(jié)果。

- 結(jié)構(gòu)化數(shù)據(jù):其它如圖表等非歐幾里得式的結(jié)構(gòu)化數(shù)據(jù)是什么呢?對(duì)這類數(shù)據(jù)的研究稱為幾何深度學(xué)習(xí)。GANs在這方面成果有限,但其它的深度學(xué)習(xí)技術(shù)也是如此,因此很難理清GAN的重要性。在該領(lǐng)域,有過使用GANs的嘗試,即讓生成器生成(和判別器“評(píng)判”)隨機(jī)游動(dòng),這些隨機(jī)游動(dòng)與從源圖中采樣的隨機(jī)游動(dòng)相似。

- 音頻:音頻是GANs最接近成功實(shí)現(xiàn)合成圖像的領(lǐng)域。作者對(duì)GANs在音頻上操作做了各種特殊的考慮。最近研究表明,GANs甚至可以在一些感知指標(biāo)上超越自回歸模型。盡管已經(jīng)存在這些嘗試,圖像仍然是GANs最容易處理的領(lǐng)域。對(duì)此引出第三個(gè)問題。

問題3:如何使GANs在非圖像數(shù)據(jù)上表現(xiàn)良好?將GANs擴(kuò)展到其它領(lǐng)域是否需要新的訓(xùn)練技術(shù)?還是僅僅需要為每個(gè)領(lǐng)域提供更好的隱式先驗(yàn)?

期望GANs最終能夠在其它連續(xù)數(shù)據(jù)上實(shí)現(xiàn)圖像合成級(jí)別的成功,但它需要更好的隱式先驗(yàn)。找到這些先驗(yàn)需要仔細(xì)思考在給定的領(lǐng)域里什么是有意義的,什么是可計(jì)算的。

結(jié)構(gòu)化數(shù)據(jù)或非連續(xù)數(shù)據(jù)的界限比較模糊,一種可能的方法是使生成器和判別器推動(dòng)強(qiáng)化學(xué)習(xí)訓(xùn)練。要使這種方法有效,可能需要大規(guī)模的計(jì)算資源。解決這個(gè)問題可能只需要基礎(chǔ)研究。

如何描述GAN訓(xùn)練的全局收斂性?

GAN訓(xùn)練與其他神經(jīng)網(wǎng)絡(luò)訓(xùn)練不同,因?yàn)槲覀儠?huì)交替優(yōu)化生成模型和判別模型來對(duì)抗目標(biāo)。在特定假設(shè)的前提下,這種交替優(yōu)化會(huì)逐漸達(dá)到局部穩(wěn)定。

然而,從總體來看,一些有趣的事情很難進(jìn)行證明。這是因?yàn)榕袆e模型/生成模型的參數(shù)均為非凸性損失函數(shù)。不過,這是所有神經(jīng)網(wǎng)絡(luò)的通病。我們希望有方法能重點(diǎn)解決交替優(yōu)化所造成的問題。于是就產(chǎn)生了下面的疑問:

問題4:何時(shí)能夠證明GAN具有全局收斂性?哪一種神經(jīng)網(wǎng)絡(luò)收斂性結(jié)果能夠應(yīng)用于GAN?

以上問題已經(jīng)取得了不少進(jìn)展。一般來說,目前有3種技術(shù)均取得了可喜的成果,但對(duì)這3種技術(shù)的研究尚不完善:

- 簡(jiǎn)化假設(shè)——一種策略是對(duì)生成模型和判別模型做出簡(jiǎn)單化假設(shè)。例如,通過某些特殊技術(shù)及條件假設(shè)進(jìn)行優(yōu)化后,簡(jiǎn)化后的LGQ GAN(L代表線性生成模型,G代表滿足高斯分布的數(shù)據(jù),Q代表二次判別模型)能夠表現(xiàn)出全局收斂性。逐漸放開這些假設(shè)并觀察結(jié)果似乎前景廣闊。例如,避免單峰分布。單峰分布是一種自然的松弛(relaxation),因?yàn)?ldquo;模式崩潰”(Mode Collapse)是標(biāo)準(zhǔn)的GAN異常狀態(tài)。

- 使用常規(guī)神經(jīng)網(wǎng)絡(luò)技術(shù)——第二種策略是應(yīng)用分析常規(guī)神經(jīng)網(wǎng)絡(luò)(非凸)的技術(shù)來解答有關(guān)GAN收斂性的問題。例如,《TheLoss Surfaces of Multilayer Networks》一文提出深度神經(jīng)網(wǎng)絡(luò)的非凸性并不是問題,因?yàn)殡S著神經(jīng)網(wǎng)絡(luò)擴(kuò)大,損失函數(shù)的低質(zhì)量局部極小值點(diǎn)的數(shù)量呈指數(shù)級(jí)減少。這一分析結(jié)果是否可以“應(yīng)用于GAN領(lǐng)域”?事實(shí)上,對(duì)用作分類器的深度神經(jīng)網(wǎng)絡(luò)進(jìn)行分析,并看其是否適用于GAN,這種啟發(fā)式算法似乎通常行之有效。

- 博弈理論——一種策略是根據(jù)博弈論的原理進(jìn)行GAN訓(xùn)練。這些技術(shù)能夠得出可收斂到某種接近于納什均衡點(diǎn)的訓(xùn)練步驟(這一點(diǎn)可進(jìn)行驗(yàn)證),而且這一過程是在資源限制的情況下完成的。顯然,下一步就是要盡可能減少資源限制。

應(yīng)該如何評(píng)估GAN,又該何時(shí)使用GAN?

目前評(píng)估GAN的方法有很多,但尚未達(dá)成統(tǒng)一。這些方法包括:

- 初始分?jǐn)?shù)和FID(Fréchet 距離)——二者都使用經(jīng)過預(yù)先訓(xùn)練的圖像分類器,且都存在已知問題。而且,二者測(cè)量的是“樣本質(zhì)量”,并沒有真正捕捉到“樣本多樣性”,這一點(diǎn)常為人詬病。

- MS-SSIM——該方法可以使用MS-SSIM單獨(dú)評(píng)估多樣性,但這一技術(shù)還存在一定問題,并沒有真正流行起來。

- AIS——該方法建議在GAN的輸出后串接一個(gè)高斯觀測(cè)模型(Gaussian observation model),并使用退火重要性采樣代碼(annealedimportance sampling)估算該模型下的對(duì)數(shù)似然值。然而,由于GAN生成模型也是流模型,這種計(jì)算方法并不準(zhǔn)確。

- 幾何分?jǐn)?shù)——該方法建議計(jì)算生成的數(shù)據(jù)流形的幾何屬性,并將這些屬性與實(shí)際數(shù)據(jù)進(jìn)行對(duì)比。

- 精確和召回——該方法建議測(cè)量GAN的“精確率”和“召回率”。

- 技能等級(jí)——該方法已表明, 經(jīng)過訓(xùn)練的GAN判別模型能夠包含可用于評(píng)估的有用信息。

這些只是GAN評(píng)估方案中的一小部分。盡管初始分?jǐn)?shù)和FID相對(duì)更受歡迎,但究竟用那種方法進(jìn)行GAN評(píng)估顯然尚未有定論。我們認(rèn)為,不知道如何評(píng)估GAN是因?yàn)椴恢篮螘r(shí)使用GAN。因此,將這兩個(gè)問題合為問題5:

問題5:什么時(shí)候該使用GAN而不是其他生成模型?如何評(píng)估GAN在這些背景下的表現(xiàn)?

用GAN來做些什么?要想得到真正的密度模型,GAN可能不是很好的選擇。目前已有實(shí)驗(yàn)表明,GAN學(xué)習(xí)了目標(biāo)數(shù)據(jù)集的“低支撐集(low support)”表征,這意味著GAN可能(隱式地)給測(cè)試集大部分?jǐn)?shù)據(jù)分配為零似然度。

將GAN研究的重點(diǎn)放在支撐集不會(huì)造成問題甚至還有一定幫助的任務(wù)上。GAN可能非常適合感知類型的任務(wù),如圖像合成,圖像轉(zhuǎn)換,圖像填充和屬性操作等圖形應(yīng)用程序。

如何評(píng)估GAN在完成這些感知任務(wù)中的表現(xiàn)?理想狀態(tài)下,可以使用人力判斷,但這樣成本很高。低成本的代理服務(wù)器能夠查看分類器是否可以區(qū)分真實(shí)和假的樣本,這一過程即為分類器雙樣本測(cè)試(C2STs)。這一測(cè)試的主要問題是,生成模型哪怕出現(xiàn)一個(gè)跨越樣本系統(tǒng)性的微小缺陷,那么這個(gè)缺陷將會(huì)對(duì)評(píng)估結(jié)果產(chǎn)生決定性影響。

在理想狀態(tài)下,整體評(píng)估不受單一因素的支配。可行的方法之一是引入一個(gè)忽略顯性缺陷的critic(批評(píng)者)。但是,一旦這樣做,可能會(huì)有其他缺陷占據(jù)主導(dǎo)地位,于是就需要另一個(gè)critic,然后這一過程不斷重復(fù)。如果采取迭代的方式,就可以得到一種“Gram-Schmidt procedure for critics”,并創(chuàng)建一個(gè)有序列表,其中包含最重要的缺陷和能夠?qū)⑵浜雎缘腸ritic。也許這可以通過在critic激活上執(zhí)行PCA(主成分分析),并逐步拋棄越來越多的更高方差分量來完成。

盡管有所取舍,我們?nèi)钥梢詫?duì)人類進(jìn)行評(píng)估。這將使我們得以測(cè)量我們真正關(guān)心的事情。通過預(yù)測(cè)人類答案,并在預(yù)測(cè)不確定時(shí)僅與真人交互,可以減少這種方法的成本。

GAN訓(xùn)練如何改變批量大小?

已知大規(guī)模minibatch有助于擴(kuò)展圖像分類,那么它們是否也可以幫助擴(kuò)展GAN?對(duì)于有效使用高度并行化的硬件加速器,規(guī)模較大的minibatch或能起到重要作用。

乍一看,答案似乎是肯定的——畢竟,大多數(shù)GAN中的判別模式不過是一個(gè)圖像分類器。如果在梯度噪聲上遇到瓶頸,則大規(guī)模的minibatch可以加速訓(xùn)練過程。然而,GAN有一個(gè)分類器所沒有的特殊瓶頸,也就是說,二者的訓(xùn)練過程可能有所不同。因此,我們提出如下問題:

問題6:GAN訓(xùn)練時(shí)如何確定批量?梯度噪聲在GAN訓(xùn)練中的作用有多大?是否可以修改GAN訓(xùn)練,使其更好地改變批量大小?

有證據(jù)表明,增大minibatch的規(guī)模能夠改進(jìn)量化結(jié)果并縮短訓(xùn)練時(shí)間。如果這種現(xiàn)象始終存在,則表明梯度噪聲是一個(gè)主導(dǎo)因素。不過,這一點(diǎn)尚未得到系統(tǒng)研究,因此我們認(rèn)為這個(gè)問題仍待解決。

交替訓(xùn)練程序是否可以更好地利用大規(guī)模批訓(xùn)練?理論上,傳輸GAN的收斂性比普通GAN更好,但需要更大規(guī)模的批量,因?yàn)閭鬏擥AN需要將批量樣本和訓(xùn)練數(shù)據(jù)對(duì)齊。因此,傳輸GAN很有可能用于將GAN的批量擴(kuò)展至非常大的規(guī)模。

異步SGD算法(異步隨機(jī)梯度下降)可以成為利用新硬件的不錯(cuò)選擇。在這種設(shè)定中,限制因素往往在參數(shù)的“陳舊”副本上進(jìn)行計(jì)算更新梯度。但實(shí)際上,GAN似乎真正得益于對(duì)過去的參數(shù)快照(snapshots)的訓(xùn)練,因此我們可能會(huì)產(chǎn)生疑問,異步SGD是否以特殊方式與GAN訓(xùn)練進(jìn)行交互?

GAN與對(duì)抗性例子之間有什么關(guān)系?

眾所周知,對(duì)抗性例子會(huì)對(duì)圖像分類器造成影響:人類不易察覺的擾動(dòng)會(huì)導(dǎo)致分類器在添加圖像時(shí)輸出錯(cuò)誤結(jié)果。有的分類問題通常可以進(jìn)行有效學(xué)習(xí),但是要想學(xué)得穩(wěn)健,難度就非常大了。

由于GAN判別模型是一種圖像分類器,有人可能擔(dān)心它會(huì)遇到對(duì)抗性例子。盡管研究GAN和對(duì)抗性例子的文獻(xiàn)浩如煙海,但關(guān)于二者如何聯(lián)系在一起的文獻(xiàn)少之又少。因此,提出以下問題:

問題7:判別模型對(duì)抗性的穩(wěn)健性如何影響GAN訓(xùn)練?

對(duì)這個(gè)問題,該從哪里入手呢?在給定一個(gè)判別模型D的情況下,如果生成樣本G(z)被正確地判別為假樣本,且存在小擾動(dòng)p,使得G(z)+ p即被判別為真樣本,則D就有了對(duì)抗性例子。對(duì)于GAN,我們要關(guān)注的是生成模型的梯度更新將產(chǎn)生新的發(fā)生器G',其中,G'(z)= G(z)+ p。

這個(gè)問題是現(xiàn)實(shí)存在的嗎?生成模型的對(duì)抗性例子表明,對(duì)生成模型的故意威脅起到了作用。我們有理由相信這些意外威脅發(fā)生的可能性較小。首先,在判別模型再次更新前,生成模型只能進(jìn)行一次梯度更新;而目前對(duì)抗性威脅通常會(huì)進(jìn)行幾十次迭代。其次,給出一部分來自先驗(yàn)分布的梯度不同的樣本,能夠優(yōu)化生成模型。該優(yōu)化過程發(fā)生在生成模型的參數(shù)空間(而非像素空間)。但是,這些論點(diǎn)都沒有完全排除生成模型創(chuàng)造對(duì)抗性例子的可能。因此,進(jìn)一步探討這一話題能夠取得豐碩的成果。