無(wú)基礎(chǔ)人員轉(zhuǎn)行做機(jī)器學(xué)習(xí)可以嗎?

無(wú)基礎(chǔ)人員轉(zhuǎn)行做機(jī)器學(xué)習(xí)可以嗎?機(jī)器學(xué)習(xí)需要一定數(shù)學(xué)基礎(chǔ),沒(méi)有相關(guān)的了解需要重新學(xué)習(xí)。轉(zhuǎn)行機(jī)器學(xué)習(xí)不適用所有人,可不可以轉(zhuǎn)行需要具體結(jié)合自身的情況。入門(mén)機(jī)器學(xué)習(xí)有一定的門(mén)檻要慎重決定。

任何機(jī)器學(xué)習(xí)系統(tǒng)的關(guān)鍵部分就是數(shù)據(jù)。考慮到額外的算法、巧妙的編程和大量的更精確的數(shù)據(jù)的選擇。

什么是機(jī)器學(xué)習(xí)?機(jī)器學(xué)習(xí)是人工智能的一個(gè)子集,即用機(jī)器去學(xué)習(xí)以前的經(jīng)驗(yàn)。與傳統(tǒng)的編程不同,開(kāi)發(fā)人員需要預(yù)測(cè)每一個(gè)潛在的條件進(jìn)行編程,一個(gè)機(jī)器學(xué)習(xí)的解決方案可以有效地基于數(shù)據(jù)來(lái)適應(yīng)輸出的結(jié)果。

一個(gè)機(jī)器學(xué)習(xí)的算法并沒(méi)有真正地編寫(xiě)代碼,但建立了一個(gè)關(guān)于真實(shí)世界的計(jì)算機(jī)模型,然后通過(guò)數(shù)據(jù)訓(xùn)練模型。

機(jī)器學(xué)習(xí)原理:垃圾郵件過(guò)濾是一個(gè)很好的例子,它利用機(jī)器學(xué)習(xí)技術(shù)來(lái)學(xué)習(xí)如何從數(shù)百萬(wàn)封郵件中識(shí)別垃圾郵件,其中就用到了統(tǒng)計(jì)學(xué)技術(shù)。

例:如果每100個(gè)電子郵件中的85個(gè),其中包括“便宜”和“偉哥”這兩個(gè)詞的郵件被認(rèn)為是垃圾郵件,我們可以說(shuō)有85%的概率,確定它是垃圾郵件。并通過(guò)其它幾個(gè)指標(biāo)(例如,從來(lái)沒(méi)給你發(fā)送過(guò)郵件的人)結(jié)合起來(lái),利用數(shù)十億個(gè)電子郵件進(jìn)行算法測(cè)試,隨著訓(xùn)練次數(shù)不斷增加來(lái)提升準(zhǔn)確率。

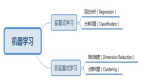

深度學(xué)習(xí)并不等于人工智能,它只是一種算法,和普通的機(jī)器學(xué)習(xí)算法一樣,是解決問(wèn)題的一種方法。真要區(qū)分起來(lái),人工智能、機(jī)器學(xué)習(xí)和深度學(xué)習(xí),三者大概是下圖這種關(guān)系。人工智能是一個(gè)很大的概念,機(jī)器學(xué)習(xí)是其中的一個(gè)子集,而深度學(xué)習(xí)又是機(jī)器學(xué)習(xí)的一個(gè)子集。

深度學(xué)習(xí)不是什么新技術(shù),深度學(xué)習(xí)的概念源于人工神經(jīng)網(wǎng)絡(luò)的研究,早在上世紀(jì) 40 年代,通用計(jì)算機(jī)問(wèn)世之前,科學(xué)家就提出了人工神經(jīng)網(wǎng)絡(luò)的概念。而那個(gè)時(shí)候的計(jì)算機(jī)剛剛開(kāi)始發(fā)展,速度非常慢,最簡(jiǎn)單的網(wǎng)絡(luò)也得數(shù)天才能訓(xùn)練完畢,效率極其低下,因此在接下來(lái)的十幾年都沒(méi)有被大量使用。近些年,隨著算力的提升,GPU、TPU 的應(yīng)用,神經(jīng)網(wǎng)絡(luò)得到了重大發(fā)展。

同機(jī)器學(xué)習(xí)方法一樣,深度學(xué)習(xí)方法也有監(jiān)督學(xué)習(xí)與無(wú)監(jiān)督學(xué)習(xí)之分。例如,卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks,簡(jiǎn)稱(chēng) CNN)就是一種深度的監(jiān)督學(xué)習(xí)下的機(jī)器學(xué)習(xí)模型,而深度置信網(wǎng)絡(luò)(Deep Belief Nets,簡(jiǎn)稱(chēng) DBN)就是一種無(wú)監(jiān)督學(xué)習(xí)下的機(jī)器學(xué)習(xí)模型。深度學(xué)習(xí)的”深度“是指從”輸入層“到”輸出層“所經(jīng)歷層次的數(shù)目,即”隱藏層“的層數(shù),層數(shù)越多,深度也越深。

所以越是復(fù)雜的選擇問(wèn)題,越需要深度的層次多。除了層數(shù)多外,每層”神經(jīng)元“-小圓圈的數(shù)目也要多。例如,AlphaGo 的策略網(wǎng)絡(luò)是 13 層,每一層的神經(jīng)元數(shù)量為 192 個(gè)。深度學(xué)習(xí)的實(shí)質(zhì),是通過(guò)構(gòu)建具有很多隱層的機(jī)器學(xué)習(xí)模型和海量的訓(xùn)練數(shù)據(jù),來(lái)學(xué)習(xí)更有用的特征,從而最終提升分類(lèi)或預(yù)測(cè)的準(zhǔn)確性。