上海數字大腦研究院發布國內首個多模態決策大模型DB1,可實現超復雜問題快速決策

近日,上海數字大腦研究院(以下簡稱 “數研院”)推出首個數字大腦多模態決策大模型(簡稱 DB1),填補了國內在此方面的空白,進一步驗證了預訓練模型在文本、圖 - 文、強化學習決策、運籌優化決策方面應用的潛力。目前,DB1代碼我們已開源在Github,項目鏈接:https://github.com/Shanghai-Digital-Brain-Laboratory/BDM-DB1。

此前,數研院提出 MADT(https://arxiv.org/abs/2112.02845)/MAT(https://arxiv.org/abs/2205.14953)等多智能體模型,在一些離線大模型通過序列建模,使用 Transformer 模型在一些單 / 多智能體任務上取得了顯著效果,并持續在該方向上進行研究探索。

過去幾年,隨著預訓練大模型的興起,學術界與產業界在預訓練模型的參數量與多模態任務上不斷取得新的進展,大規模預訓練模型通過對海量數據和知識的深度建模,被認為是通往通用人工智能的重要路徑之一。專注決策智能研究的數研院創新性地嘗試將預訓練模型的成功復制到決策任務上,并且取得了突破。

多模態決策大模型 DB1

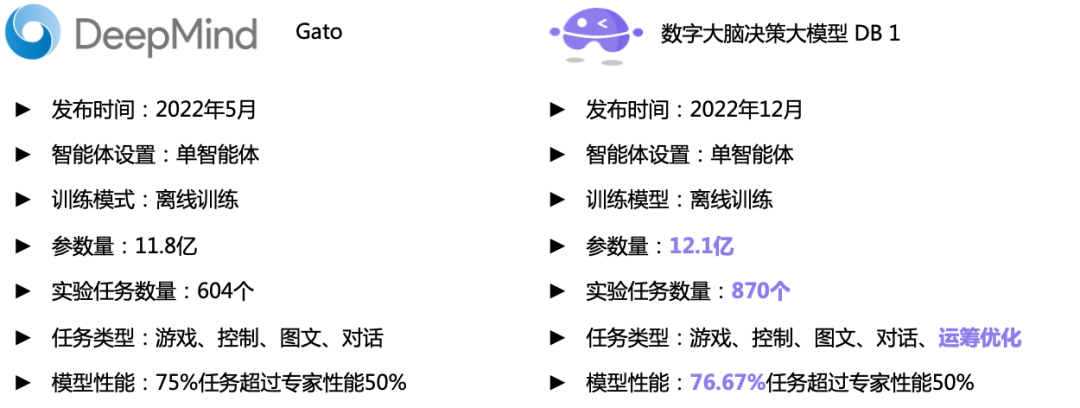

此前,DeepMind 推出 Gato,將單智能體決策任務、多輪對話和圖片 - 文本生成任務統一到一個基于 Transformer 的自回歸問題上,并在 604 個不同任務上取得了良好表現,顯示出通過序列預測能夠解決一些簡單的強化學習決策問題,這在側面驗證了數研院在決策大模型研究方向的正確性。

此次,數研院推出的 DB1,主要對 Gato 進行了復現與驗證,并從網絡結構與參數量、任務類型與任務數量兩方面嘗試進行了改進:

- 參數量與網絡結構:DB1 參數量達 12.1 億。在參數量上盡量做到與 Gato 接近。整體來說,數研院使用了與 Gato 類似的結構(相同的 Decoder Block 數量、隱層大小等),但在 FeedForwardNetwork 中,由于 GeGLU 激活函數會額外引入 1/3 的參數量,數研院為了接近 Gato 的參數量,使用 4 * n_embed 維的隱層狀態經過 GeGLU 激活函數后變成 2 * n_embed 維的特征。在其他方面,我們與 Gato 的實現一樣在輸入輸出編碼端共享了 embedding 參數。不同于 Gato,在 layer normalization 的選擇上我們采用了 PostNorm 的方案,同時我們在 Attention 上使用混合精度計算,提高了數值穩定性。

? - 任務類型與任務數量:DB1 的實驗任務數量達 870,較 Gato 提升了 44.04%,較 Gato 在 >=50% 專家性能上提升 2.23%。具體任務類型上,DB1 大部分繼承了 Gato 的決策、圖像和文本類任務,各類任務數量基本維持一致。但在決策類任務方面,DB1 另外引入了 200 余個現實場景任務,即 100 和 200 節點規模的旅行商問題(TSP,此類任務在所有中國主要城市隨機選擇 100-200 個地理位置作為結點表征)求解。

可以看到的是,DB1 整體表現已經與 Gato 達到同一水平,并已經開始向更加貼近實際業務的需求領域體進化,很好地求解了 NP-hard 的 TSP 問題,而此前 Gato 并未在此方向探索。

DB1 (右) 與 GATO (左)指標對比

DB1 (右) 與 GATO (左)指標對比

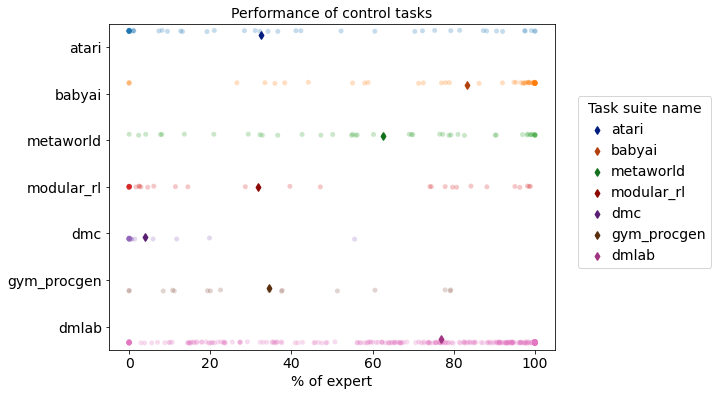

DB1 在強化學習模擬環境上的多任務性能分布

相較于傳統的決策算法,DB1 在跨任務決策能力和快速遷移能力上都有不錯的表現。從跨任務決策能力和參數量來說,實現了從單一復雜任務的千萬 - 億級別參數量到多個復雜任務的十億級別參數的跨越,并持續增長,并且具備解決復雜商業環境中的實際問題的充分能力。從遷移能力來說,DB1 完成了從智能預測到智能決策、從單智能體到多智能體的跨越,彌補傳統方法在跨任務遷移方面的不足,使得在企業內部建立大模型成為可能。

不可否認的是,DB1 在開發過程也遇到了很多難點,數研院進行了大量嘗試,可為業內在大規模模型訓練及多任務訓練數據存儲方面提供一些標準解決路徑。由于模型參數到達 10 億參數規模且任務規模龐大,同時需要在超過 100T(300B+ Tokens)的專家數據上進行訓練,普通的深度強化學習訓練框架已無法滿足在該種情況下的快速訓練。為此,一方面,針對分布式訓練,數研院充分考慮強化學習、運籌優化和大模型訓練的計算結構,在單機多卡和多機多卡的環境下,極致利用硬件資源,巧妙設計模塊間的通訊機制,盡可能提升模型的訓練效率,將 870 個任務的訓練時間縮短到了一周。另一方面,針對分布式隨機采樣,訓練過程所需數據索引、存儲、加載以及預處理也成為相應瓶頸,數研院在加載數據集時采用了延遲加載模式,以解決內存限制問題并盡可能充分利用可用內存。此外,在對加載數據進行預處理后,會將處理過的數據緩存至硬盤中,便于此后可直接加載預處理完成的數據,縮減重復預處理帶來的時間和資源成本。

目前,國際國內頭部企業與研究機構如 OpenAI、Google、Meta、華為、百度和達摩院等都已經進行了多模態大模型相關的研究并且有了一定商業化嘗試,包括在自身產品中應用或者提供模型 API 和相關行業解決方案。相比之下,數研院更關注決策問題,同時支持游戲 AI 決策任務、運籌優化 TSP 求解任務、機器人決策控制任務、黑盒優化求解任務與多輪對話任務上進行應用嘗試。

任務表現

運籌優化:TSP 問題求解

以中國部分城市為節點的 TSP 問題

強化學習任務視頻演示

DB1 模型在完成 870 個不同決策任務的離線學習后,其評估結果顯示有 76.67% 的任務達到或超過 50% 的專家水平。以下是一些任務的效果展示。

- 電子游戲場景:DB1 可以接收 2D/3D 圖像輸入,并且很好地完成類如 Atari,Procgen 在內的 2D 像素游戲,同時對于 DMLab 這種與真實世界較為相似的 3D 圖像輸入任務,DB1 也表現出了良好的性能。

Atari Breakout

DMLab Explore Object Locations

Procgen DogBall

- 連續控制場景:在機器人領域的連續控制任務上,DB1 也能夠建模連續動作的策略輸出,并且良好地完成仿真任務上。

Metaworld PlateSlide

ModularRL Cheetah

文本 - 圖像任務

- 文本生成:給出一段文字提示,生成長文本描述

- 輸入提示:digital brain laboratory is a shanghai based

- 生成結果:digital brain laboratory is a shanghai based company and we are looking for a highly skilled and experienced person to join our team in shanghai, china.

we are a digital brain lab and we are looking for a highly skilled and experienced person to join our team in shanghai, china.

this is an opportunity to work for a well known and growing company that is going through a fast growth phase and to have an impact in the market.

This is a full-time, permanent position.

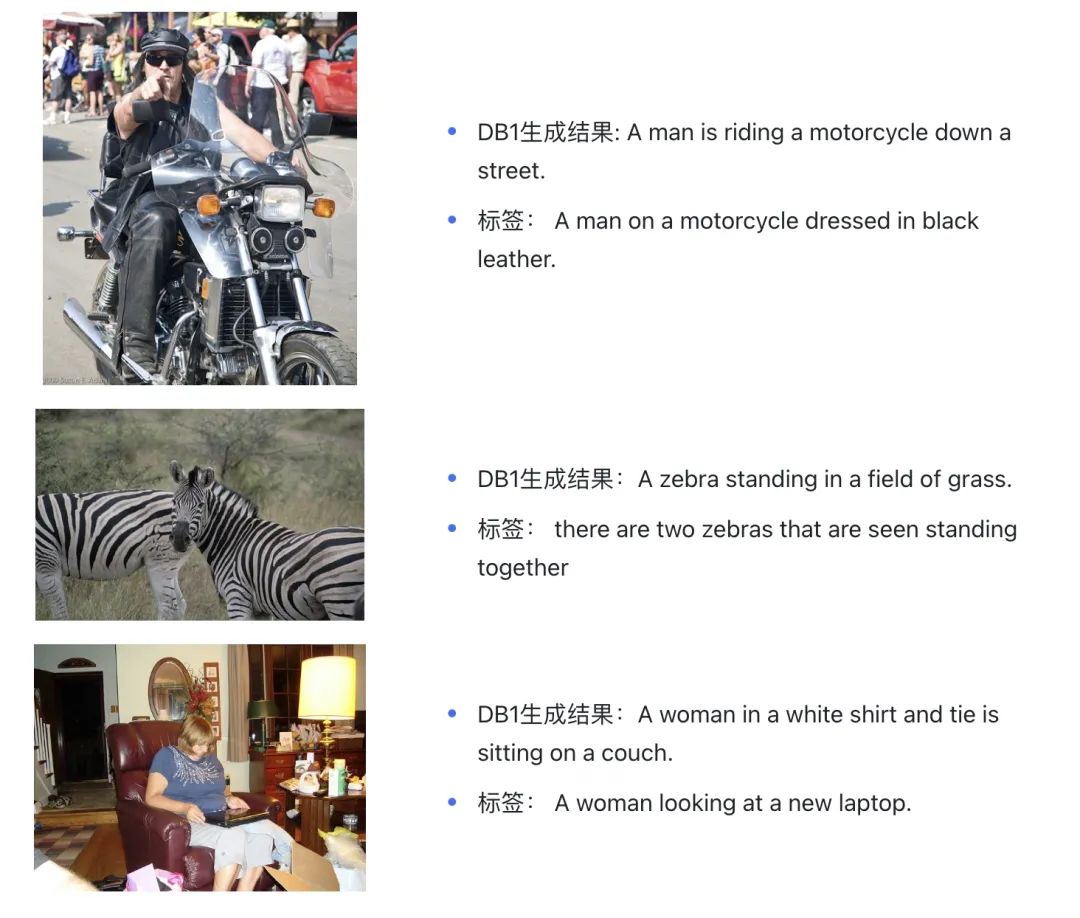

We are looking for a highly skilled, motivated and experienced software engineer who can lead a team of 5-10 in a highly competitive environment - 圖像描述生成:給定一張圖片生成對應文本描述

當前決策大模型的局限性與未來方向

雖然當前多模態決策預訓練模型 DB1 取得了一定效果,但仍存在一定局限性,諸如:跨域任務采樣權重敏感、跨域知識遷移困難、長序列建模困難、專家數據強依賴等。雖然存在眾多挑戰,但現階段看來,多模態決策大模型是實現決策智能體從游戲走向更廣泛場景,從虛擬走向現實,在現實開放動態環境中進行自主感覺與決策,最終實現更加通用人工智能的關鍵探索方向之一。未來,數研院將持續迭代數字大腦決策大模型,通過更大參數量,更有效的序列表征,接入和支持更多任務,結合離線 / 線訓練與微調,實現跨域、跨模態、跨任務的知識泛化與遷移,最終在現實應用場景下提供更通用、更高效、更低成本的決策智能決策解決方案。