大模型訓練成本降低近一半!新加坡國立大學最新優化器已投入使用

本文經AI新媒體量子位(公眾號ID:QbitAI)授權轉載,轉載請聯系出處。

優化器在大語言模型的訓練中占據了大量內存資源。

現在有一種新的優化方式,在性能保持不變的情況下將內存消耗降低了一半。

該成果由新加坡國立大學打造,在ACL會議上獲得了杰出論文獎,并已經投入了實際應用。

圖片

圖片

隨著大語言模型不斷增加的參數量,訓練時的內存消耗問題更為嚴峻。

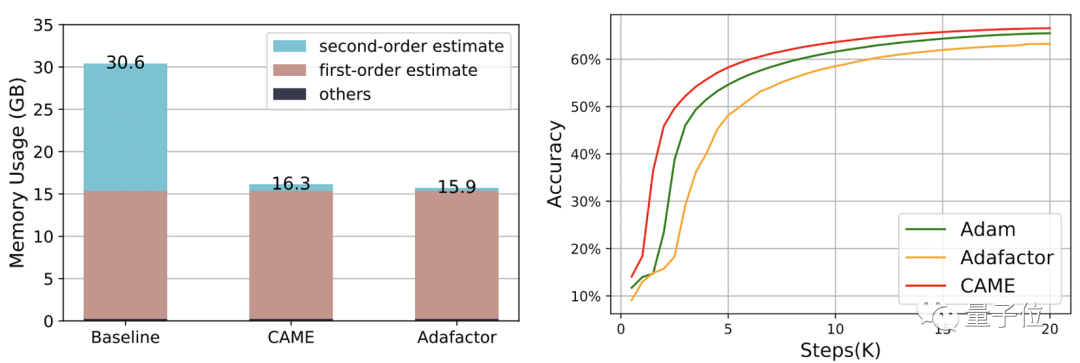

研究團隊提出了 CAME 優化器,在減少內存消耗的同時,擁有與Adam相同的性能。

圖片

圖片

CAME優化器在多個常用的大規模語言模型的預訓練上取得了相同甚至超越Adam優化器的訓練表現,并對大batch預訓練場景顯示出更強的魯棒性。

進一步地,通過CAME優化器訓練大語言模型,能夠大幅度降低大模型訓練的成本。

實現方法

CAME 優化器基于 Adafactor 優化器改進而來,后者在大規模語言模型的預訓練任務中往往帶來訓練性能的損失。

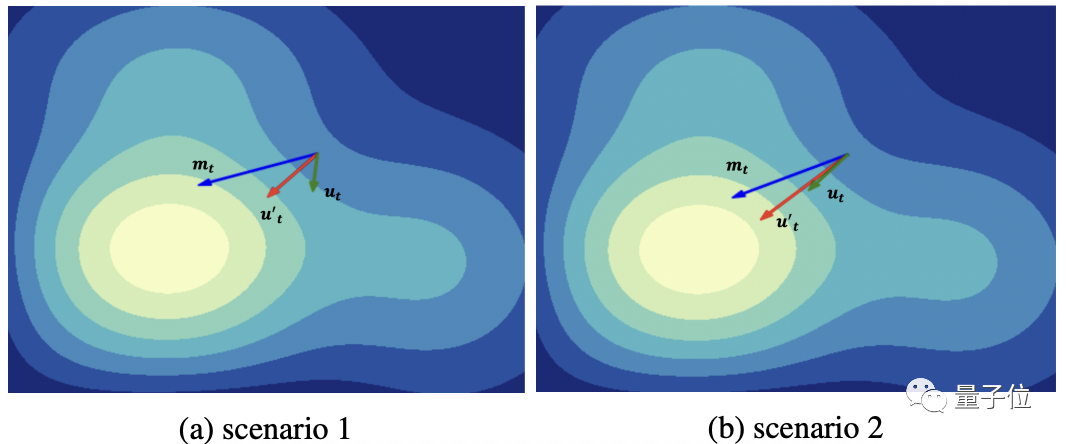

Adafactor中的非負矩陣分解操作在深度神經網絡的訓練中不可避免地會產生錯誤,對這些錯誤的修正就是性能損失的來源。

而通過對比發現,當起始數值mt和當前數值t相差較小時,mt的置信度更高。

圖片

圖片

受這一點啟發,團隊提出了一種新的優化算法。

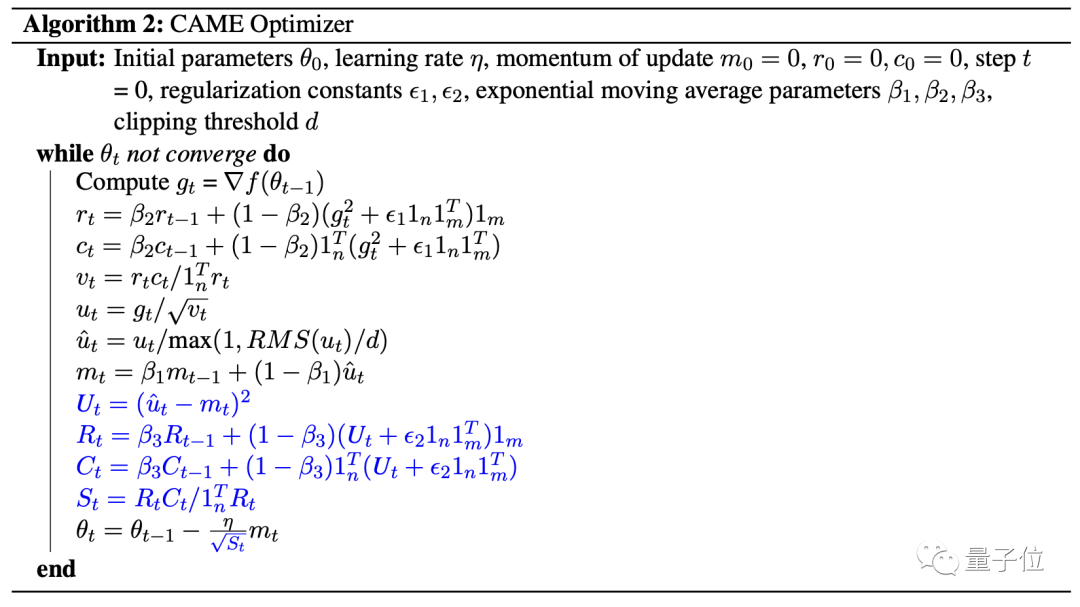

下圖中的藍色部分就是CAME相比Adafactor增加的部分。

圖片

圖片

CAME 優化器基于模型更新的置信度進行更新量修正,同時對引入的置信度矩陣進行非負矩陣分解操作。

最終,CAME成功以Adafactor的消耗得到了Adam的效果。

相同效果僅消耗一半資源

團隊使用CAME分別訓練了BERT、GPT-2和T5模型。

此前常用的Adam(效果更優)和Adafactor(消耗更低)是衡量CAME表現的參照。

其中,在訓練BERT的過程中,CAME僅用一半的步數就達到了和Adafaactor相當的精度。

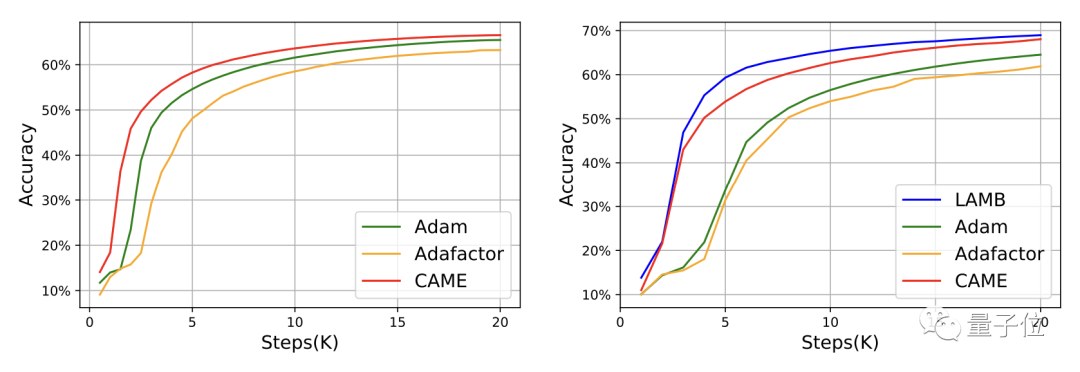

△左側為8K規模,右側為32K規模

△左側為8K規模,右側為32K規模

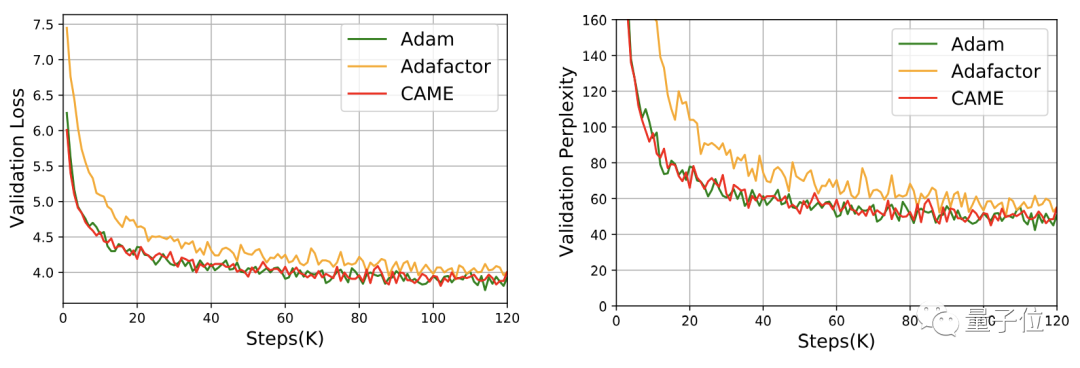

對于GPT-2,從損失和困惑度兩個角度看,CAME的表現和Adam十分接近。

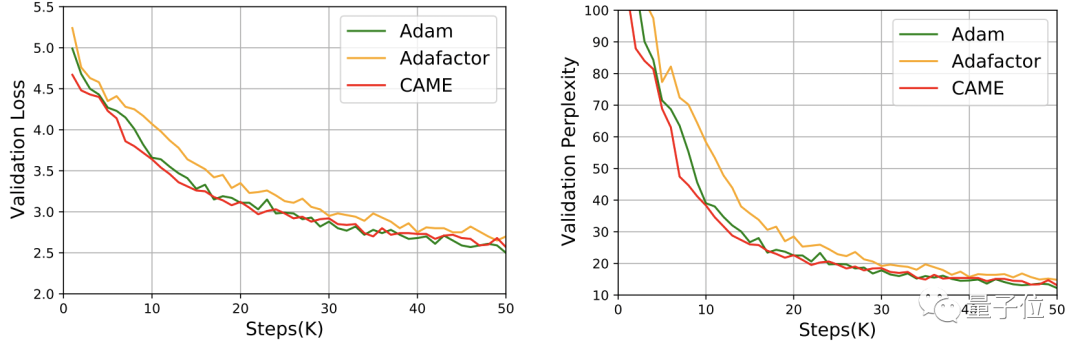

在T5模型的訓練中,CAME也呈現出了相似的結果。

而對于模型的微調,CAME在精確度上的表現也不輸于基準。

資源消耗方面,在使用PyTorch訓練4B數據量的BERT時,CAME消耗的內存資源比基準減少了近一半。

團隊簡介

新加坡國立大學HPC-AI 實驗室是尤洋教授領導的高性能計算與人工智能實驗室。

實驗室致力于高性能計算、機器學習系統和分布式并行計算的研究和創新,并推動在大規模語言模型等領域的應用。

實驗室負責人尤洋是新加坡國立大學計算機系的校長青年教授(Presidential Young Professor)。

尤洋在2021年被選入福布斯30歲以下精英榜(亞洲)并獲得IEEE-CS超算杰出新人獎,當前的研究重點是大規模深度學習訓練算法的分布式優化。

本文第一作者羅旸是該實驗室的在讀碩士生,他當前研究重點為大模型訓練的穩定性以及高效訓練。

論文地址:https://arxiv.org/abs/2307.02047

GitHub項目頁:https://github.com/huawei-noah/Pretrained-Language-Model/tree/master/CAME