AI生成巴以沖突虛假圖片,以假亂真被媒體引用

隨著巴以沖突的持續,相關新聞事件報道層出不窮,一些虛假內容也開始混入其中,讓人真假難辨。最近,由AI生成、反映巴以沖突現場的圖片出現在知名圖片庫 Adobe Stock 中,并被一些新聞媒體采用。

作為一家積極擁抱生成式人工智能的圖片庫,Adobe Stock從2022年開始允許供稿人上傳和銷售由AI 生成的圖片,只是在上傳時要標注“是否由 AI 生成”,成功上架后也會將該圖片明確標記為“由 AI 生成”。除此要求外,提交準則與任何其他圖像相同,包括禁止上傳非法或侵權內容。

但據澳大利亞網站Crikey報道,在Adobe Stock搜索與以色列、巴勒斯坦、加沙和哈馬斯相關的關鍵詞,會出現大量由AI生成的圖片,例如搜索巴勒斯坦時顯示的第一個結果標題就是“由人工智能生成的以色列和巴勒斯坦沖突”的圖片。其他一些圖片也顯示了抗議、實地沖突,甚至是兒童逃離爆炸現場的畫面,但所有這些也都是由AI生成。

圖1:在 Adobe Stock 上搜索巴以沖突時會搜索到大量 AI 圖像

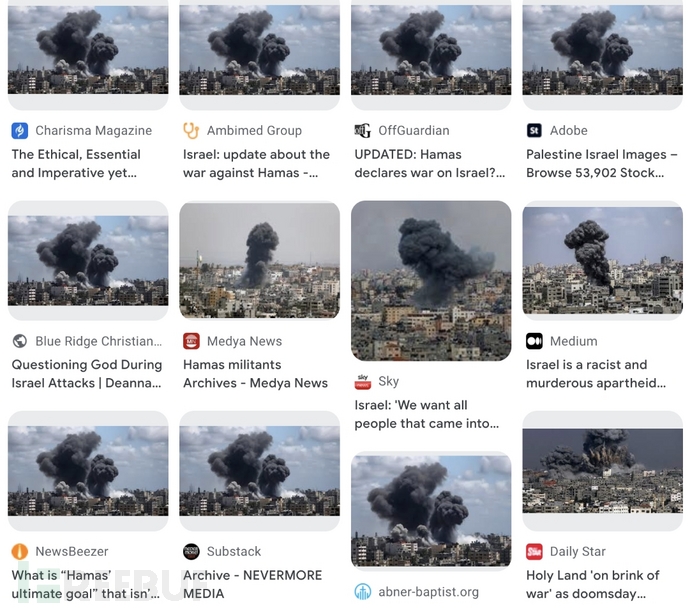

令人擔憂的是,這些圖片已經出現在一些在線新聞媒體、博客,但沒有將其標記為由人工智能生成,也尚不清楚這些媒體是否知道這些是虛假圖片。

圖2:一些媒體機構在報道巴以沖突新聞時已經使用圖1左上角那張由AI生成的圖片

事后,Adobe表示,所有生成式 AI 內容在提交許可時都必須貼上相應標簽,但也強調,客戶在購買使用時知道“這是一張由生成式 AI 工具創建的圖片”同樣重要。

識別圖片真假是一項復雜性工作

專家一再警告稱,人工智能將被用來在網上傳播錯誤信息,隨著越來越多看起來逼真的內容在互聯網上發布和共享,解決這個問題變得越來越困難。

RMIT 高級講師 TJ Thomson 博士正在研究人工智能生成圖像的使用,他表示,人們擔心人工智能圖像使用的透明度以及受眾是否有足夠的文化知識能夠對其進行識別。

根據一項被稱為“內容真實性計劃”的措施,包括Adobe、微軟、BBC 和《紐約時報》在內的科技和新聞組織正在嘗試實施內容憑證技術,該憑證使用文件元數據來突出顯示圖片的來源,無論這些圖片是由真人拍攝還是AI生成。

然而,內容憑證尚未在實際環境中部署,需要社交網絡、出版商、藝術家以及應用程序、瀏覽器和生成人工智能開發人員的合作才能按預期工作。