駛向未來,首個多視圖預(yù)測+規(guī)劃自動駕駛世界模型來了

近期,世界模型的概念引發(fā)了火熱浪潮,而自動駕駛領(lǐng)域豈能隔岸觀「火」。來自中科院自動化所的團隊,首次提出了一種名為 Drive-WM 的全新多視圖世界模型,旨在增強端到端自動駕駛規(guī)劃的安全性。

網(wǎng)站:https://drive-wm.github.io

論文鏈接:https://arxiv.org/abs/2311.17918

首個多視圖預(yù)測和規(guī)劃的自動駕駛世界模型

在 CVPR2023 自動駕駛的研討會上,特斯拉和 Wayve 兩大科技巨頭狂秀黑科技,一種名為「生成式世界模型」的全新概念隨之火爆自動駕駛領(lǐng)域。Wayve 更是發(fā)布了 GAIA-1 的生成式 AI 模型,展示了令人震撼的視頻場景生成能力。而最近,中科院自動化所的研究者們也提出了一個新的自動駕駛世界模型 ——Drive-WM,首次實現(xiàn)了多視圖預(yù)測的世界模型,與當下主流的端到端自動駕駛規(guī)劃器無縫結(jié)合。

Drive-WM 利用了 Diffusion 模型的強大生成能力,能夠生成逼真的視頻場景。

想象一下,你正在開車,而你的車載系統(tǒng)正在根據(jù)你的駕駛習慣和路況預(yù)測未來的發(fā)展,并生成相應(yīng)的視覺反饋來指導軌跡路線的選擇。這種預(yù)見未來的能力和規(guī)劃器相結(jié)合,將極大地提高自動駕駛的安全性!

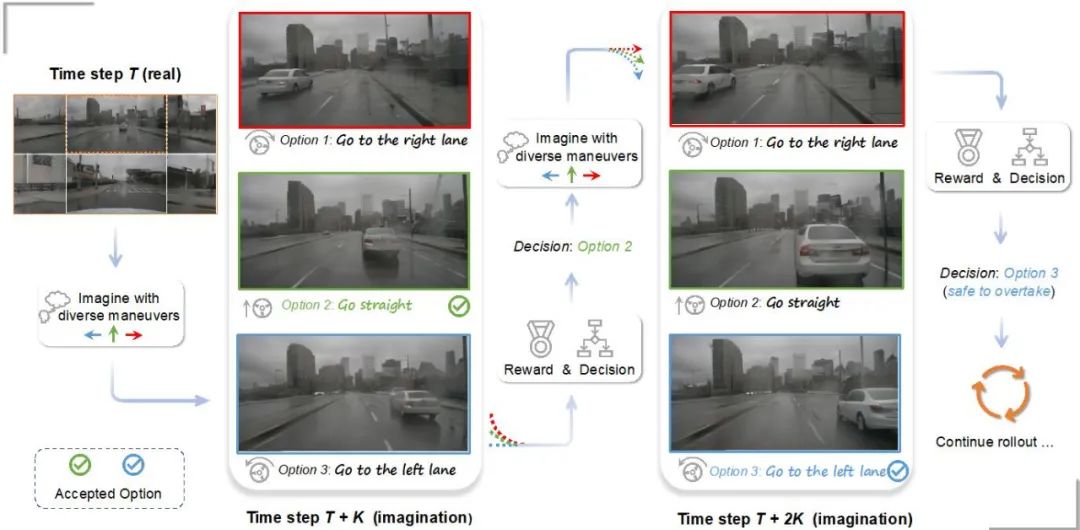

基于多視圖世界模型的預(yù)測和規(guī)劃。

世界模型與端到端自動駕駛的結(jié)合提升駕駛安全性

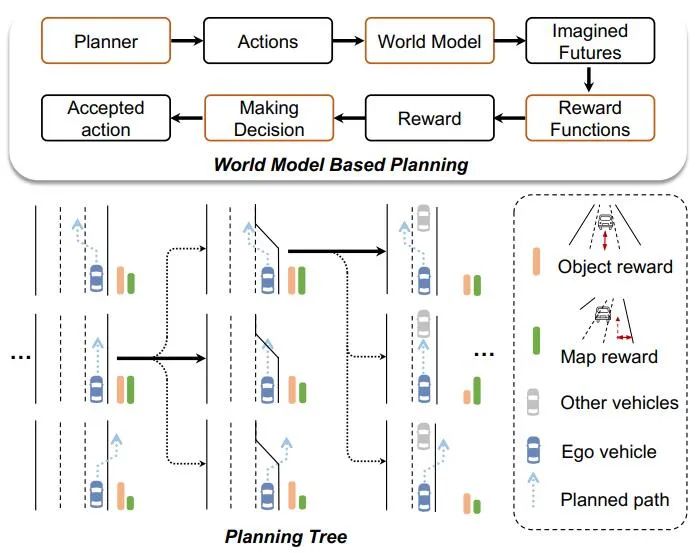

Drive-WM 模型首次將世界模型與端到端規(guī)劃相結(jié)合,為端到端自動駕駛的發(fā)展打開了新的篇章。在每個時間步上,規(guī)劃器可以借助世界模型預(yù)測未來可能發(fā)生的情景,再利用圖像獎勵函數(shù)全面評估。

基于世界模型的端到端軌跡規(guī)劃樹

選擇最優(yōu)估計,擴展規(guī)劃樹,實現(xiàn)更安全、有效的規(guī)劃。

Drive-WM 開創(chuàng)性地探索了世界模型在端到端規(guī)劃中的兩種應(yīng)用:

1. 展示了世界模型在面對 OOD 場景時的魯棒性。作者通過對比實驗發(fā)現(xiàn)了目前的端到端規(guī)劃器在面對 OOD 情況時的表現(xiàn)并不理想。

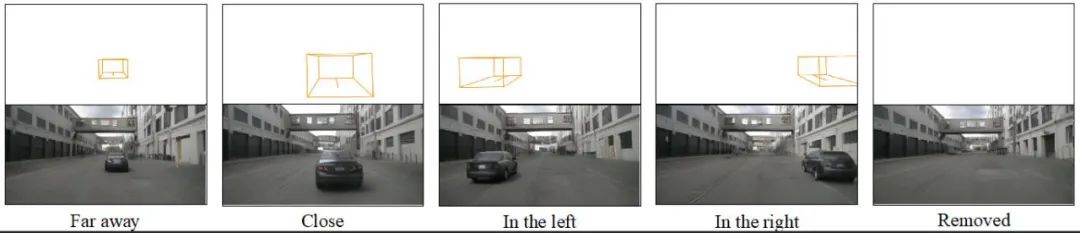

作者給出了以下圖片,當對初始位置進行輕微的橫向偏移擾動后,目前的端到端規(guī)劃器就難以輸出合理的規(guī)劃路線。

端到端規(guī)劃器在面對 OOD 情況時難以輸出合理的規(guī)劃路線。

Drive-WM 的強大生成能力為解決 OOD 問題提供了新的思路。作者利用生成的視頻來微調(diào)規(guī)劃器,從 OOD 數(shù)據(jù)中進行學習,使得規(guī)劃器在面對這樣的場景時可以擁有更好的性能。

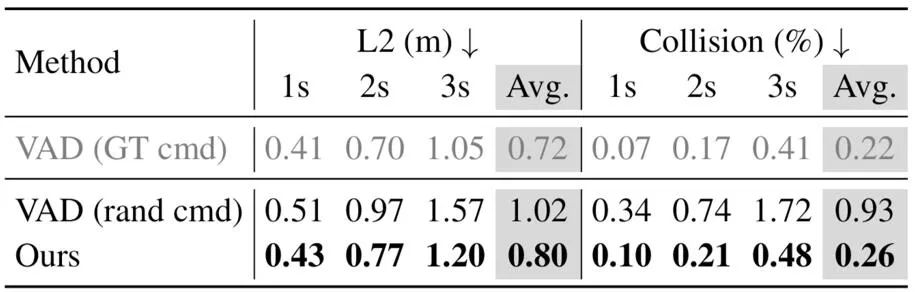

2. 揭示了引入未來場景評估對于端到端規(guī)劃的提升作用

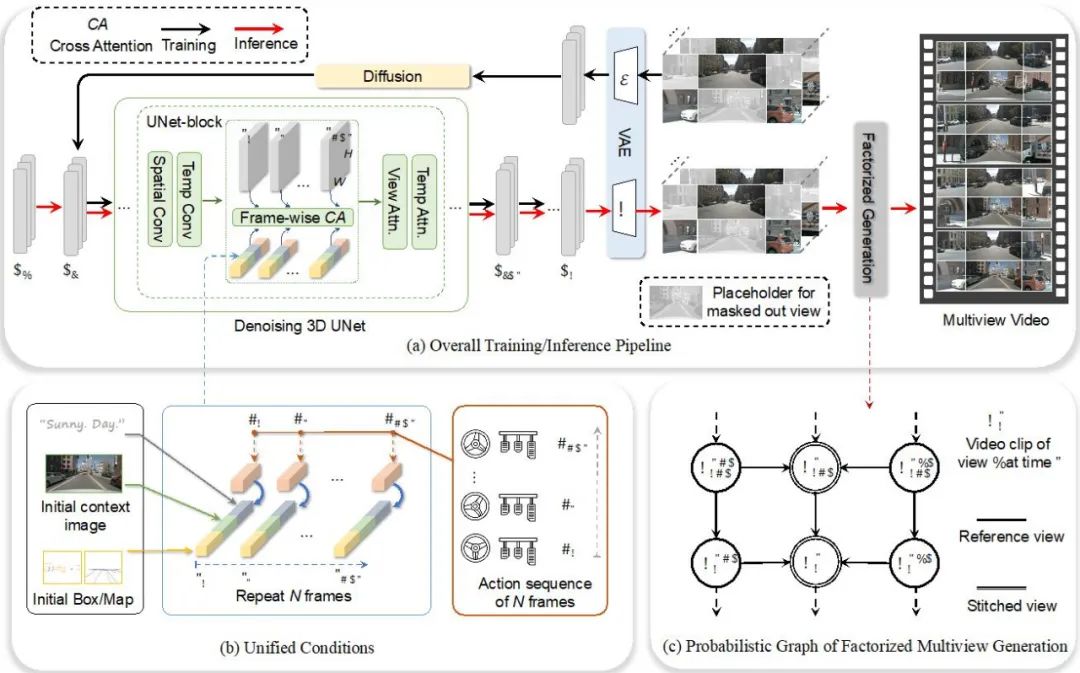

如何構(gòu)建多視圖的視頻生成模型

多視圖視頻生成的時空一致性一直以來都是一個具有挑戰(zhàn)性的問題。Drive-WM 通過引入時序?qū)拥木幋a來擴展視頻生成的能力,并通過視圖分解建模的方式實現(xiàn)多視圖的視頻生成。這種視圖分解的生成方式可以極大地提升視圖之間的一致性。

Drive-WM 整體模型設(shè)計

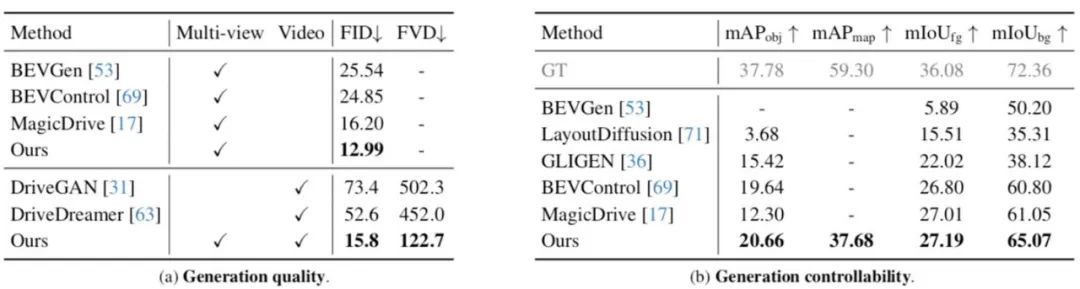

高質(zhì)量的視頻生成與可控性

Drive-WM 不僅實現(xiàn)了高質(zhì)量的多視圖視頻生成,而且具有出色的可控性。Drive-WM 還提供了多種控制選項,可以通過文本、場景布局、運動信息來控制多視圖視頻的生成,也為將來的神經(jīng)仿真器提供了新的可能性。

比如使用文本來改變天氣和光照:

比如行人的生成和前景的編輯:

利用速度和方向的控制:

稀有事件的生成,例如路口掉頭和開進側(cè)方草叢:

結(jié)語

Drive-WM 不僅展示了其強大的多視圖視頻生成能力,也揭示了世界模型與端到端駕駛模型相結(jié)合的巨大潛力。相信在未來,世界模型可以幫助實現(xiàn)更安全、穩(wěn)定、可靠的端到端自動駕駛系統(tǒng)。