撰稿丨諾亞

出品 | 51CTO技術棧(微信號:blog51cto)

兵貴神速。在大模型的必爭之地,谷歌卻總是慢人一步,因而屢屢被調侃“起了大早,趕個晚集”。但昨日,谷歌卻突放大招,發布了一款開放模型——Gemma,并聲稱其是輕量級中“最先進的”開放模型系列,超越了原本最強的Mistral 7B。

這款以拉丁語“寶石”命名的模型在此時推出頗有意味。其一,據谷歌官網介紹,Gemma采用了與創建Gemini模型相同的研究和技術。但相較封閉的Gemini,Gemma的開放無疑會吸引更多人;其二,此前早有消息傳出,Meta可能于近期發布其Llama開源模型系列的最新版本,谷歌先聲奪人,有了攻守易形的味道。

那么Gemma到底表現如何?其“開放”又開放到何種程度?對于開源大模型的未來發展又會產生哪些影響?我們逐一道來。

1、Gemma出世:從個人PC到谷歌云,皆可運行

目前,Gemma開放模型分為兩個版本大小,分別為“Gemma 2B”和“Gemma 7B”,即20億參數和70億參數,以滿足開發人員的不同需求。兩個版本均提供預訓練模型及指令調優變體。

用戶現在即可通過Kaggle、Colab和谷歌云訪問,還可以選擇Hugging Face Transformers等多個框架對Gemma進行推理和微調。

此外,首次使用谷歌云的用戶可以獲得300美元的信用額度。研究人員還可以申請高達50萬美元的谷歌云信用額度,以加速他們的項目進度。

那么,Gemma模型是否可以像開源模型Llama2、Mistral等那樣本地下載并運行呢?對于這一疑問,開發團隊成員也給出了肯定的回答。

“除了支持Python神經網絡框架和ggml作為選項外,我們還提供了一個獨立的C++實現版本,您可以在https://github.com/google/gemma.cpp 下載并在本地運行。”

為更好地支持開發者創新,谷歌同時提供了與模型配套的“負責任生成式AI工具包”。該工具包包含關鍵工具,用于指導和支持開發者利用Gemma構建更安全的人工智能應用。

根據谷歌官方的博客,另外一些值得關注的關鍵細節包括:

- Gemma通過原生Keras 3.0,在所有主要框架(JAX、PyTorch 和 TensorFlow)中提供用于推理和監督微調 (SFT) 的工具鏈。

- 此次發布還包括即用型的Colab和Kaggle筆記本,以及與Hugging Face、MaxText、NVIDIA NeMo、TensorRT-LLM等流行工具的集成。

- 經過預訓練和指令優化的 Gemma 模型能夠在各種平臺上運行,從筆記本電腦、工作站到谷歌云,還可以輕松部署在Vertex AI和Google Kubernetes Engine(GKE)上。

- 針對NVIDIA GPU和Google Cloud TPU進行了優化,以便實現行業領先的性能表現。

- 使用條款允許所有組織(無論規模大小)進行負責任的商業使用和分發。

整體來看,Gemma的發布節奏緊隨Gemini 1.5。后者的上下文窗口容量擴展至100萬個tokens。短短一周,Gemini Ultra 1.0、Gemini 1.5 Pro、Gemma次第登場,如此快速的發布周期,不禁讓人對谷歌的技術進步速度和產品策略更為關注。

2、多項性能基準測試:超越Llama2,捶打Mistral 7B

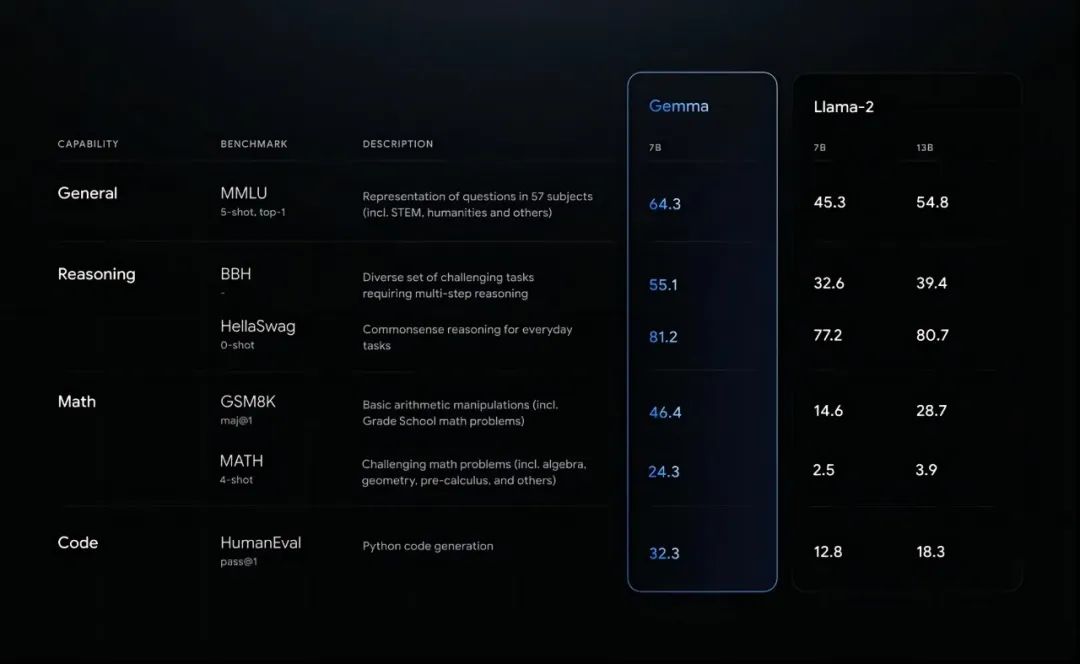

谷歌號稱Gemma具備“同等規模下最領先的性能”,甚至“Gemma 在關鍵基準上明顯超越了更大的模型”。這一說法的根據在于,Gemma在多個基準測試中超越了Llama 2。

圖源:谷歌博客

圖源:谷歌博客

如上圖所示,包括MMLU、HellaSwag以及HumanEval等在內的重要評估標準上,Gemma都取得了比Llama 2更優秀的成績。

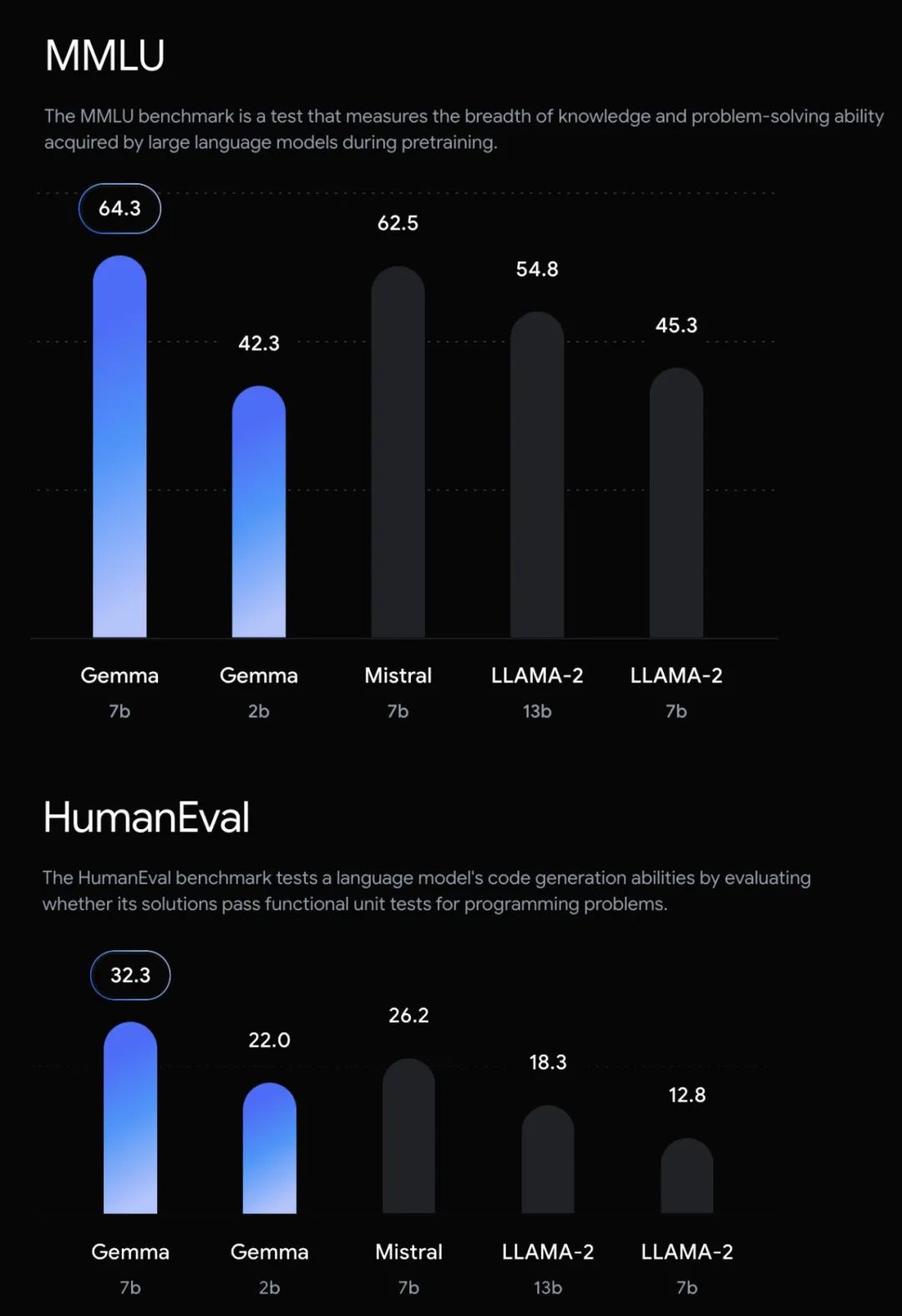

深度學習框架Keras的作者、谷歌人工智能研究員Fran?ois Chollet 在X上貼出了更詳細的對比圖。

圖源:https://twitter.com/fchollet

圖源:https://twitter.com/fchollet

以MMLU(大規模多任務語言理解)為例,如圖所示,Gemma 7B的表現不僅超越了Llama 7B、Llama 13B,還打敗了當紅炸子雞Mistral 7B。

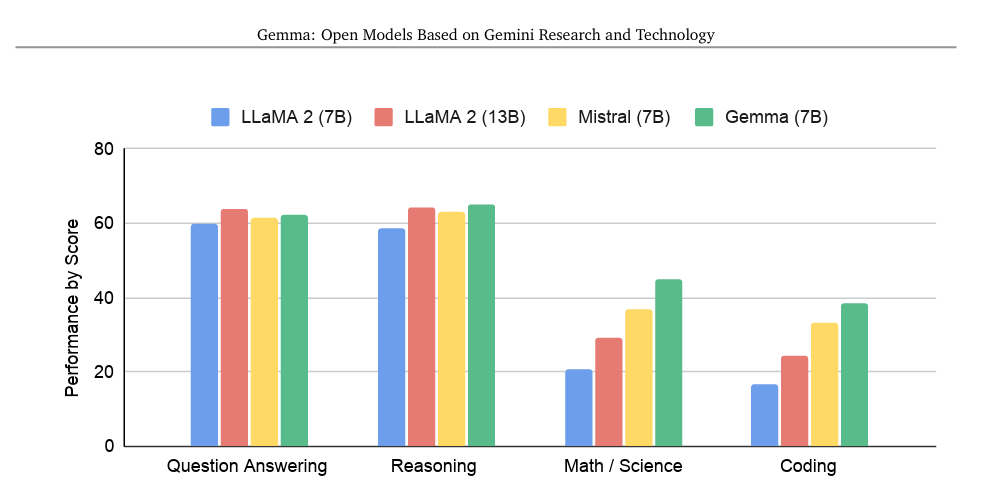

此外,在專門的技術報告里,Gemma 7B在與同等規模開放模型的語言理解和生成性能比較中,谷歌針對不同能力進行了評估。通過將標準學術基準測試按照各自的能力類別,分為問答、推理、數學/科學、編碼四組,并計算了相應得分的平均值。

圖源:谷歌技術報告

圖源:谷歌技術報告

可以看到,在數學/科學、編碼這兩組,Gemma 7B優勢較為明顯;在推理方面,Gemma 7B險勝;在問答方面,Gemma 7B則略遜于Llama 13B。

谷歌官方博文將Gemma在性能方面的出色在表現歸因于:“Gemma 模型與 Gemini 共享技術和基礎設施組件,Gemini 是我們目前廣泛使用的最大、功能最強大的 AI 模型。與其他開放式型號相比,這使得 Gemma 2B 和 7B 能夠在其尺寸上實現一流的性能。Gemma 能夠直接在開發人員筆記本電腦或臺式計算機上運行。值得注意的是,Gemma 在關鍵基準上明顯超越了更大的模型,同時遵守我們對安全和負責任輸出的嚴格標準。”

3、“開放模型”:開源,又不完全開源

Gemma的發布引起了不少討論。開發者們普遍關注到了這樣一個問題:Gemma作為一個開放模型,似乎并未采用真正意義上的“開源”許可。

“盡管被稱為‘開源’,但Gemma模型的權重實際上是根據一個與開源定義不相符的許可協議發布的。它與源代碼可用軟件有更多的共同點,因此應當將其稱為“權重可用模型”。這意味著用戶可以訪問和使用模型的權重文件,但可能受到限制,并不符合傳統開源許可下的自由分發和修改原則。”

那么這類開放模型的“開放”指的到底是什么,又開放到什么程度?

眾所周知,Mistral模型的權重是根據Apache 2.0許可協議發布的,這意味著它們遵循開源原則。但Meta領銜的Llama 2模型的權重則是通過一個專有許可發布,該許可采用了非常有針對性的授權:如果月活用戶數超過 7 億,企業必須從 Meta 申請許可證,而 Meta 會對此類授權進行嚴格設限,這也就意味著亞馬遜、蘋果、谷歌、字節跳動等大公司是受限的。

有Llama 2的前車之鑒,因此不少人質疑Gemma的開放性。而谷歌在這方面的措辭是:“使用條款允許所有組織(無論規模大小)進行負責任的商業使用和分發。”

有人猜測:這是谷歌為了避免重蹈覆轍,受到Llama 2許可中類似這種局限性條款的影響而采取的謹慎做法。

顯而易見的是,AI領域內對于“開放性”的理解和實踐存在顯著分歧。部分項目雖然標榜“開源”,但實際上卻對使用者施加了特定的限制。這種做法可能出于知識產權保護、市場競爭策略以及避免技術濫用等方面的考量,但也引發了關于如何定義和實施真正開放共享的討論。

有意思的是,谷歌在發布Gemma的同時,于其開源博客發布了一篇題為《在Gemini時代負責任地構建開放模型》的文章。文中提到,開源許可證賦予了用戶完全的創作自主權。這是開發人員和最終用戶獲得技術的有力保證。但是在惡意行為者手中,缺乏限制可能會增加風險。

在這樣的背景下,“真正的開放性和透明度,特別是涉及訓練代碼、數據集以及不受限制地訪問和使用模型資源等方面,仍是當前AI社區需要努力實現的目標”。

谷歌將Gemma 模型作為“開放模型”發布,意味著什么呢?“開放模型可以免費訪問模型權重,但使用條款、重新分發和變體所有權因模型的特定使用條款而異,這些條款可能不基于開源許可證。”

“Gemma 模型的使用條款使其免費提供給個人開發人員、研究人員和商業用戶訪問和重新分發。用戶還可以自由創建和發布模型變體。在使用 Gemma 模型時,開發人員同意避免有害使用,這反映了我們致力于負責任地開發 AI,同時增加對這項技術的訪問。”

谷歌表示,“開源”的定義對于計算和創新來說是無價的。然而,現有的開源概念并不總是直接應用于人工智能系統,這引發了如何將開源許可證與人工智能一起使用的問題。“重要的是,我們要發揚開放原則,這些原則使我們在人工智能方面所經歷的巨變成為可能,同時澄清了開源人工智能的概念,并解決了衍生作品和作者歸屬等概念。”

參考鏈接:

https://blog.google/technology/developers/gemma-open-models/

https://storage.googleapis.com/deepmind-media/gemma/gemma-report.pdf

https://news.ycombinator.com/item?id=39453271

https://opensource.googleblog.com/2024/02/building-open-models-responsibly-gemini-era.html