Qwen重磅發布:首個端到端全模態AI模型Qwen3-Omni登場

阿里殺瘋了,Qwen團隊剛剛接連發布了兩款重要模型:Qwen3-Omni,業界首個原生端到端全模態AI模型;以及Qwen-Image-Edit-2509,對標谷歌nano banana 圖像編輯工具,根據預告,明天還有“大的”要發布。

Qwen3-Omni:真正的一體化AI

Qwen3-Omni的問世,旨在解決長期以來多模態模型需要在不同能力之間進行權衡取舍的難題。它是一款真正意義上的全能選手,在同一個模型中無縫統一了文本、圖像、音頻和視頻的處理能力。

web端體驗:

https://chat.qwen.ai/?models=qwen3-omni-flash

抱抱臉上這個體驗demo,可以直接去這里體驗

https://huggingface.co/spaces/Qwen/Qwen3-Omni-Demo

核心亮點:

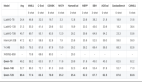

性能卓越:在36項音頻及音視頻基準測試中,Qwen3-Omni在其中22項上達到了業界頂尖水平(SOTA)。

全球化的語言能力:模型能力覆蓋廣泛,支持119種語言的文本處理、19種語言的語音輸入以及10種語言的語音輸出

極致高效:延遲僅為211毫秒,并能輕松理解長達30分鐘的音頻內容

高度可控:支持通過系統提示詞(System Prompts)進行完全自定義,滿足個性化需求

功能強大:內置工具調用(Tool Calling)功能,可與其他應用和服務輕松集成。

開源字幕模型:同時開源了一個低幻覺的Captioner(字幕生成)模型,為音視頻內容處理提供了可靠工具

開源

為了推動技術發展和應用創新,Qwen團隊已開源了Qwen3-Omni-30B-A3B-Instruct、Qwen3-Omni-30B-A3B-ThinkingQwen3-Omni-30B-A3B-Captioner等多個版本,旨在賦能全球開發者,探索從指令遵循到創意任務等多樣化的應用場景。

https://huggingface.co/Qwen/Qwen3-Omni-30B-A3B-Instruct

Qwen-Image-Edit-2509

這是Qwen-Image升級版本,和字節前幾天發布的即夢4.0圖像模型一樣主要是一致性上巨大提升。

多圖編輯,無縫融合,現在,可以將“人物+產品”或“人物+場景”等多張圖片拖入編輯,保持一致性同時進行推理。

單圖編輯,高度一致:

人臉保真:無論變換姿勢、濾鏡還是風格,人物的面部特征始終保持一致

產品保真:在廣告、海報等應用中,產品能維持其核心特征,確保品牌識別度

文字編輯:支持對圖像中的文字進行全面修改,包括內容、字體、顏色,甚至材質紋理

內置ControlNet,精準控制深度、邊緣、關鍵點……Qwen-Image-Edit-2509內置了強大的ControlNet功能,讓用戶可以即插即用,實現對圖像生成的精準控制

qwen的發布博客里有詳細清晰的示例,大家可以去看看: