谷歌130億參數多語言模型mT5重磅來襲,101種語言輕松遷移

Facebook剛剛開源多語種機器翻譯模型「M2M-100」,這邊谷歌也來了。谷歌宣布,基于T5的mT5多語言模型正式開源,最大模型130億參數,與Facebook的M2M相比,參數少了,而且支持更多語種。

前幾天,Facebook發了一個百種語言互譯的模型M2M-100,這邊谷歌著急了,翻譯可是我的老本行啊。

剛剛,谷歌也放出了一個名為 mT5的模型,在一系列英語自然處理任務上制服了各種SOTA。

你發,我也發,你支持100種,我支持101種!(雖然多這一種沒有多大意義,但氣勢上不能輸)

mT5是谷歌 T5模型的多語種變體,訓練的數據集涵蓋了101種語言,包含3億至130億個參數,從參數量來看,的確是一個超大模型。

多語言模型是AI的橋梁,但難以避免「有毒」輸出

世界上成體系的語言現在大概有7000種,縱然人工智能在計算機視覺、語音識別等領域已經超越了人類,但只局限在少數幾種語言。

想把通用的AI能力,遷移到一個小語種上,幾乎相當于從頭再來,有點得不償失。

所以跨語種成為了AI能力遷移的重要橋梁。

多語言人工智能模型設計的目標就是建立一個能夠理解世界上大部分語言的模型。

多語言人工智能模型可以在相似的語言之間共享信息,降低對數據和資源的依賴,并且允許少樣本或零樣本學習。隨著模型規模的擴大,往往需要更大的數據集。

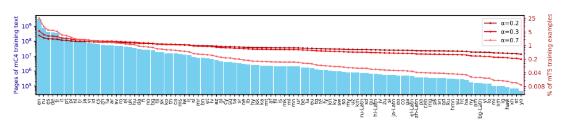

C4是從公共網站獲得的大約750gb 的英文文本的集合,mC4是 C4的一個變體,C4數據集主要為英語任務設計,mC4搜集了過去71個月的網頁數據,涵蓋了107種語言,這比 C4使用的源數據要多得多。

mC4中各種語言的網頁數量

有證據表明,語言模型會放大數據集中存在的偏差。

雖然一些研究人員聲稱,目前的機器學習技術難以避免「有毒」的輸出,但是谷歌的研究人員一直在試圖減輕 mT5的偏見,比如過濾數據中含有偏激語言的頁面,使用 cld3檢測頁面的語言,將置信度低于70% 的頁面直接刪除。

mT5:使用250000詞匯,多語言數據采樣策略是關鍵

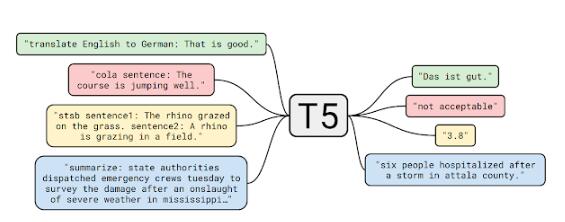

mT5的模型架構和訓練過程與T5十分相似,mT5基于T5中的一些技巧,比如使用GeGLU的非線性(Shazeer,2020年),在較大模型中縮放dmodel而不是dff來對T5進行改進,并且僅對未標記的數據進行預訓練而不會出現信息丟失。

訓練多語言模型的最重要的一點是如何從每種語言中采樣數據。

但是,這種選擇是零和博弈:如果對低資源語言的采樣過于頻繁,則該模型可能會過擬合;如果對高資源語言的訓練不夠充分,則模型的通用性會受限。

因此,研究團隊采用Devlin和Arivazhagan等人使用的方法,并根據概率p(L)∝ | L |^α,對資源較少的語言進行采樣。其中p(L)是在預訓練期間從給定語言中采樣的概率,| L |是該語言中樣本的數量,α是個超參數,谷歌經過實驗發現α取0.3的效果最好。

為了適應更多的語言,mT5將詞匯量增加到250,000個單詞。與T5一樣,使用SentencePiece和wordPiece來訓練模型。

Sentencepiece示意

那采樣之后有的字符沒覆蓋到怎么辦?

研究團隊為了適應具有大字符集的語言(比如中文),使用了0.99999的字符覆蓋率,但還啟用了SentencePiece的「字節后退」功能,以確保可以唯一編碼任何字符串。

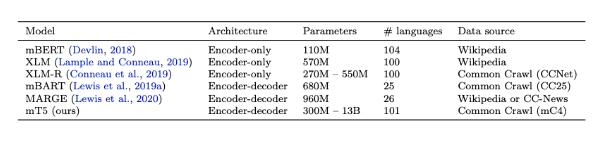

為了讓結果更直觀,研究人員與現有的大規模多語言預訓練語言模型進行了簡要比較,主要是支持數十種語言的模型。

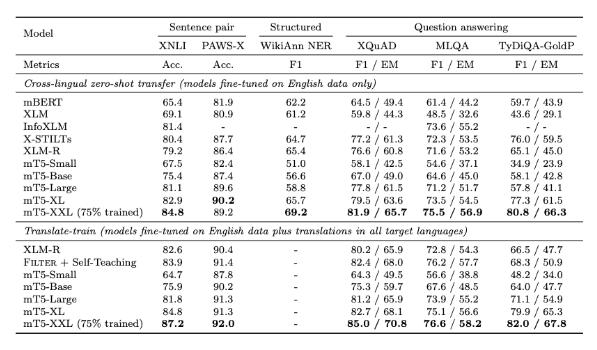

mT5專治各種SOTA,但基準測試未必能代表實力

截至2020年10月,實驗中最大 mT5模型擁有130億個參數,超過了所有測試基準,包括來自 XTREME 多語言基準測試的5個任務,涵蓋14種語言的 XNLI 衍生任務,分別有10種、7種和11種語言的 XQuAD、 MLQA 和 TyDi QA/閱讀理解基準測試,以及有7種語言的 PAWS-X 釋義識別。

實驗結果可以看到,在閱讀理解、機器問答等各項基準測試中mT5模型都優于之前的預訓練語言模型。

至于基準測試能否充分反映模型在生產環境中的表現,就另當別論了。

對預訓練語言模型最直白的測試方法就是開放域問答,看訓練后的模型能否回答沒見過的新問題,目前來看,即使強如GPT-3,也經常答非所問。

但是谷歌的研究人員斷言,mT5是向功能強大的模型邁出的一步,而這些模型不需要復雜的建模技術。

總的來說,mT5展示出了跨語言表征學習中的重要性,并表明了通過過濾、并行數據或其他一些調優技巧,實現跨語言能力遷移是可行的。

這個源自T5的模型,完全適用于多語言環境。