一部iPhone實時渲染300平房間,精度達厘米級別!谷歌最新研究證明NeRF沒死

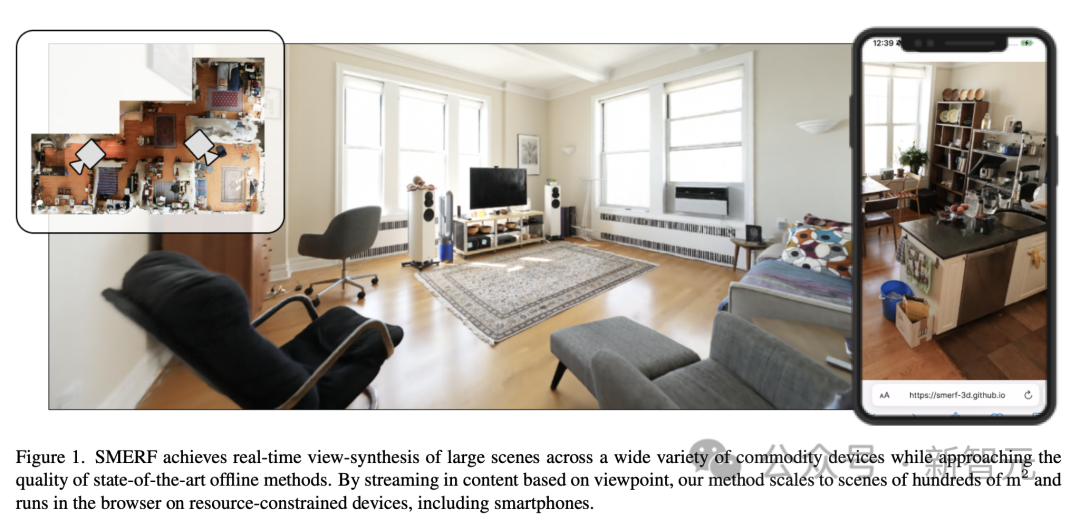

3D實時渲染大型場景,一臺電腦,甚至一部手機就可以完成。

從家里的客廳到主臥,儲物間,廚房,衛生間各個死角,都能逼真在電腦中完成渲染,如同拍攝實物視頻一般。

而且,你還可以在一臺iPhone上完成復雜場景渲染。

來自谷歌、谷歌DeepMind和圖賓根大學的研究人員最近提出了一種全新技術SMERF。

它可以在智能手機和筆記本電腦各種設備上實時渲染大型視圖場景。

論文地址:https://arxiv.org/pdf/2312.07541.pdf

本質上講,SMERF是一種基于NeRFs的方法,依賴于內存效率更高的MERF(Memory-Efficient Radiance Fields)。

NeRF已死?

當前,輻射場(Radiance fields)已成為一種強大且易于優化的表示形式,用于重建和重新渲染逼真的真實3D場景。

與網格和點云等顯式表示相反,輻射場通常存儲為神經網絡并使用體積射線行進進行渲染。

在給定足夠大的計算預算的情況下,神經網絡可以簡明地表示復雜的幾何形狀和依賴于視圖的效果。

作為體積表示,渲染圖像所需的操作數量以像素數量而不是圖元(例如三角形)的數量為單位,性能最佳的模型需要數千萬次網絡評估。

因此,輻射場的實時方法在質量、速度或表示大小方面做出了讓步,并且這種表示是否可以與高斯潑濺(Gaussian Splatting )等替代方法競爭,仍然是一個懸而未決的問題。

最新研究中,作者提出了一種可擴展的方法,從而實現比以往更高保真度的實時大空間渲染。

SMERF實時渲染,精度達厘米級別

SMERF專門為學習大型3D表示所設計,比如房屋的渲染。

谷歌等研究人員結合一種分層模型劃分的方案,其中空間的不同部分和學習參數由不同的MERF表示。

這不僅增加了模型容量,而且同時限制了計算和內存要求。因為類似這樣大型的3D表示是無法用經典NERF進行實時渲染。

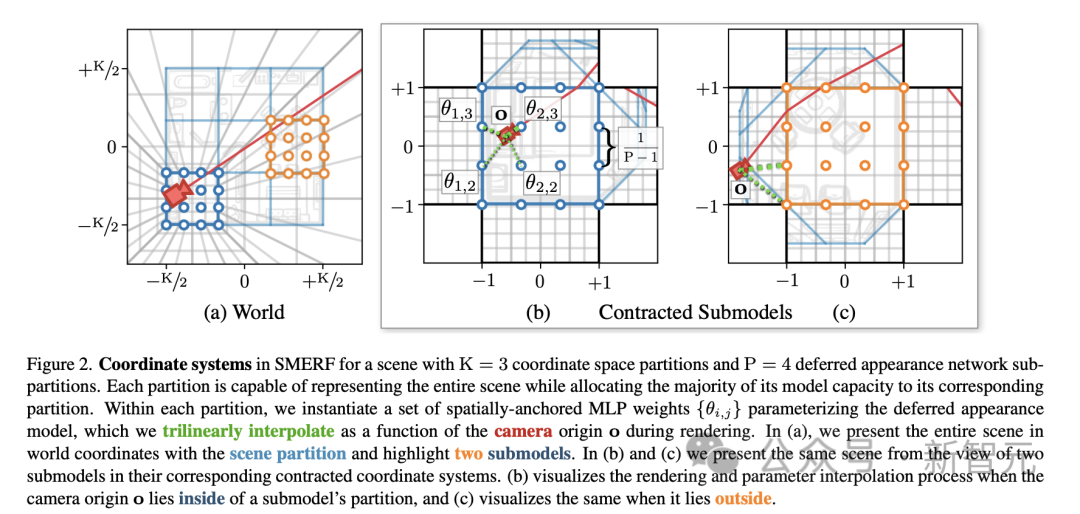

SMERF中有K=3坐標空間分區和P=4延遲外觀網絡子分區的場景的坐標系

為了提升SMERF的渲染質量,研究團隊還使用了一種「教師—學生」的蒸餾方法。

在這個方法中,已經訓練好的高質量Zip-Nerf模型(教師),被用來訓練一個新的MERF模型(學生)。

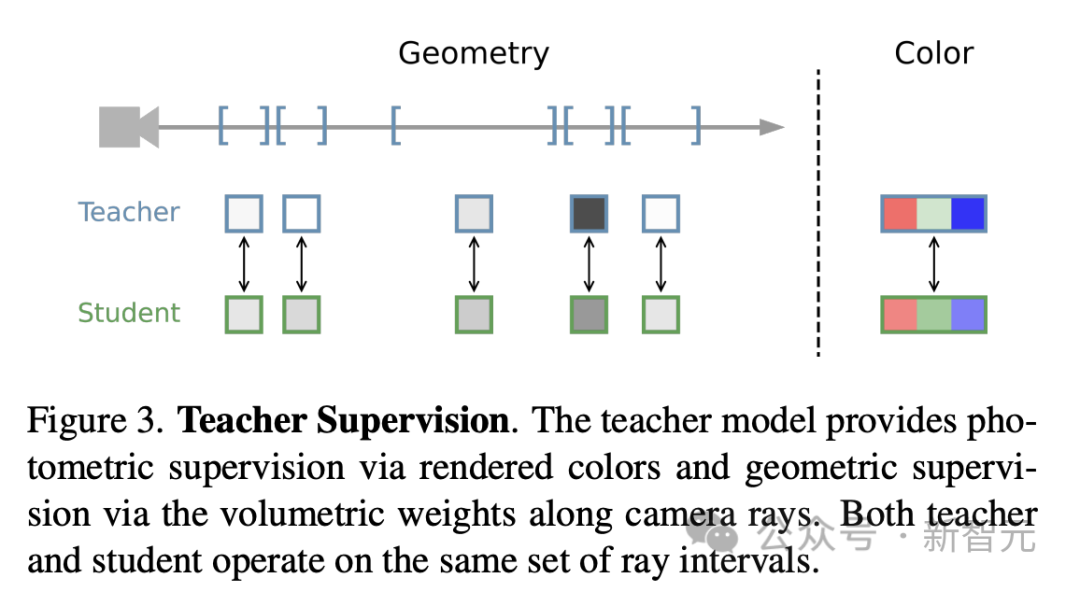

如下圖,「教師監督」的整體流程。教師模型通過渲染顏色提供光度監督,并通過沿相機光線的體積權重提供幾何監督。教師和學生都在同一組光線間隔上進行操作。

這種方法可以讓研究人員將功能強大的Zip-Nerf模型的細節和圖像質量,轉移到更高效、更快的結構上。

這對智能手機和筆記本電腦等功能較弱的設備上的應用尤其有用。

實驗評估

研究人員首先在Zip-NeRF引入的4大場景上評估了方法:柏林、阿拉米達、倫敦和紐約。

這些場景中的每一個都是使用180°魚眼鏡頭拍攝的1,000-2,000 張照片。為了與3DGS進行全面比較,研究人員將照片裁剪為110°,并使用COLMAP重新估計相機參數。

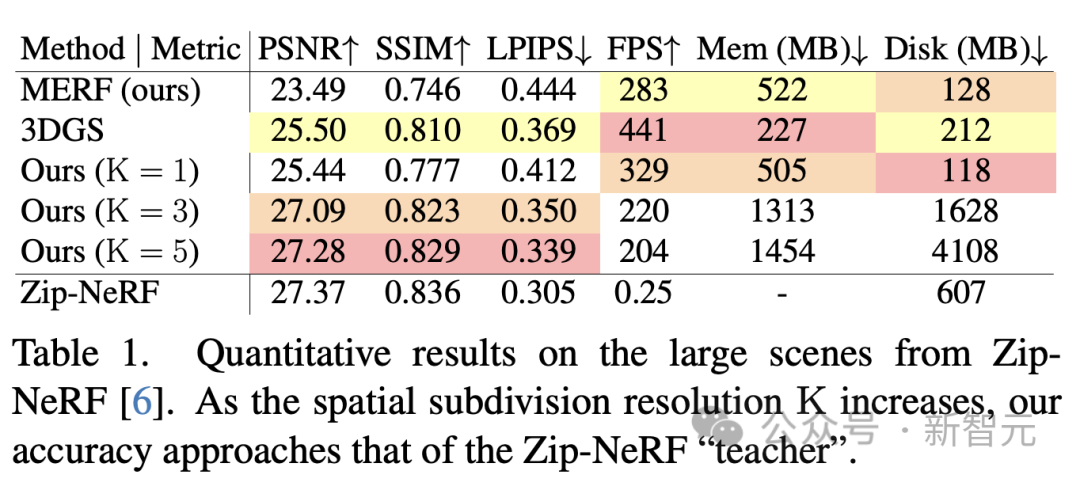

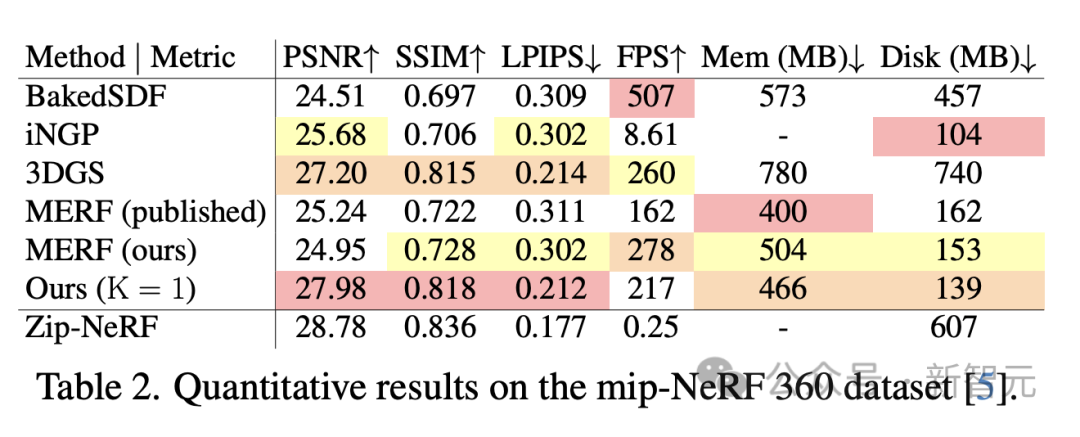

表1所示的結果表明,對于適度的空間細分K,最新方法的精度大大超過了MERF和3DGS。

隨著K的增加,模型的重建精度提高,并接近其 Zip-NeRF老師的精度,在K=5時差距小于0.1 PSNR和0.01 SSIM。

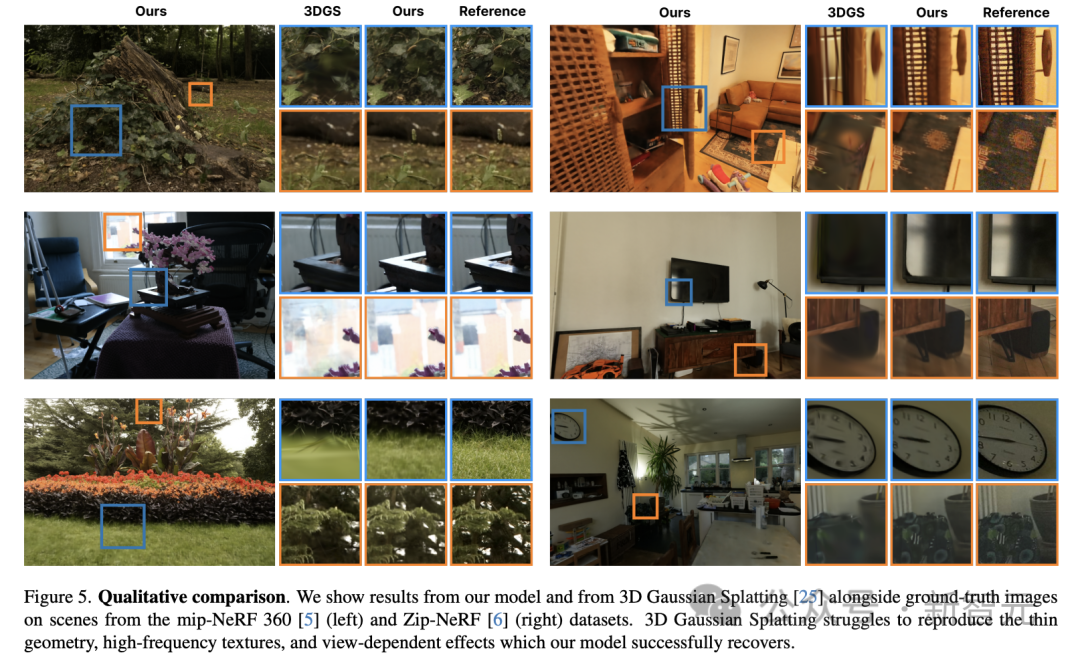

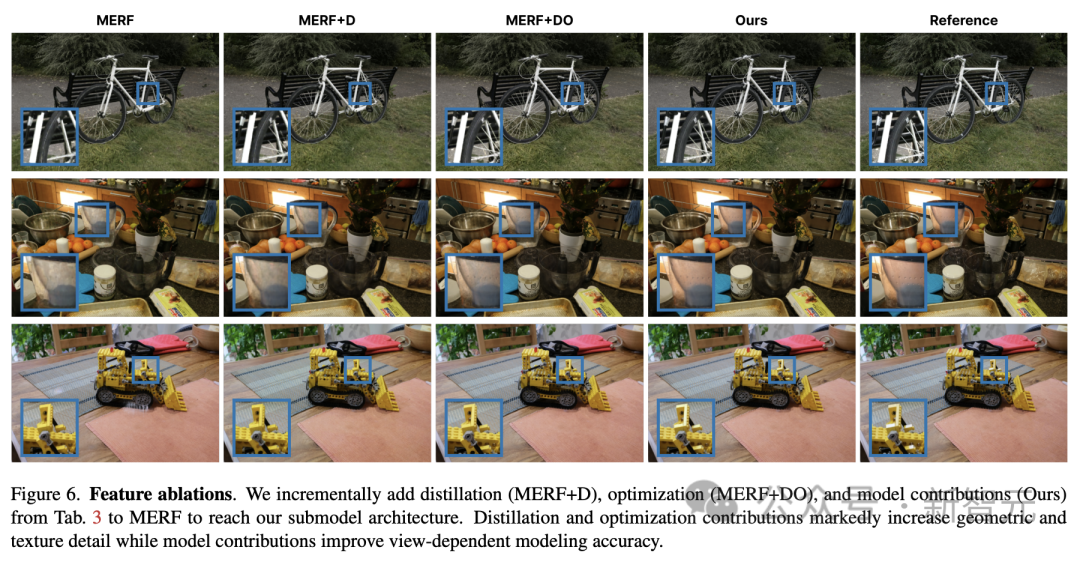

研究人員還發現這些定量的改進低估了重建的定性改進準確性,如圖5所示。

在大型場景中,SMERF方法一致地對薄幾何體、高頻紋理、鏡面高光和實時基線達不到的遠處內容進行建模。

同時,研究人員發現增加子模型分辨率自然會提高質量,特別是在高頻紋理方面。

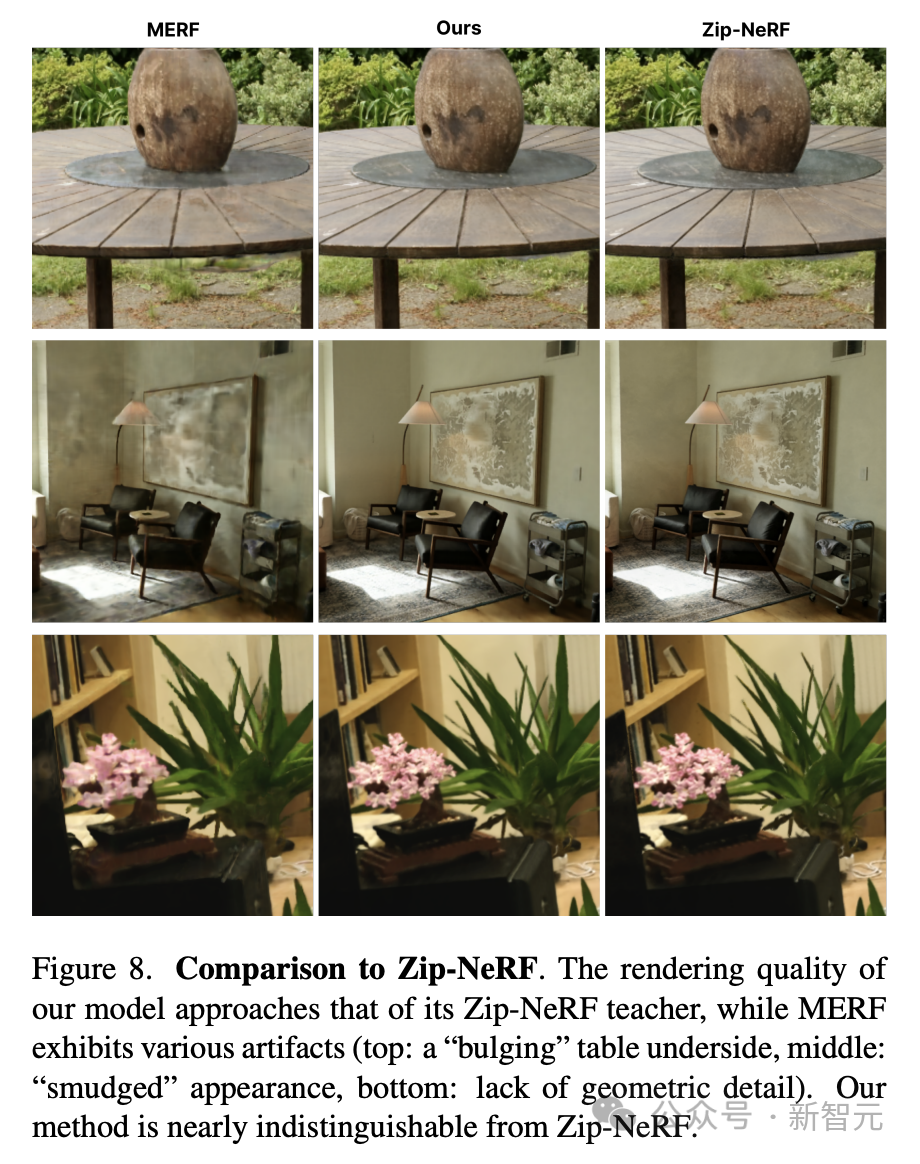

實際上,研究人員發現最新渲染方法與Zip-NeRF幾乎沒有區別,如圖8所示。

此外,研究人員在室內和室外場景的mip-NeRF 360數據集上進一步評估了最新方法。

這些場景比Zip-NeRF數據集中的場景小得多,因此無需空間細分即可獲得高質量結果。如表2所示,模型的K=1版本在圖像質量方面優于該基準測試中的所有先前實時模型,渲染速度與3DGS相當。

圖6和圖8定性地說明了這種改進,研究人員提出的方法在表示高頻幾何和紋理方面要好得多,同時消除了分散注意力的漂浮物和霧。

網頁即可傳輸逼真3D空間

一旦經過訓練,SMERF就可以在瀏覽器匯總實現完全6個自由度的導航,并在流行的智能手機和筆記本電腦上進行實時渲染。

人人都知,實時渲染的大型3D場景的能力對于各種應用非常重要,包括視頻游戲、虛擬增強現實,以及專業設計和架構應用程序。

比如,谷歌沉浸式地圖中,可以進行實時導航。

不過谷歌等團隊提出的最新方法也有一定的局限性。雖然SMERF有出色的重建質量和存儲效率,但存儲成本高、加載時間長、訓練工作量大。

不過,這項研究表明,與三維高斯拼接法相比,NeRFs和類似的輻射場在未來仍具有優勢。