這些VLM竟都是盲人?GPT-4o、Sonnet-3.5相繼敗于「視力」測試

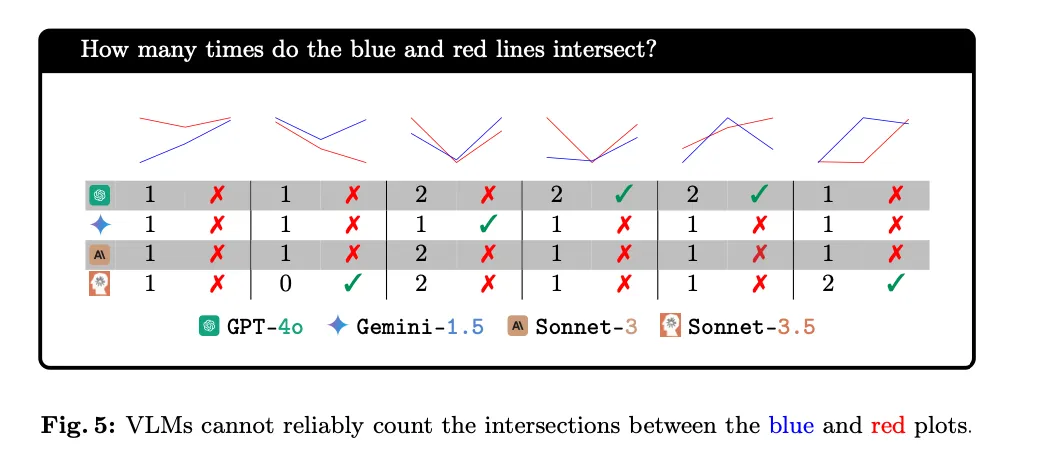

讓現(xiàn)在最火的 SOTA 模型們(GPT-4o,Gemini-1.5,Sonnet-3,Sonnet-3.5)數(shù)一數(shù)兩條線有幾個交點(diǎn),他們表現(xiàn)會比人類好嗎?

答案很可能是否定的。

自 GPT-4V 推出以來,視覺語言模型 (VLMs) 讓大模型的智能程度朝著我們想象中的人工智能水平躍升了一大步。

VLMs 既能看懂畫面,又能用語言來描述看到的東西,并基于這些理解來執(zhí)行復(fù)雜的任務(wù)。比如,給 VLM 模型發(fā)去一張餐桌的圖片,再發(fā)一張菜單的圖片,它就能從兩張圖中分別提取啤酒瓶的數(shù)量和菜單上的單價,算出這頓飯買啤酒花了多少錢。

VLMs 的進(jìn)步如此之快,以至于讓模型找出這張圖中有沒有一些不合常理的「抽象元素」,例如,讓模型鑒定圖中有沒有一個人正在飛馳的出租車上熨衣服,成為了一種通行的測評方式。

然而,目前的基準(zhǔn)測試集并不能很好地評估 VLMs 的視覺能力。以 MMMU 為例,其中有 42.9% 的問題不需要看圖,就能解決,也就是說,許多答案可以僅通過文本問題和選項(xiàng)推斷出來。其次,現(xiàn)在 VLM 展示出的能力,很大程度上是「背記」大規(guī)模互聯(lián)網(wǎng)數(shù)據(jù)的結(jié)果。這導(dǎo)致了 VLMs 在測試集中的得分很高,但這并不代表這個判斷成立:VLM 可以像人類一樣感知圖像嗎?

為了得到這個問題的答案,來自奧本大學(xué)和阿爾伯塔大學(xué)的研究者決定給 VLMs「測測視力」。從驗(yàn)光師的「視力測試」處得到了啟發(fā),他們讓:GPT-4o、Gemini-1.5 Pro 、Claude-3 Sonnet 和 Claude-3.5 Sonnet 這四款頂級 VLM 做了一套「視力測試題」。

- 論文標(biāo)題:Vision language models are blind

- 論文鏈接:https://arxiv.org/pdf/2407.06581

- 項(xiàng)目鏈接:https://vlmsareblind.github.io/

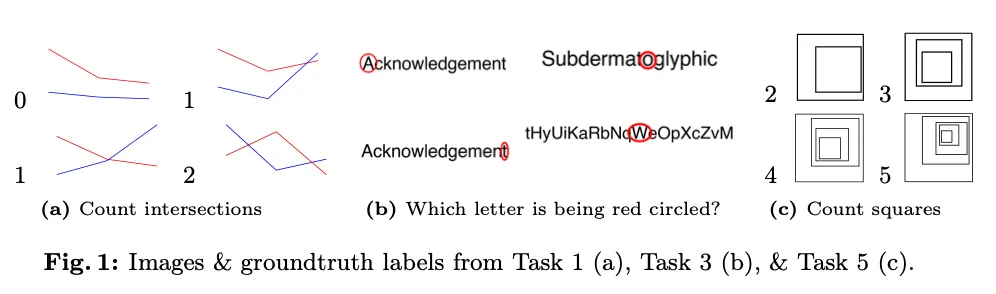

這套題很簡單,例如,數(shù)兩條線有幾個交點(diǎn),識別是哪個字母被紅圈標(biāo)出來了,幾乎不需要任何世界知識。測試結(jié)果令人震驚,VLMs 實(shí)際上都「近視」,圖片的細(xì)節(jié)在它們看來實(shí)際是模糊的。

VLM 瞎不瞎?七大任務(wù),一測便知

為了避免 VLMs 從互聯(lián)網(wǎng)數(shù)據(jù)集中直接「抄答案」,論文作者設(shè)計(jì)了一套全新的「視力測試」。論文作者選擇讓 VLMs 判斷空間中幾何圖形之間的關(guān)系,例如兩個圖形是否相交。因?yàn)檫@些圖案在白色畫布上的空間信息,通常無法用自然語言描述。

人類在處理這些信息時,將通過「視覺大腦」感知。但對于 VLMs 來說,它們所依靠的是在模型的初期階段將圖像特征和文本特征結(jié)合起來,即將視覺編碼器集成到大型語言模型中,這本質(zhì)上是一個沒有眼睛的知識大腦。

初步實(shí)驗(yàn)表明,VLMs 在面對人類視力測試,比如我們每個人都測過的顛來倒去的「E」視力表等等,它們的表現(xiàn)已經(jīng)非常驚艷。

測試與結(jié)果

第一關(guān):數(shù)一數(shù)線條之間有幾個交點(diǎn)?

論文作者在白色背景上創(chuàng)建了 150 幅含有兩條線段的圖像。這些線段的 x 坐標(biāo)固定并等間距分布,而 y 坐標(biāo)則是隨機(jī)生成的。兩條線段之間的交點(diǎn)只有 0 個、1 個、2 個三種情況。

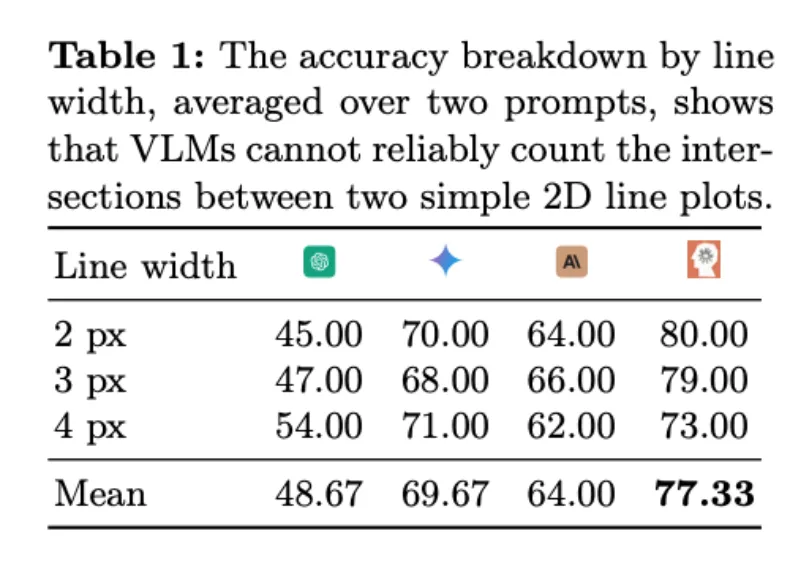

如圖 5 所示,在兩版提示詞和三版線段粗細(xì)不同的測試中,所有 VLMs 在這個簡單任務(wù)上表現(xiàn)都不佳。

擁有最佳準(zhǔn)確率的 Sonnet-3.5 也僅為 77.33%(見表 1)。

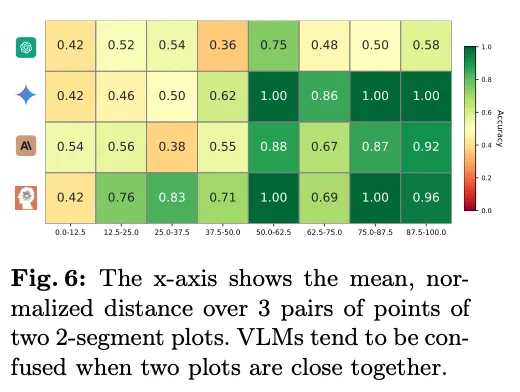

更具體地說,當(dāng)兩條線之間的距離縮小時,VLMs 的表現(xiàn)往往更差(見下方圖 6)。由于每個線圖由三個關(guān)鍵點(diǎn)組成,兩條線之間的距離計(jì)算為三個對應(yīng)點(diǎn)對的平均距離。

該結(jié)果與 VLMs 在 ChartQA 上的高準(zhǔn)確率形成鮮明對比,這表明 VLMs 能夠識別線圖的整體趨勢,但無法「放大」以看到類似于「哪些線條相交了」這種細(xì)節(jié)。

第二關(guān):判斷兩個圓之間的位置關(guān)系

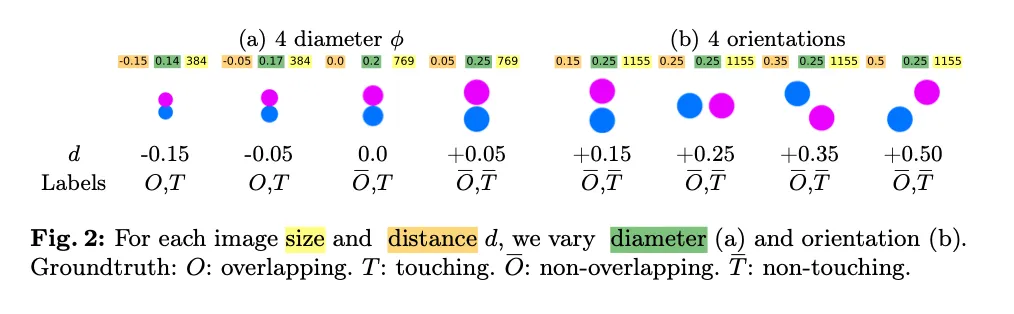

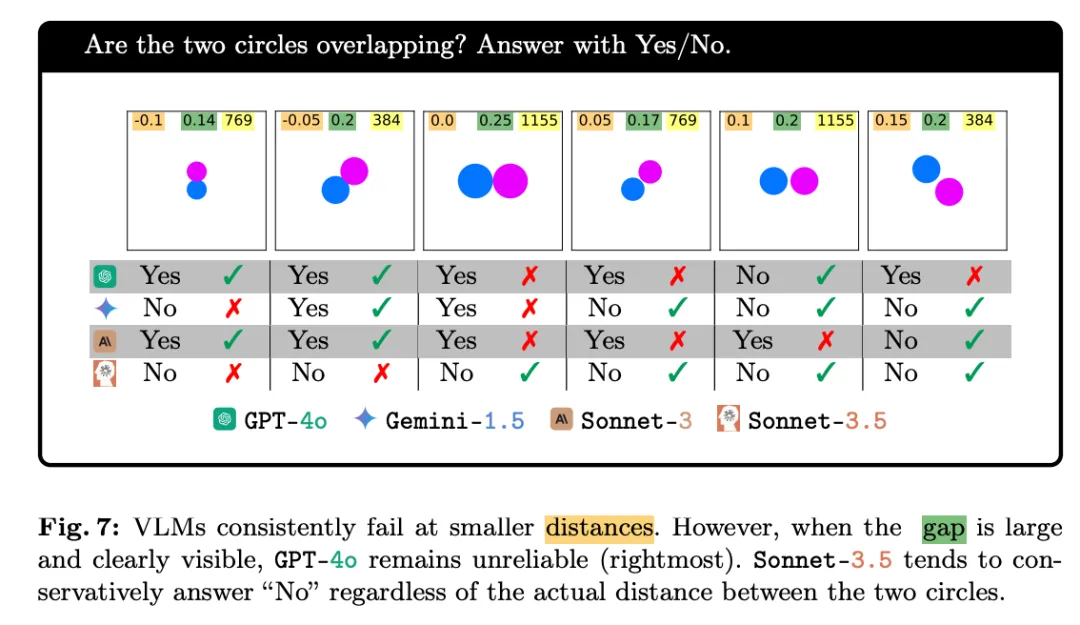

如圖所示,論文作者在一個給定大小的畫布上,隨機(jī)生成兩個大小一致的圓。兩個圓的位置關(guān)系只有三種情況:相交、相切和相離。

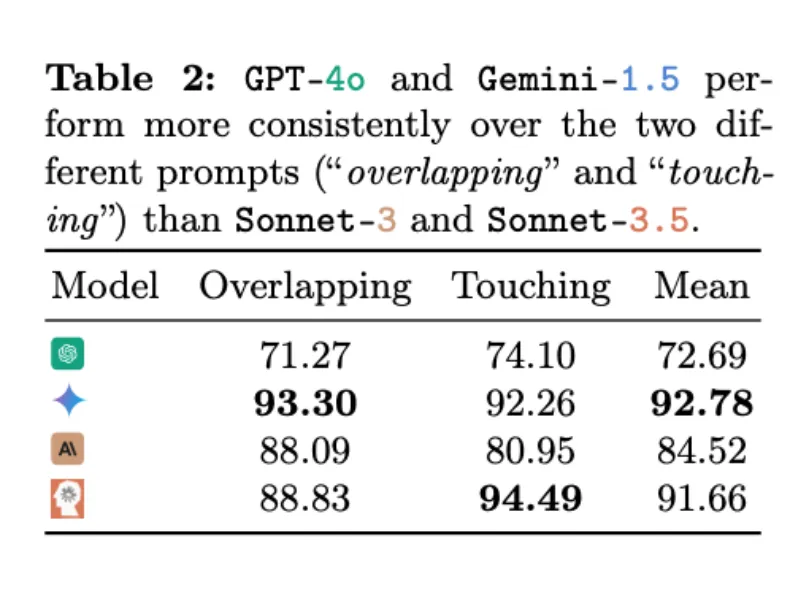

令人驚訝的是,在這個對人類來說直觀可見,一眼就能看出答案的的任務(wù)中,沒有一個 VLM 能夠完美地給出答案(見圖 7)。

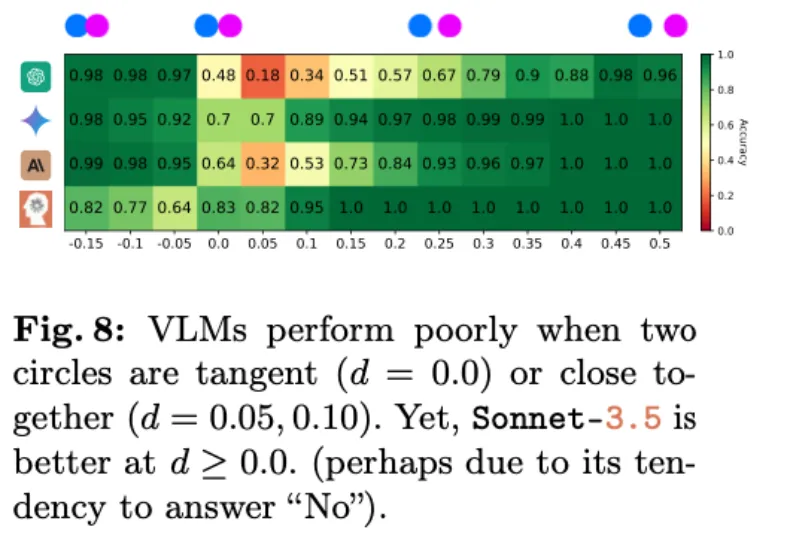

準(zhǔn)確率最佳(92.78%)的模型是 Gemini-1.5(見表 2)。

在實(shí)驗(yàn)中,有一種情況頻繁出現(xiàn):當(dāng)兩個圓靠得很近時,VLMs 往往表現(xiàn)不佳,但會做出有根據(jù)的推測。如下圖所示,Sonnet-3.5 通常保守地回答「否」。

如圖 8 所示,即使當(dāng)兩個圓之間的距離相差得很遠(yuǎn),有一個半徑(d = 0.5)這么寬時,準(zhǔn)確率最差的 GPT-4o 也做不到 100% 準(zhǔn)確。

也就是說,VLM 的視覺似乎不夠清晰,無法看到兩個圓之間的細(xì)小間隙或交點(diǎn)。

第三關(guān):有幾個字母被紅圈圈起來了?

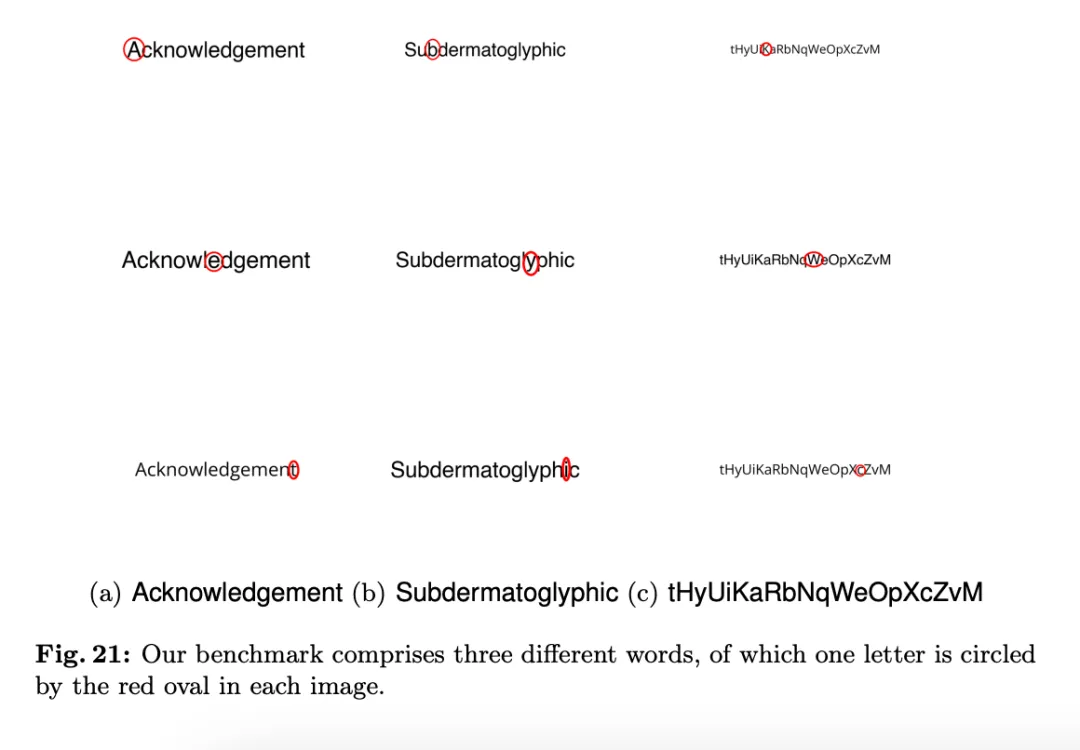

由于一個單詞間字母之間的間隔很小,論文作者們假設(shè):如果 VLMs「近視」,那么它們是沒辦法識別出被紅圈圈出的字母的。

因此,他們選擇了「Acknowledgement」、「Subdermatoglyphic」和「tHyUiKaRbNqWeOpXcZvM」這樣的字符串。隨機(jī)生成紅圈圈出字符串中的某個字母,作為測試。

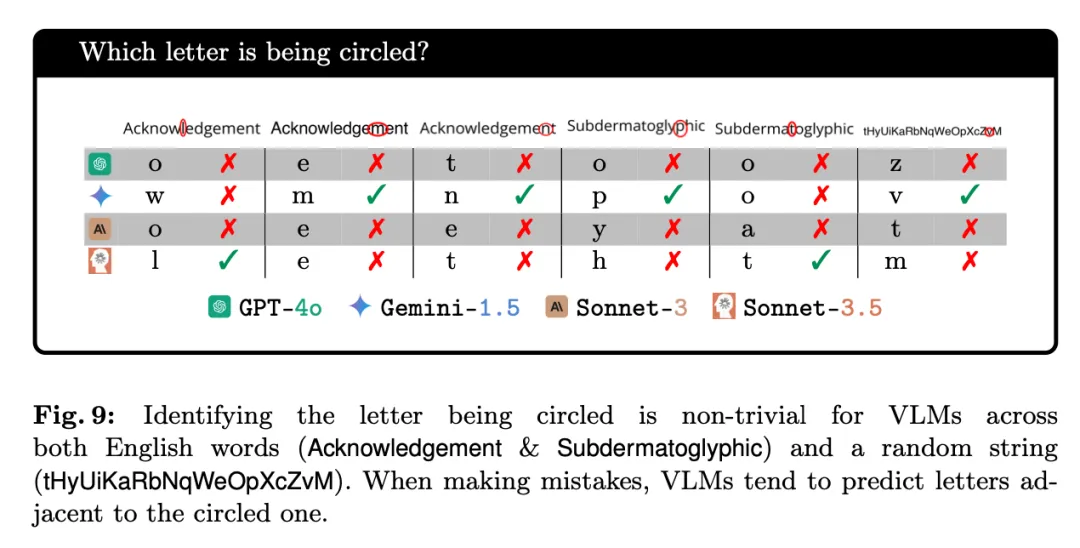

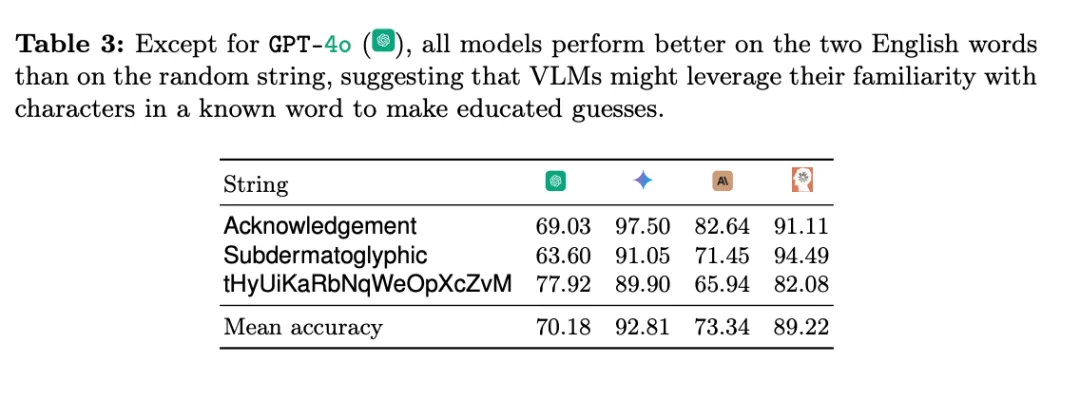

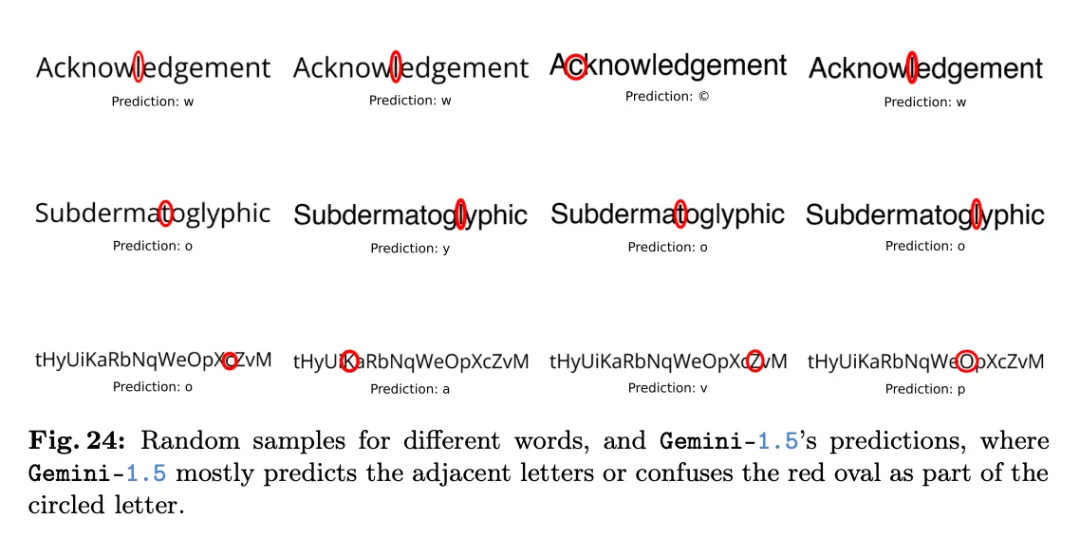

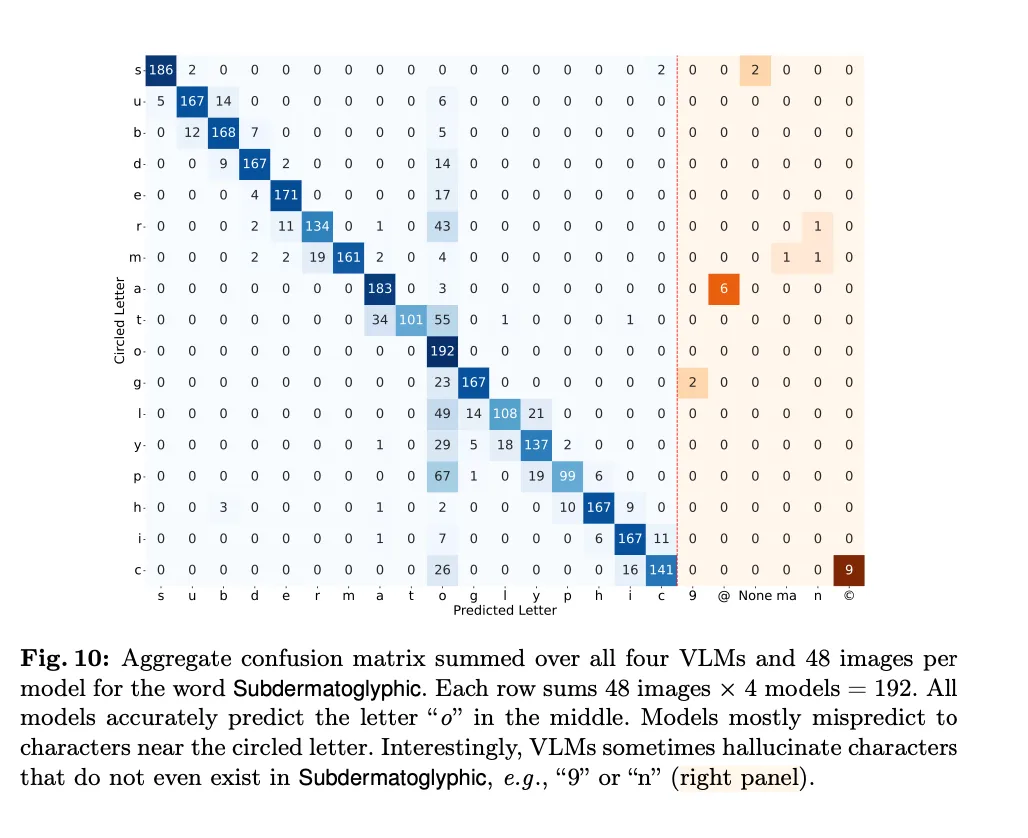

測試結(jié)果說明,被測模型在這一關(guān)的表現(xiàn)都很差(見圖 9 和表 3)。

例如,當(dāng)字母被紅圈輕微遮擋時,視覺語言模型往往會出錯。它們經(jīng)常混淆紅圈旁邊的字母。有時模型會產(chǎn)生幻覺,例如,盡管能夠準(zhǔn)確拼寫單詞,但會給單詞中添加(例如,「9」,「n」,「?」)等亂碼。

除了 GPT-4o 之外,所有模型在單詞上的表現(xiàn)都略好于隨機(jī)字符串,這表明知道單詞的拼寫可能有助于視覺語言模型做出判斷,從而略微提高準(zhǔn)確性。

Gemini-1.5 和 Sonnet-3.5 是排名前二的模型,準(zhǔn)確率分別為 92.81% 和 89.22%,并且比 GPT-4o 和 Sonnet-3 的表現(xiàn)近乎高出近 20%。

第四關(guān)和第五關(guān):重疊的圖形有幾個?有幾個「套娃」正方形?

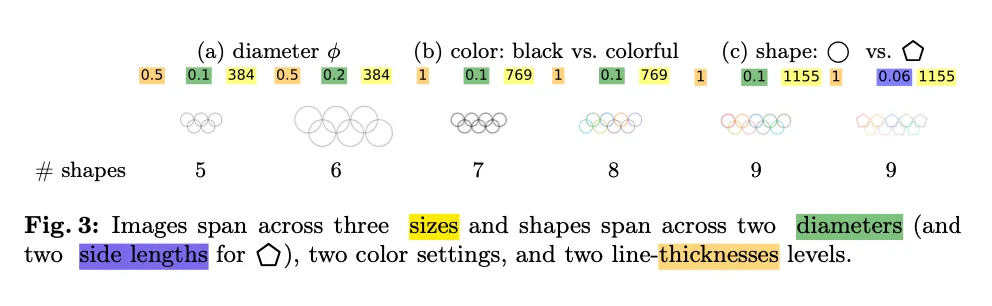

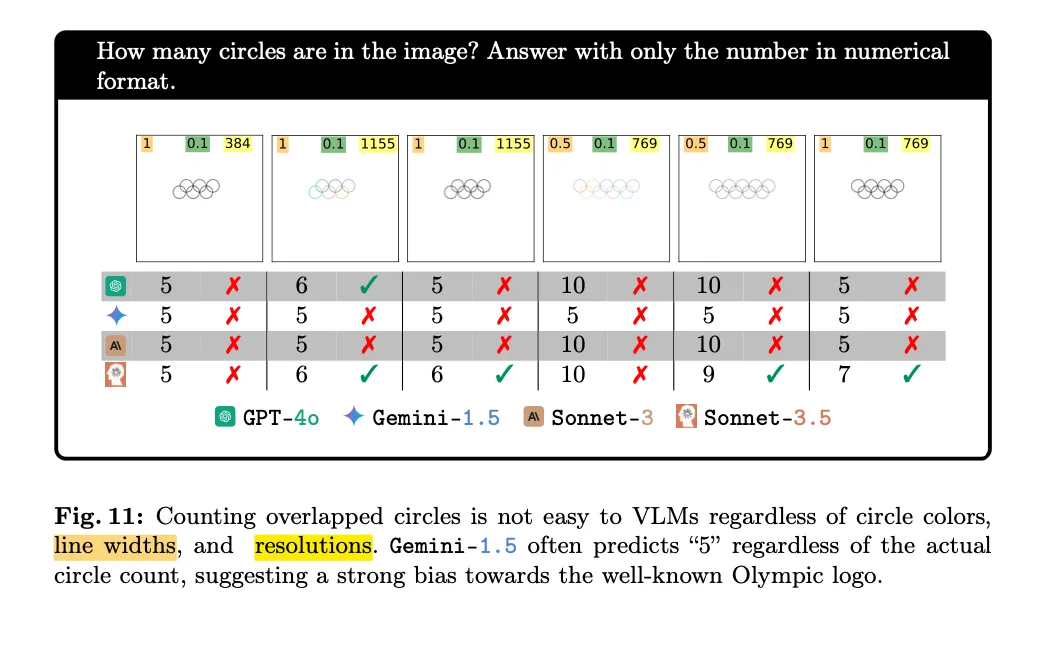

假設(shè) VLMs「近視」,那么它們可能無法清晰地看到類似于「奧運(yùn)五環(huán)」這樣的圖案,每兩個圓圈之間的交叉點(diǎn)。為此,論文作者隨機(jī)生成了 60 組類似于「奧運(yùn)五環(huán)」的圖案,讓 VLMs 數(shù)一數(shù)它們重疊的圖形有幾個。他們也生成了五邊形版的「奧運(yùn)五環(huán)」進(jìn)一步測試。

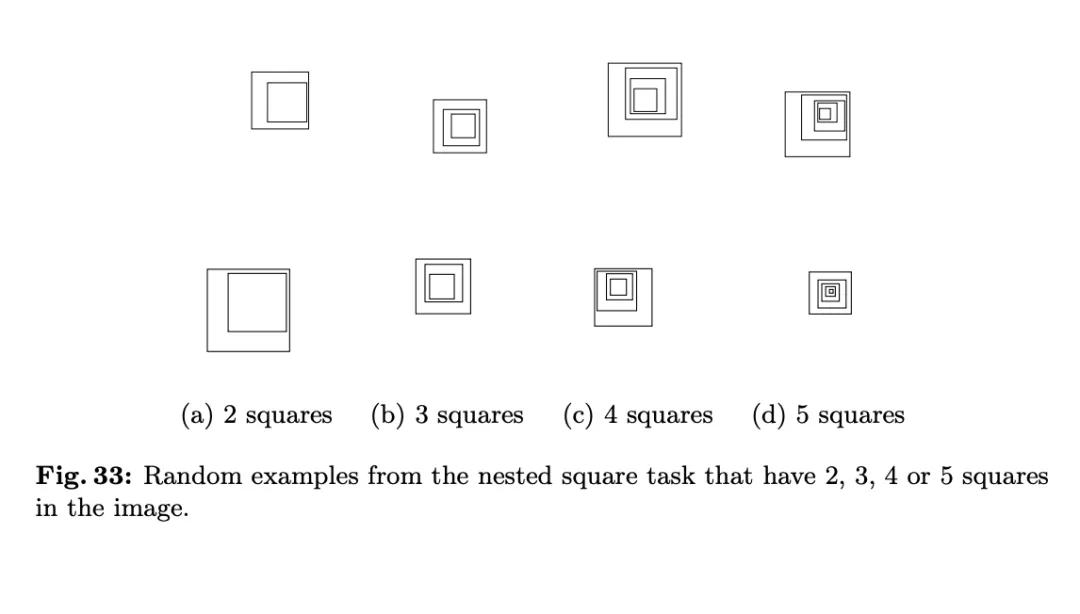

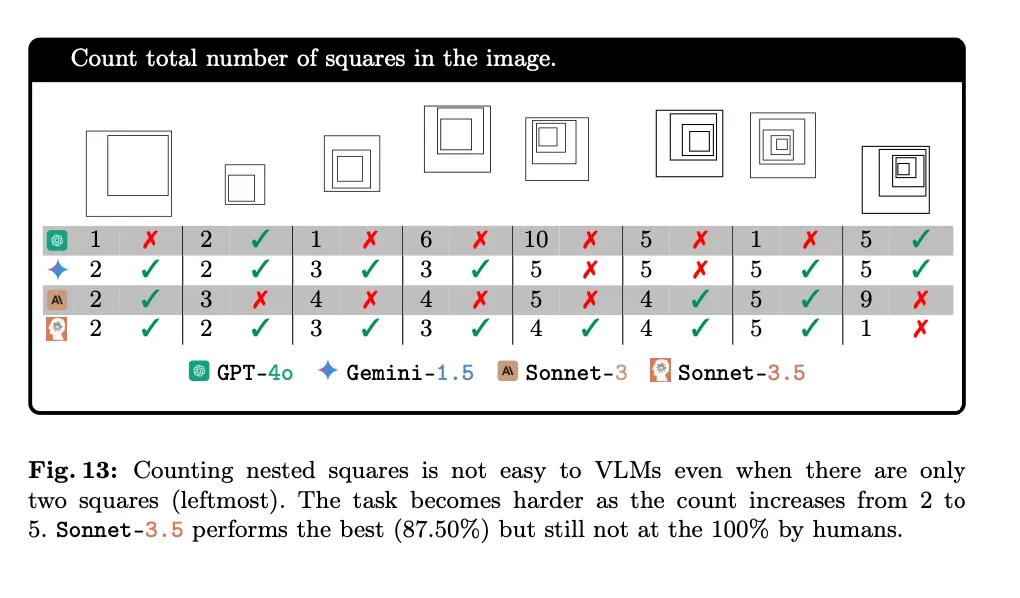

由于 VLMs 計(jì)算相交圓圈的數(shù)量時表現(xiàn)不佳,論文作者進(jìn)一步測試了當(dāng)圖案的邊緣不相交,每個形狀完全嵌套在另一個形狀內(nèi)部的情況。他們用 2-5 正方形生成了「套娃」式的圖案,并讓 VLMs 計(jì)算圖像中的正方形總數(shù)。

從下表中鮮紅的叉號不難看出,這兩關(guān)對于 VLMs 來說,也是難以逾越的障礙。

在嵌套正方形的測試中,各個模型的準(zhǔn)確率差異很大:GPT-4o(準(zhǔn)確率 48.33%)和 Sonnet-3(準(zhǔn)確率 55.00%)這兩種模型至少比 Gemini-1.5(準(zhǔn)確率 80.00%)和 Sonnet-3.5(準(zhǔn)確率 87.50%)低 30 個百分點(diǎn)。

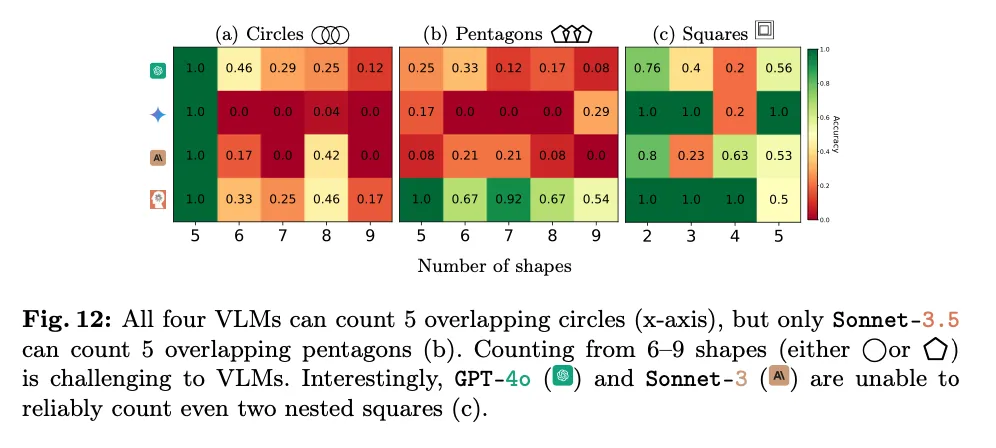

這種差距在模型計(jì)數(shù)重疊的圓形和五邊形時則會更大,不過 Sonnet-3.5 的表現(xiàn)要比其他模型好上幾倍。如下表所示,當(dāng)圖像為五邊形時,Sonnet-3.5 以 75.83% 的準(zhǔn)確率遠(yuǎn)超 Gemini-1.5 的 9.16%。

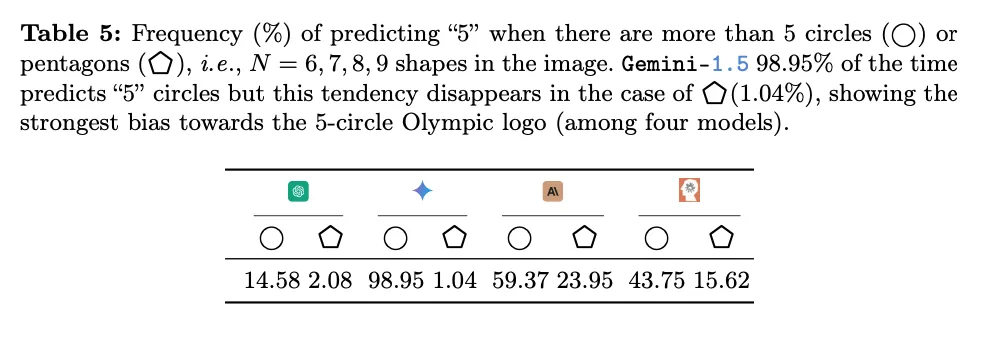

令人驚訝的是,被測的四個模型在數(shù) 5 個圓環(huán)時都達(dá)到了 100% 的準(zhǔn)確率,但僅僅額外添加一個圓環(huán)就足以使準(zhǔn)確率大幅下降到接近零的水平。

然而,在計(jì)算五邊形時,所有 VLM(除 Sonnet-3.5 外)即使在計(jì)算 5 個五邊形時也表現(xiàn)不佳。總體來看,計(jì)算 6 到 9 個形狀(包括圓和五邊形)對所有模型來說都是困難的。

這表明,VLM 存在偏見,它們更傾向于輸出著名的「奧運(yùn)五環(huán)」作為結(jié)果。例如,無論實(shí)際圓的數(shù)量是多少,Gemini-1.5 都會在 98.95% 的試驗(yàn)里將結(jié)果預(yù)測為「5」(見表 5)。對于其他模型,這種圓環(huán)預(yù)測錯誤出現(xiàn)的頻率也遠(yuǎn)高于五邊形的情況。

除了數(shù)量外,VLM 在形狀的顏色上也有不同的「偏好」。

GPT-4o 在彩色形狀上的表現(xiàn)優(yōu)于純黑的形狀,而 Sonnet-3.5 隨著圖像尺寸的增加預(yù)測的表現(xiàn)越來越好。然而,當(dāng)研究人員改變顏色和圖像分辨率時,其他模型的準(zhǔn)確率僅略有變化。

值得注意的是,在計(jì)算嵌套正方形的任務(wù)中,即使正方形的數(shù)量只有 2-3 個,GPT-4o 和 Sonnet-3 依然很難計(jì)算。當(dāng)正方形的數(shù)量增加到四個和五個時,所有模型都遠(yuǎn)未達(dá)到 100% 的準(zhǔn)確率。這表明,即使形狀的邊緣不相交,VLM 也很難準(zhǔn)確地提取目標(biāo)形狀。

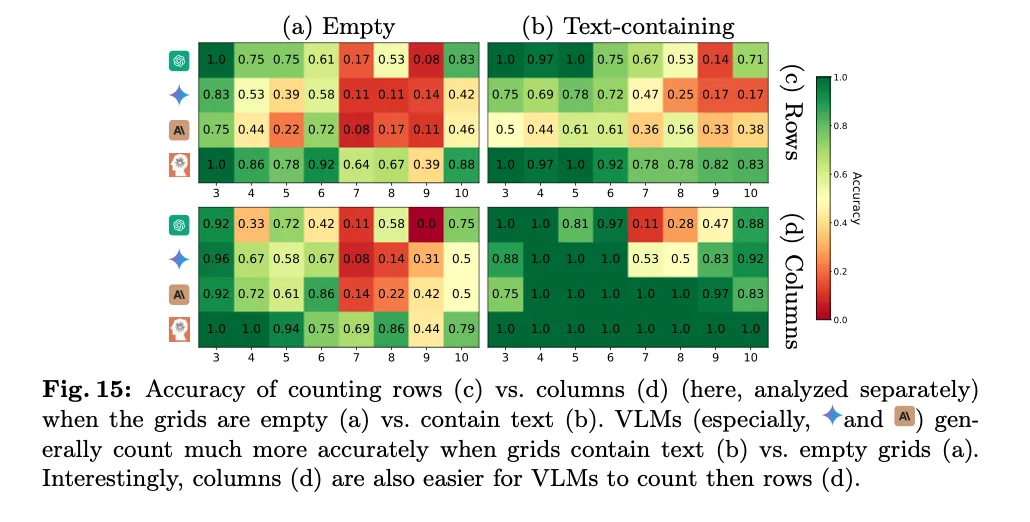

第六關(guān):數(shù)一數(shù)表格有幾行?有幾列?

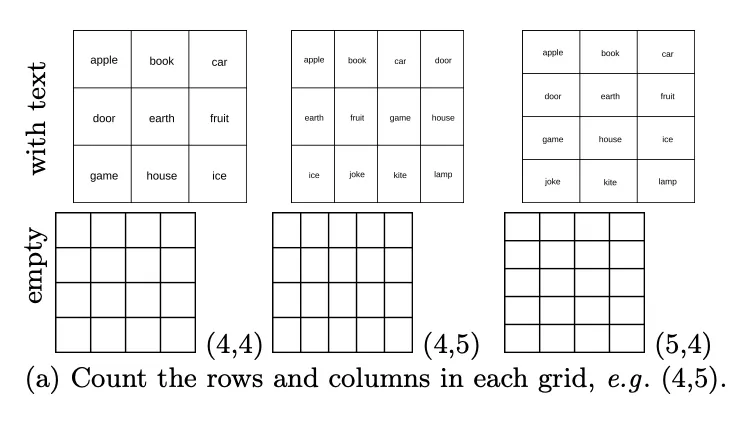

雖然 VLMs 在重疊或嵌套圖形時遇到了困難,但它們眼中的平鋪圖案又是怎樣的呢?在基礎(chǔ)測試集中,特別是包含許多含有表格任務(wù)的 DocVQA,被測模型的準(zhǔn)確率都≥90%。論文作者隨機(jī)生成了 444 個行數(shù)列數(shù)各異的表格,讓 VLMs 數(shù)一數(shù)表格有幾行?有幾列?

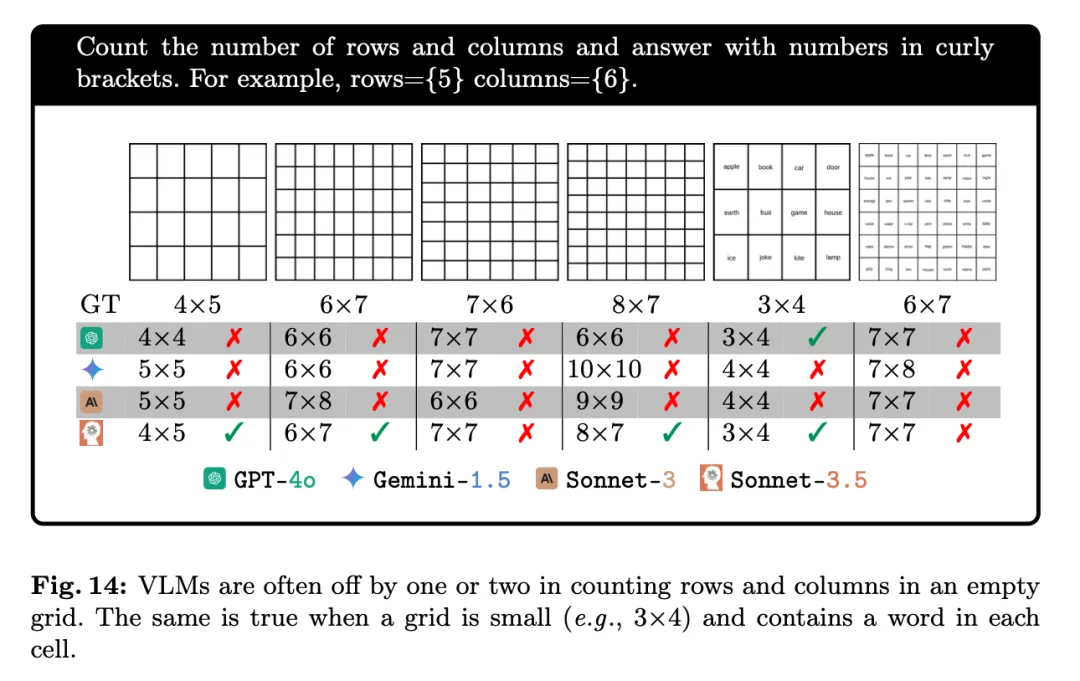

結(jié)果顯示,雖然在基礎(chǔ)數(shù)據(jù)集中拿到了高分,但如下圖所示,VLM 在計(jì)數(shù)空表格中的行和列也表現(xiàn)不佳。

具體來說,它們通常會存在 1-2 格的偏差。如下圖所示,GPT-4o 把 4×5 的網(wǎng)格認(rèn)成了 4×4,Gemini-1.5 則認(rèn)成了 5×5。

這表明,雖然 VLMs 可以從表格中提取重要內(nèi)容以回答 DocVQA 中的表格相關(guān)問題,但無法清晰地逐格識別表格。

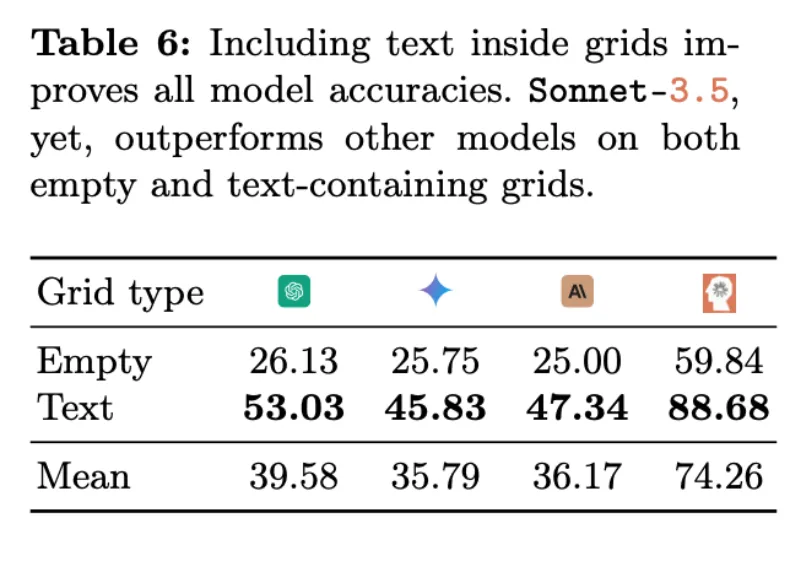

這可能是因?yàn)槲臋n中的表格大多是非空的,而 VLM 不習(xí)慣空表格。有趣的是,在研究人員通過嘗試在每個單元格中添加一個單詞來簡化任務(wù)后,觀察到所有 VLM 的準(zhǔn)確率顯著提高,例如,GPT-4o 從 26.13% 提高到了 53.03%(見表 6)。然而,這種情況中,被測模型的表現(xiàn)依舊不完美。如圖 15a 和 b 所示,表現(xiàn)最好的模型(Sonnet-3.5)在包含文本的網(wǎng)格中表現(xiàn)為 88.68%,而在空網(wǎng)格中表現(xiàn)為 59.84%。

而大多數(shù)模型(Gemini-1.5、Sonnet-3 和 Sonnet-3.5)在計(jì)算列數(shù)方面的表現(xiàn)始終優(yōu)于計(jì)算行數(shù)(見圖 15c 和 d)。

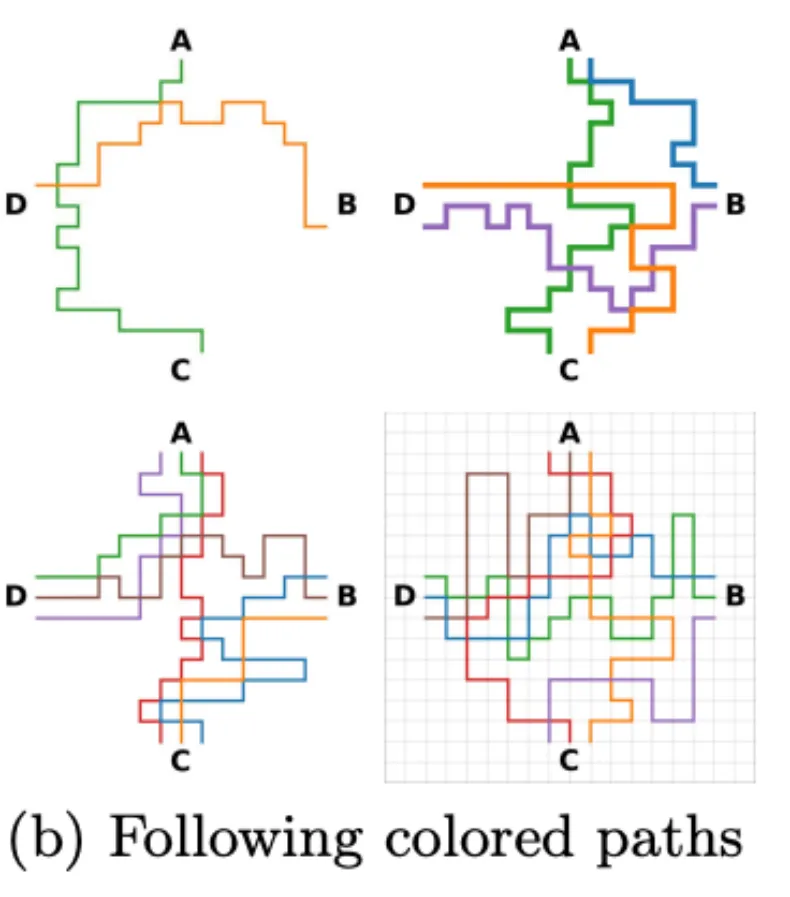

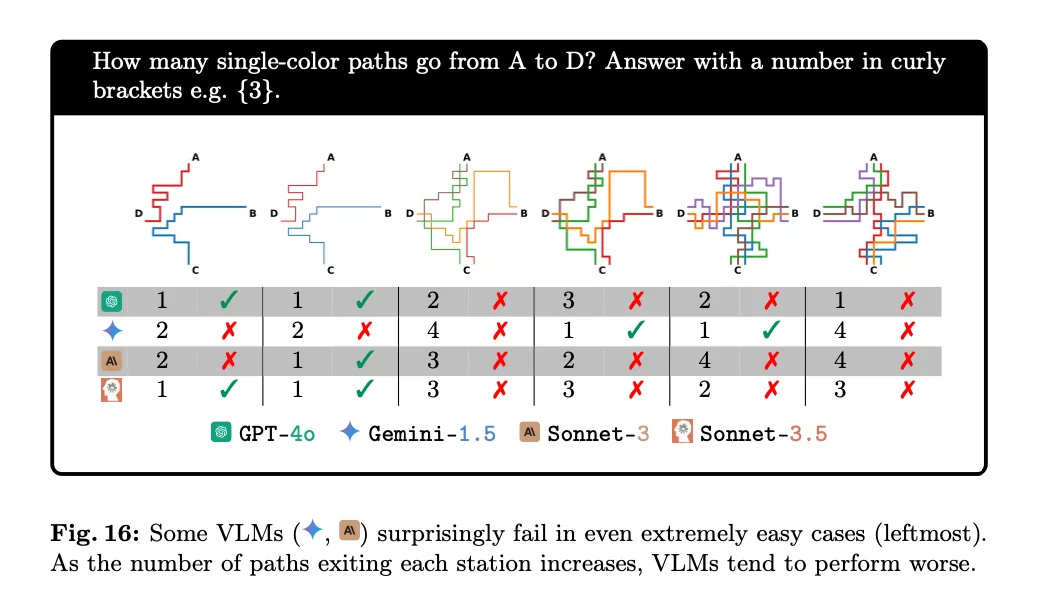

第七關(guān):從出發(fā)點(diǎn)到目的地,有幾條地鐵直達(dá)線路?

這項(xiàng)測試檢測的是 VLMs 跟隨路徑的能力,這對于模型解讀地圖、圖表以及能否理解用戶在輸入的圖片中添加的箭頭等標(biāo)注至關(guān)重要。為此,論文作者隨機(jī)生成了 180 幅地鐵線路圖,每張圖有四個固定的站點(diǎn)。他們要求 VLMs 計(jì)算兩個站點(diǎn)之間有多少條單色的路徑。

測試結(jié)果令人震驚,即使把兩個站點(diǎn)之間的路徑簡化到只有一條,所有模型也無法達(dá)到 100% 的準(zhǔn)確率。如表 7 所示,表現(xiàn)最好的模型是 Sonnet-3.5,準(zhǔn)確率為 95%;最差的模型是 Sonnet-3,準(zhǔn)確率為 23.75%。

從下圖中不難看出,VLM 的預(yù)測通常會有 1 到 3 條路徑的偏差。隨著地圖復(fù)雜度從 1 條路徑增加到 3 條路徑,大多數(shù) VLM 的表現(xiàn)都變得更差。

面對當(dāng)今主流 VLM 在圖像識別上表現(xiàn)極差這一「無情事實(shí)」,眾多網(wǎng)友先是拋開了自己「AI 辯護(hù)律師」的身份,留下了很多較為悲觀的評論。

一位網(wǎng)友表示:「SOTA 模型們(GPT-4o,Gemini-1.5 Pro,Sonnet-3,Sonnet-3.5)表現(xiàn)得如此糟糕真是令人尷尬,而這些模型居然在宣傳時還聲稱:它們可以理解圖像?例如它們可以用于幫助盲人或輔導(dǎo)兒童幾何學(xué)!

在悲觀陣營的另一方,一位網(wǎng)友認(rèn)為這些糟糕的結(jié)果可以通過訓(xùn)練和微調(diào)輕松解決。只需生成大約 100,000 個示例,并用真實(shí)數(shù)據(jù)進(jìn)行訓(xùn)練,這樣問題就解決了。

不過,無論是「AI 辯護(hù)者」還是「AI 悲觀者」都默認(rèn)了一個事實(shí):VLM 在圖像測試中,仍然存在極難調(diào)和的事實(shí)性缺陷。

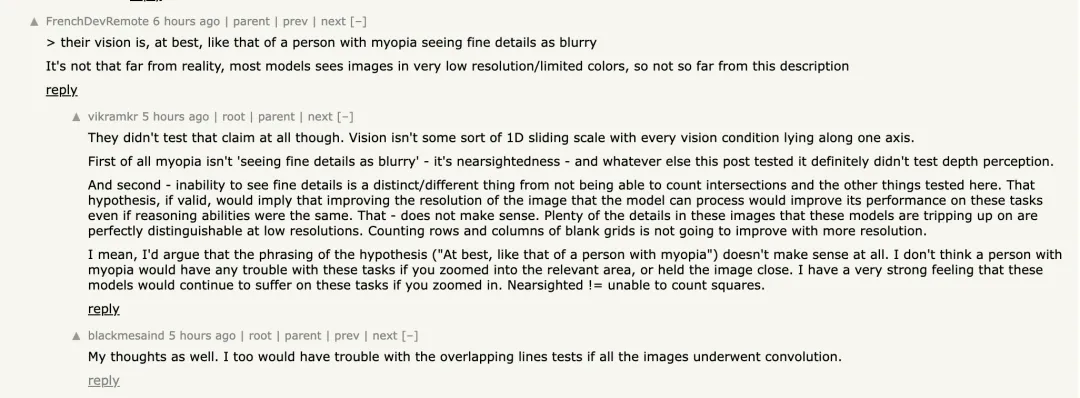

論文作者也收到了對更多這個測試是否科學(xué)的質(zhì)疑。

有網(wǎng)友認(rèn)為,這篇論文的測試并不能說明 VLMs「近視」。首先近視的人看細(xì)節(jié)并不模糊,「看細(xì)節(jié)模糊」是遠(yuǎn)視的癥狀。其次,看不見細(xì)節(jié)與不能計(jì)算交點(diǎn)的數(shù)量是兩回事。計(jì)算空白網(wǎng)格的行和列的數(shù)量的準(zhǔn)確率,不會因?yàn)榉直媛实奶岣叨岣撸岣邎D像的分辨率對于理解這個任務(wù)并沒有幫助。此外,提高圖像分辨率對于理解這個任務(wù)中的重疊線條或交叉點(diǎn)并不會產(chǎn)生顯著影響。

實(shí)際上,這些視覺語言模型(VLMs)在處理這類任務(wù)時所面臨的挑戰(zhàn),可能更多地與它們的推理能力和對圖像內(nèi)容的解釋方式有關(guān),而不僅僅是視覺分辨率的問題。換句話說,即使圖像的每個細(xì)節(jié)都清晰可見,如果模型缺乏正確的推理邏輯或?qū)σ曈X信息的深入理解,它們?nèi)匀豢赡軣o法準(zhǔn)確地完成這些任務(wù)。因此,這項(xiàng)研究可能需要更深入地探討 VLMs 在視覺理解和推理方面的能力,而不僅僅是它們的圖像處理能力。

還有網(wǎng)友認(rèn)為,如果人類的視覺經(jīng)過卷積處理,那么人類自身也會在判斷線條交點(diǎn)的測試中遇到困難。

更多信息,請參考原論文。