萬能3D高斯預訓練表示!GaussianPretrain:爆拉3D檢測、Occ、高精地圖等四大任務!

寫在前面 && 筆者理解

受Tesla的技術的推動,越來越多的廠商開始走"純視覺"的路線,多數方案還是集中在從多視圖輸入圖像中提取鳥瞰圖(BEV)特征,來解決下游目標檢測、在線地圖等各種應用。盡管有監督的方法還是占主導地位,但是它們非常依賴精確的GT標注,成本高、難度大往往成為一個比較顯著的瓶頸。相反,大量且易于獲取的未標記數據為提高性能提供了一個充滿希望的途徑。這就是所謂的自監督預訓練技術,其核心思想是,通過利用精心設計的代理任務,從豐富的未標記數據中學習有意義的表示。然而當前的一些方案要么無法捕捉到有效的幾何信息,要么無不能學習到詳細的紋理信息。

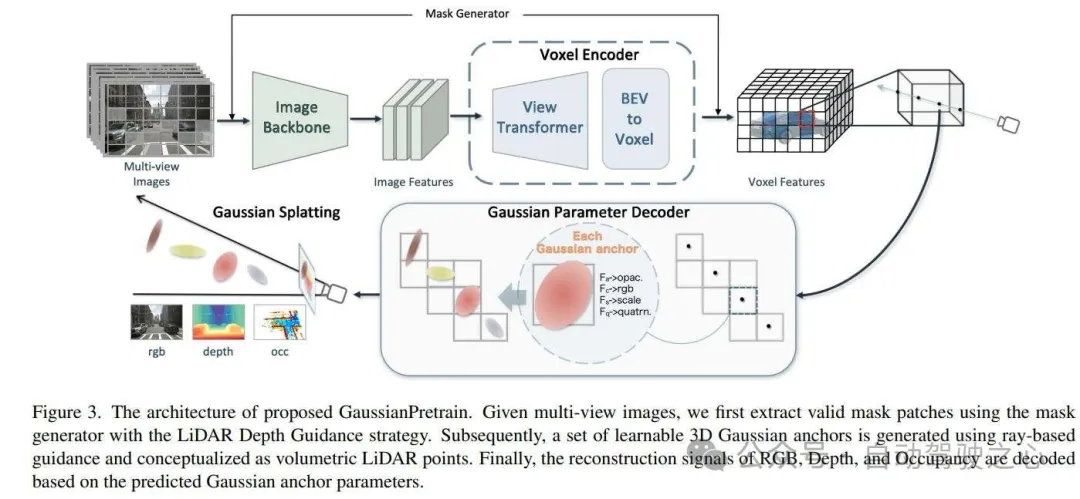

3D Gaussian Splatting(3D-GS)以點云的形式表示,為場景重建提供了強大的表示,通過位置、顏色、旋轉、縮放和不透明度等屬性編碼幾何和紋理信息。正是受到3D-GS在有效場景表示和Masked autoencoders(MAE)在2D圖像自監督學習中的成功的啟發,作者提出了一種新穎的預訓練方法GaussianPretrain,它結合了3D-GS和MAE方法,用于3D視覺學習中的預訓練任務。

作者的方法包括兩個關鍵創新:

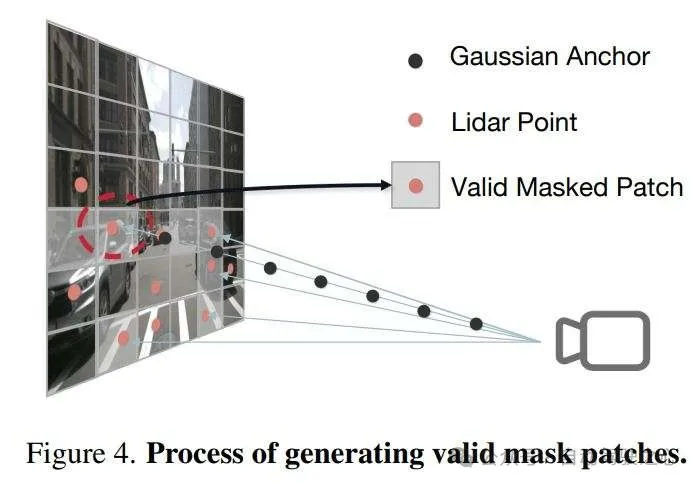

- LiDAR深度指導掩碼生成器。為了提高效率,作者只關注從多視圖圖像中的有限數量的有效掩碼補丁中學習高斯信息。這些補丁由MAE策略識別,并進一步過濾,只包括那些具有LiDAR深度監督的補丁。

- 基于射線的3D高斯錨點指導策略:對于每個LiDAR投影像素,執行射線投射操作到3D空間以采樣體素內的點。作者引入了一組可學習的高斯錨點來指導從3D體素中作為體積LiDAR點的高斯屬性的學習,并預測相關屬性(例如,深度、不透明度)。這使得模型能夠通過3D Gaussian Splatting同時理解場景的幾何和紋理信息。

- 論文鏈接:https://arxiv.org/pdf/2411.12452

相關工作

自動駕駛中的預訓練

使用對比學習和掩碼信號建模來捕獲語義和紋理信息,在2D圖像上的預訓練已經取得了巨大的成功。但是,自動駕駛的視覺預訓練需要準確的幾何表示。目前有的研究,比如,UniScene和OccNet利用占用預測進行預訓練,而ViDAR 從歷史幀圖像預測未來的LiDAR數據。盡管這些方法在捕獲幾何信息方面是有效的,但卻無法學習詳細的紋理信息。相反,像Self-OCC 、UniPAD 和MIM4D 這樣的方法使用NeRF 來渲染RGB圖像和深度圖,學習了紋理但幾何信息有限。OccFeat 在占用預測期間使用知識蒸餾從圖像基礎模型轉移紋理信息,但會產生高昂的預訓練成本。相比之下,作者的工作引入了3D Gaussian Splatting進行自動駕駛的視覺預訓練,有效地捕獲紋理和幾何信息,來解決這些限制。

從NeRF到3D-GS

Neural Radiance Fields (NeRF) 通過隱式表示場景的顏色和密度,參數化多層感知機(MLP)結合體積渲染技術,實現了令人印象深刻的渲染質量。后續工作已成功將NeRF擴展到各種任務,但是這些工作都需要針對每個場景來優化,由于優化和渲染速度慢,限制了它們的效率。相比之下,3D Gaussian Splatting 通過各向異性高斯顯式表示場景,通過可微光柵化實現實時渲染。然而,由于依賴于特定場景的優化,它傾向于過度擬合特定場景。最近的方法通過預測高斯參數的前饋方式來緩解這個問題,這樣就不需要針對每個場景來優化了。例如,GPSGaussian 從圖像對執行極線校正和視差估計,依賴立體圖像和真實的深度圖。同樣,Spatter Image 專注于從單一視圖重建單個對象的3D結構。這兩種方法因為效率低,僅限于對象重建,并且依賴于特定的輸入格式,如圖像對或單一視圖。在本文中,作者將3D Gaussian Splatting擴展到視覺預訓練任務中,通過在3D空間中預設固定位置的3D高斯錨點,克服了與視圖數量和深度圖需求相關的問題,標志著3D-GS的新應用。

3D Gaussian Splatting

3D GS由于其高效的光柵化設計和顯式表示,在場景表示、編輯和新視角合成方面展現出強大的能力。通常,場景由一組高斯組成,這些高斯通常從重建方法或LiDAR數據中得到的點云初始化而來。每個高斯被賦予可學習的屬性,包括方向、顏色、位置、尺度和不透明度。在渲染過程中,這些3D高斯被使用可微光柵化投影到2D圖像平面上。對于場景表示任務,通過將渲染輸出與真實圖像進行監督,迭代優化高斯屬性。對于3D空間中的一個高斯點,它被定義為

LiDAR 深度引導掩模生成器

受MAE 的啟發,作者對多視圖圖像應用隨機補丁掩碼,表示為M。此外,稀疏卷積被用來替代圖像主干中的傳統卷積,如SparK 的實現增強了性能和泛化能力。為了計算效率,作者只關注從有限的一組有效掩碼補丁中學習高斯參數。此外,作者通過檢查LiDAR點是否在某個深度范圍內來雙重檢查掩碼區域。

基于射線引導的 3D 高斯錨點

體素編碼

Gaussian 參數解碼

通過重構信號來監督

為了在MAE策略下更好地重建掩碼區域,作者使用從高斯表示派生的不同重建信號來監督學習過程。具體來說,RGB、深度和占用信號是基于有效掩碼補丁中預測的高斯錨點參數解碼的。

實驗結果

作者使用nuScenes數據集來訓練和驗證。

不同任務上的結果

3D Object Detection. 作者在表1中比較了GaussianPretrain與以前SOTA方法的結果。以UniPAD作為基線,該基線是在UVTR-C/StreamPETR上實現的。作者的方法在NDS和mAP上分別超過了UniPAD-C 0.8和0.7個百分點。與StreamPETR相比,改進進一步獲得了0.9 NDS,達到了48.8和38.6在NDS和mAP上,達到了沒有任何測試時增強的現有最先進方法的水平。

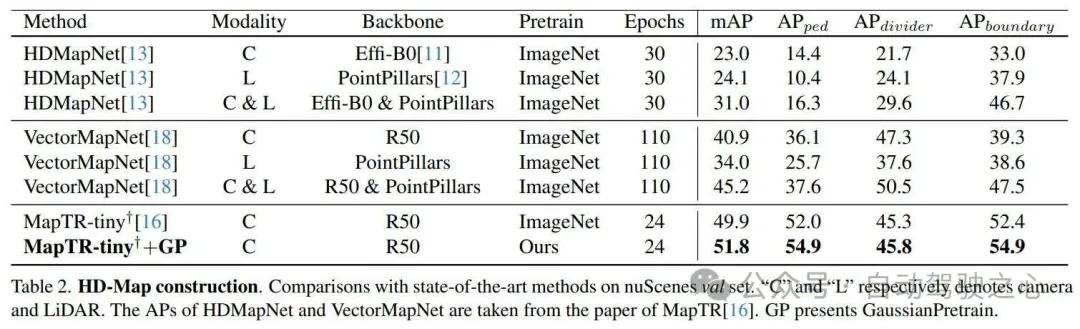

HD Map Construction. 正如表2所示,作者評估了其訓練模型在nuScenes數據集上對HD地圖構建任務的性能。這項任務要求模型理解道路拓撲和交通規則,需要對場景的紋理信息有詳細的了解。作者使用MapTR 來評估GaussianPretrain捕獲這些信息的能力。得益于作者有效的高斯表示預訓練,MapTR在mAP上實現了1.9%的改進。

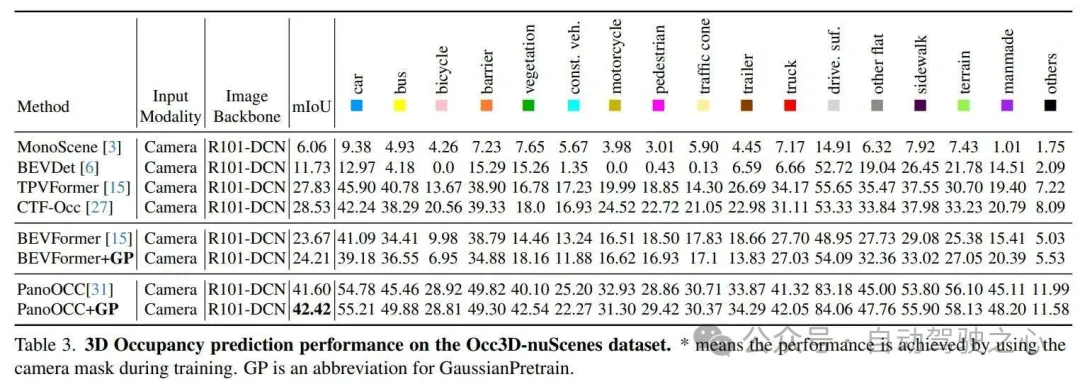

3D Occupancy Prediction. 高斯錨點的不透明度屬性自然適合占用預測任務。在表3中,作者在Occ3D-nuScenes上進行了3D占用預測的實驗。表中報告了SOTA方法的性能,這些性能記錄在Occ3d 的工作中。作者在BEVFormer 和PanoOCC上實現了作者的框架,比BEVFormer提高了0.6% mIoU的性能,比SOTA方法PanoOCC進一步提高了0.8% mIoU。這也突出了作者預訓練圖的有效性。

預訓練方法上的結果

作者以在ImageNet上預訓練的UVTR-C作為基線,并在表4中比較了GaussianPretrain與以前的預訓練方法。

- DD3D:利用深度估計進行預訓練。

- SparK:將MAE納入預訓練方法。

- FCOS3D:在預訓練階段使用3D標簽進行監督。

- UniPAD:基于NeRF的渲染預訓練范式。

作者的GaussianPretrain,將3D-GS整合到視覺預訓練中,大大提高了7.1%的NDS和9.0%的mAP。它優于所有其他方法,分別達到了32.0 NDS和32.3 mAP。

消融實驗

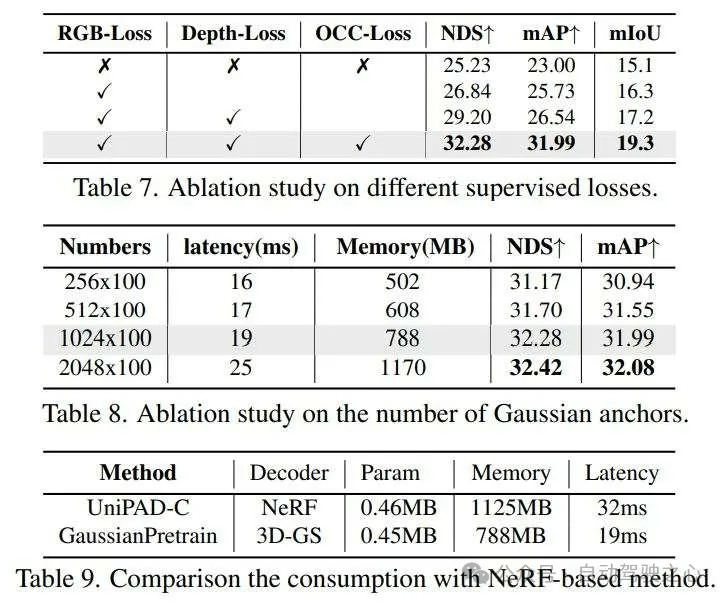

GaussianPretrain’s losses: 為了驗證每個重建信號的有效性,作者在UVTR和BEVFomer上進行了3D檢測和占用任務的實驗。RGB損失引導模型從重建圖像中學習場景的紋理信息,而深度損失鼓勵模型在2D平面上學習幾何信息,盡管這本身不足以捕獲完整的3D幾何信息。相比之下,占用損失監督模型在3D空間內學習全面的幾何信息。如表7所示,每個組成部分都做出了積極貢獻,當全部使用時,取得了最佳結果。

Gaussian Anchor Numbers: 作者進行了消融研究,以檢查不同數量的高斯錨點對性能指標的影響,如表8所示。在達到1024個射線時,觀察到最顯著的增益,超過這個數量,相對于額外的資源需求,改進較小。

Efficiency & consumption: 基于NeRF的方法通常受到慢收斂和高GPU內存消耗的困擾。相比之下,作者的基于3D-GS的方法提供了可比的渲染質量,并且具有更快的收斂速度和更優越的效率,用于自由視圖渲染。在表9中,作者比較了NeRF基礎的UniPAD和作者的解碼器模塊之間的效率和內存消耗。值得注意的是,GaussianPretrain明顯減少了約30%的內存使用,并減少了大約40.6%的延遲,同時保持了相似的參數大小。

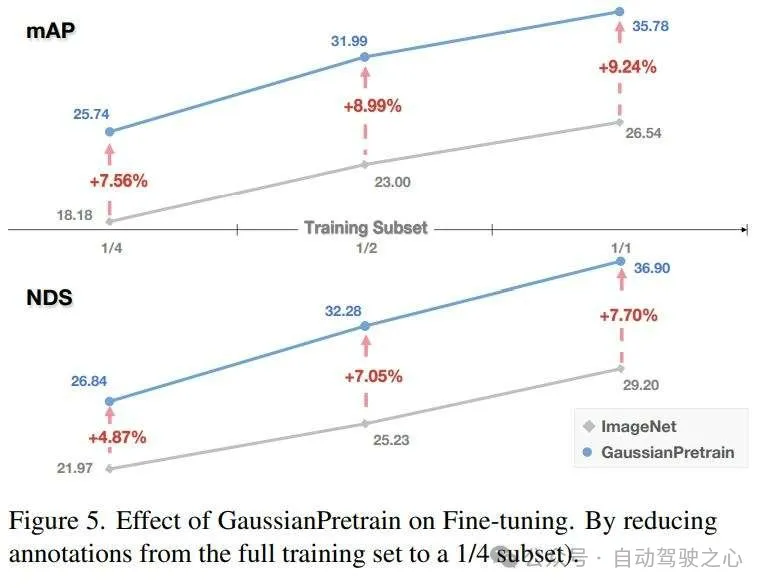

Supervised Pre-training: 作者展示了GaussianPretrain在減少對注釋的依賴方面的有效性,通過微調UVTR,從完整數據集到1/4子集的范圍。如圖5所示,作者的方法在只有一半監督樣本的情況下超過了基線5.5% mAP,即32.0% mAP vs. 26.5% mAP。這表明GaussianPretrain可以有效利用未標記數據來補償減少的監督,即使在注釋較少的情況下也能提高性能。

Different Conditions: 作者在表6中報告了在不同距離、天氣條件和光照情況下的性能,這得益于作者在UVTR-C上有效的預訓練,GaussianPretrain實現了卓越的魯棒性和整體最佳性能。

總結

在這項工作中,作者首次將3D Gaussian Splatting技術引入視覺預訓練任務。作者的GaussianPretrain在各種3D感知任務中展現出顯著的有效性和魯棒性,包括3D目標檢測、高清地圖重建和占用預測,同時具有效率和較低的內存消耗。不過,當前框架仍然存在某些局限性。特別是,它沒有明確地結合時間或多模態信息,這兩者對于許多自動駕駛應用至關重要。在未來的工作中,作者計劃擴展GaussianPretrain以利用這些信息,并進一步提高其性能。