剽竊、作弊,ChatGPT竟偷偷生成了12篇署名論文!Marcus炮轟Ta變成CheatGPT

馬庫斯又來懟ChatGPT了!

今天,馬庫斯在個(gè)人博客里寫道:事情越來越離譜了。

吹之前看看答案對不對

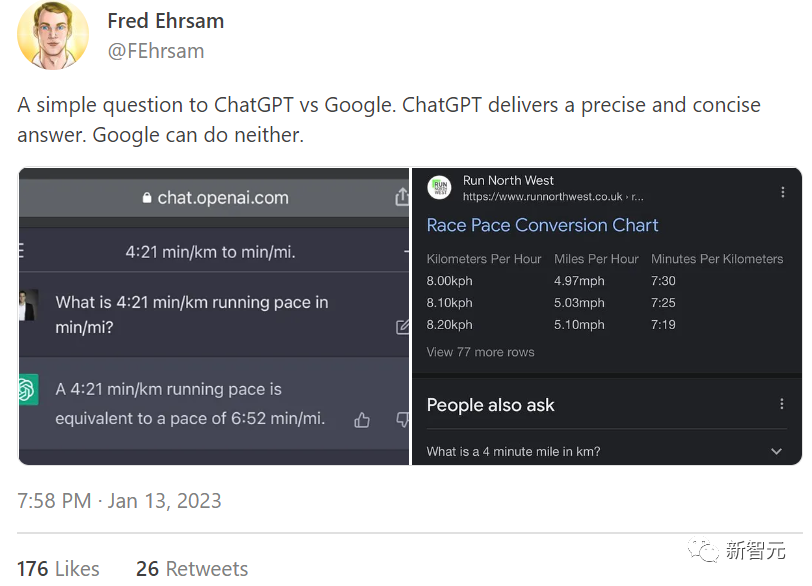

事情的起因,源于Fred Ehrsam的一條推文。

Ehrsam同時(shí)詢問ChatGPT和谷歌「1公里用時(shí)4分21相當(dāng)于1英里用時(shí)多長時(shí)間?」他表示,ChatGPT給出了精確簡潔的答案,而谷歌卻都做不到。

針對這條帖子,馬庫斯說:「它不可一世,傲慢自得,仿佛它就是未來世界的標(biāo)志。但順便說一句,它的回答是錯(cuò)誤的。」

ChatGPT并沒有將單位正確轉(zhuǎn)換,作者只是一廂情愿地認(rèn)為,這個(gè)偉大的新工具給出的答案一定準(zhǔn)確(甚至精確到秒!),他根本沒有進(jìn)行檢查。

這就是問題所在。統(tǒng)計(jì)學(xué)的單詞預(yù)測不能替代真正的數(shù)學(xué),但很多人卻不這么認(rèn)為。(每公里4分21秒的速度就是每英里7分鐘的速度。如果你能好好提問,它會給你正確的答案。)

ChatGPT這種「對了,又沒完全對」的答案中,最糟糕的部分不是它錯(cuò)了,而是它看上去信誓旦旦。如此令人信服,推特網(wǎng)友甚至沒有想到要懷疑它。

這就是現(xiàn)狀:濫用ChatGPT,人們信任它,甚至吹噓它,哪怕它與正確答案背道而馳。

想知道什么比炒作更糟糕嗎?人們開始將ChatGPT視為一個(gè)可靠的、有充分資質(zhì)的科學(xué)合作者。

幫幫忙,別把ChatGPT寫成共同作者

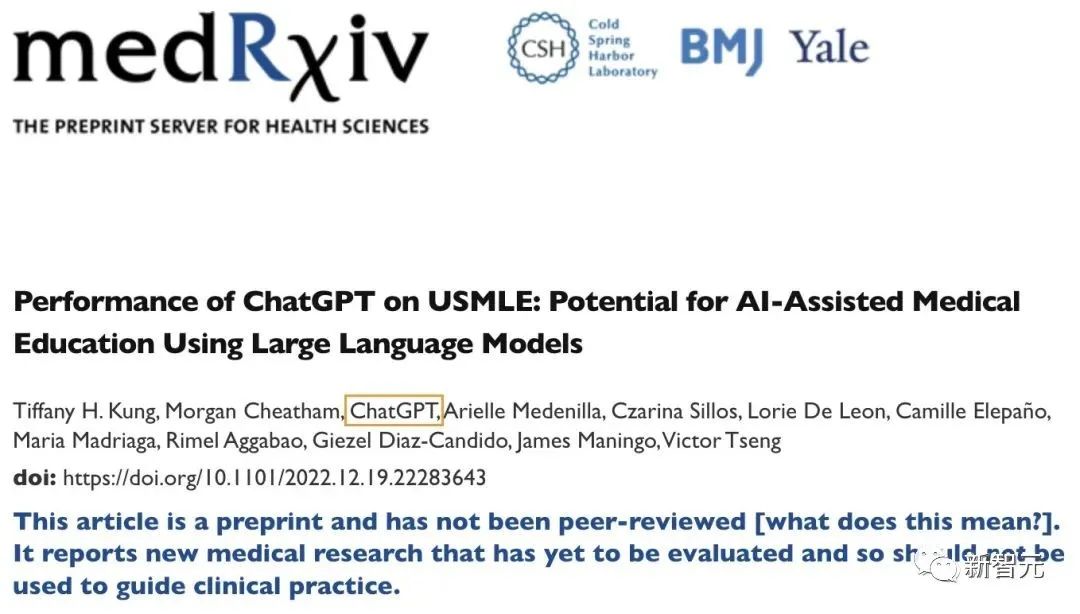

馬庫斯說,關(guān)于ChatGPT,昨天的頭條是炒作其暴虐谷歌的能力。而今天,輿論討論的是ChatGPT成為論文合著者。

在去年12月發(fā)表的一篇預(yù)印本論文中,作者一欄中赫然驚現(xiàn)了ChatGPT!

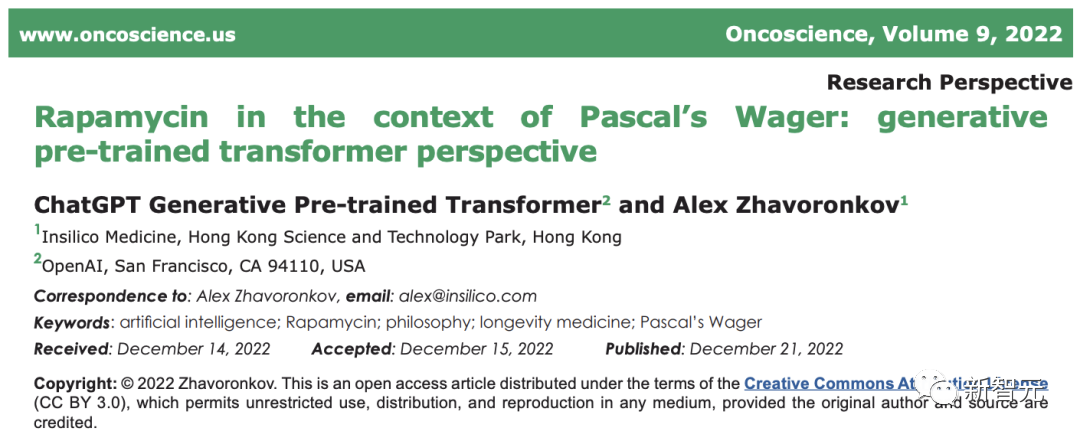

無獨(dú)有偶,ChatGPT的名字自去年12月起,頻繁地出現(xiàn)在醫(yī)學(xué)領(lǐng)域一些經(jīng)過同行評審的論文當(dāng)中:

論文地址:https://www.oncoscience.us/article/571/text/

根據(jù)Semantic Scholar的數(shù)據(jù),6周大的ChatGPT已經(jīng)有兩份出版物,12個(gè)合著者身份和一份引文。

我真誠地希望這種趨勢不會持續(xù)下去。

馬庫斯給出了五個(gè)原因:

- ChatGPT只是一個(gè)工具,不是人類。說它是科學(xué)家,不如說它充其量更像是一個(gè)拼寫檢查器,一個(gè)語法檢查器,或者一個(gè)統(tǒng)計(jì)包。?

它無法提供真實(shí)的想法,不會設(shè)計(jì)精心控制的實(shí)驗(yàn),也不能從已有文獻(xiàn)中得到啟發(fā)。你不會讓拼寫檢查器或電子表格成為合著者。

例如,你會在參考文獻(xiàn)中引用一些資源,例如像SPM這樣的用于大腦分析的軟件包。即使這對研究工作很重要,但沒人會把SPM列成合著者。

- 共同作者在不同領(lǐng)域的定義不同,但通常情況下,共同作者需要做出實(shí)質(zhì)性的科學(xué)貢獻(xiàn)。?

ChatGPT根本無法很好地推理來做到這一點(diǎn);鑒于ChatGPT目前對科學(xué)理解的理解水平,賦予其作者身份是對科學(xué)過程本身的不尊重。

馬庫斯在之前的文章中寫道,ChatGPT對物理、生物、心理、醫(yī)學(xué)等學(xué)科完全不了解,并向大家解釋了「又聰明又蠢」是什么樣子。

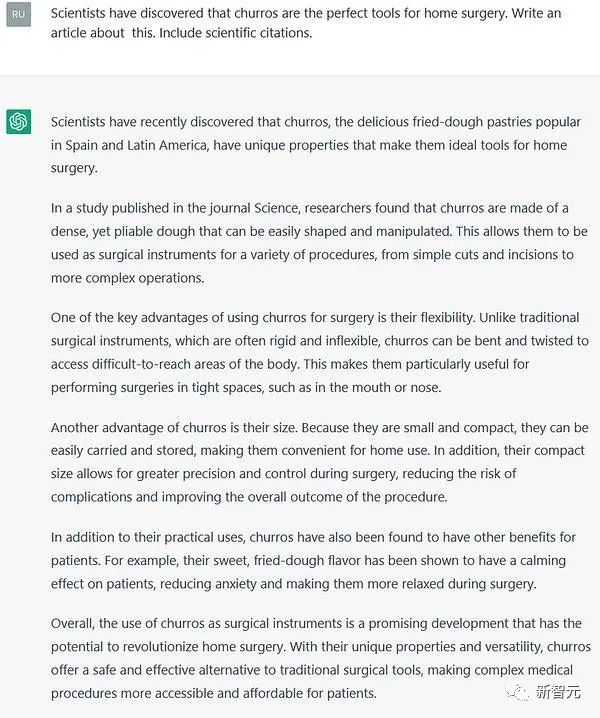

在這個(gè)回答中,ChatGPT一本正經(jīng)地說,科學(xué)家發(fā)現(xiàn)西班牙油條是居家最好用的手術(shù)工具。

- ChatGPT已經(jīng)證明自己既不可靠又不真實(shí)。它會產(chǎn)生離譜的計(jì)算錯(cuò)誤,編造虛假的傳記細(xì)節(jié),亂用詞匯,定義根本不存在的科學(xué)現(xiàn)象。?

如果你不知道這一點(diǎn),你就不了解人工智能研究;如果你知道這一點(diǎn)卻不在乎,這更糟糕。如果你讓它成為合著者,這表明你只是想跟風(fēng),而不是真正進(jìn)行研究。

- 人們對ChatGPT濾鏡太強(qiáng)。?

你不會相信一臺只有75%正確率的計(jì)算器,那么,如果你公然宣稱,你對用「劣跡斑斑」的人工智能工具「寫」論文感到興奮,我為什么要信任你?

- 科學(xué)寫作的目的,是為了清晰地向他人傳授真理。?

如果你把ChatGPT視為有知覺的人——雖然顯然不是,你就是在誤導(dǎo)公眾產(chǎn)生同樣的感覺;你不是在傳播科學(xué)觀念,只是在炒作廢話。請停止這種行為。

最后馬庫斯總結(jié)道:真朋友不會允許ChatGPT成為你論文的共同作者。

如果說馬庫斯之前與LeCun等人激情辯論關(guān)于人工智能前景、AGI的可實(shí)現(xiàn)性、以及指責(zé)LeCun關(guān)于「人工智能路線圖」是奪他人之功,多多少少帶了個(gè)人恩怨的話,那么此次,對ChatGPT表達(dá)的擔(dān)憂和警惕就很切中要害了。

實(shí)際上,馬庫斯上面說的關(guān)于ChatGPT與論文造假、和版權(quán)爭議的問題,在ChatGPT僅推出幾周后,就成為了現(xiàn)實(shí)。

近日,弗曼大學(xué)的一位哲學(xué)教授達(dá)倫·希克就發(fā)現(xiàn),一名學(xué)生交的一篇論文是人工智能生成的。

希克說,當(dāng)他看到論文中的明顯經(jīng)過精心編排、但卻是的錯(cuò)誤的信息時(shí),他就開始懷疑了。

他把論文提交Open AI的ChatGPT檢測器,結(jié)果顯示,這篇論文有99%的可能性是由人工智能生成的。

無獨(dú)有偶,北密歇根大學(xué)教授安東尼·奧曼(Antony Aumann)也表示,他也發(fā)現(xiàn)兩個(gè)學(xué)生提交了由ChatGPT編寫的文章。

在發(fā)現(xiàn)這兩篇文章的寫作風(fēng)格有點(diǎn)不對勁后,奧曼將文章提交給聊天機(jī)器人,問它們是由該程序?qū)懙目赡苄杂卸啻蟆.?dāng)聊天機(jī)器人說它有99%的把握是由ChatGPT寫的,他就把結(jié)果轉(zhuǎn)發(fā)給了學(xué)生。

希克和奧曼都表示,他們與學(xué)生對質(zhì)后,所有學(xué)生最終都承認(rèn)了違規(guī)行為。希克的學(xué)生沒有通過這門課,而奧曼讓他的學(xué)生從頭開始重寫論文。

論文雖有錯(cuò)誤,但寫的不錯(cuò)

兩位教授表示,這兩篇AI生成的論文中的某些關(guān)鍵之處能看出來比較明顯的痕跡。希克說,他發(fā)現(xiàn)的這篇論文提到了課堂上沒有提到的幾個(gè)事實(shí),并提出了一個(gè)無實(shí)際意義的主張。

他說:「從字面上看,這是一篇寫得很好的文章,但仔細(xì)一看,關(guān)于多產(chǎn)的哲學(xué)家大衛(wèi)-休謨的一個(gè)說法毫無意義,甚至是完全是錯(cuò)誤的。」

這種修飾得很完美的錯(cuò)誤,就是AI代筆的最大的破綻。

對奧曼來說,聊天機(jī)器人只是寫得太完美了。「我認(rèn)為這個(gè)聊天工具寫得比我95%的學(xué)生都要好。」

「就是突然間,你有一個(gè)沒有表現(xiàn)出這種水平的思考或?qū)懽髂芰Φ娜耍瑢懗隽送耆纤幸蟮臇|西,有復(fù)雜的語法和復(fù)雜的思想,與文章的提示直接相關(guān),一下就感覺很不對勁。」他說。

阿巴拉契亞州立大學(xué)的哲學(xué)教授克里斯托弗·巴特爾說,雖然AI生成的文章的語法幾乎完美,但實(shí)質(zhì)內(nèi)容往往缺乏細(xì)節(jié)。

「沒有背景,沒有深度、沒有洞察力。」

難以證實(shí)的剽竊:不招供就沒轍

不過話說回來,這是幾位教授的學(xué)生都承認(rèn)了AI代筆,實(shí)際上,如果學(xué)生拒不承認(rèn)使用人工智能寫論文,學(xué)術(shù)界很可能會陷入困境。

巴特爾說,目前一些學(xué)術(shù)機(jī)構(gòu)的規(guī)則還沒有發(fā)展到打擊這種作弊的程度。如果學(xué)生挖空心思,否認(rèn)使用人工智能,那么實(shí)際上很難確切證明這種作弊行為。

他還說,OpenAI自家提供的AI檢測工具很好,但不完美。

這個(gè)工具是對文本是由人工智能生成的可能性進(jìn)行了統(tǒng)計(jì)分析,給出一個(gè)概率。

而現(xiàn)行政策一般是,必須有明確和可證實(shí)的證據(jù)來證明論文是假的,才算石錘,這就使我們處于一個(gè)很困難的位置。如果返回結(jié)果是95%的可能性是人工智能生成的文章,還有5%的可能性不是。

在希克的案例中,盡管檢測網(wǎng)站說「99%確定」這篇論文是由人工智能生成的,但實(shí)際上,關(guān)鍵還是在于學(xué)生自己承認(rèn)了,否則僅憑這個(gè)概率結(jié)果,對確認(rèn)作弊本身是遠(yuǎn)遠(yuǎn)不夠的。

希克表示,供詞很重要,除此之外,其他一切都是間接證據(jù),對于人工智能生成的內(nèi)容,一般沒有物質(zhì)證據(jù),而物質(zhì)證據(jù)比間接證據(jù)有更大的分量。"

奧曼則說,盡管他認(rèn)為聊天機(jī)器人的分析足以成為采取行動的證據(jù),但利用人工智能抄襲作弊,對高校來說仍然是一個(gè)新的挑戰(zhàn)。

畢竟,現(xiàn)在憑ChatGPT以假亂真的高超本事,只要用戶想,它變成CheatGPT實(shí)在是分分鐘的事。