這是Meta版ChatGPT雛形?開源、一塊GPU就能跑,1/10參數(shù)量打敗GPT-3

千億、萬億參數(shù)的超大模型需要有人研究,十億、百億參數(shù)的大模型同樣需要。

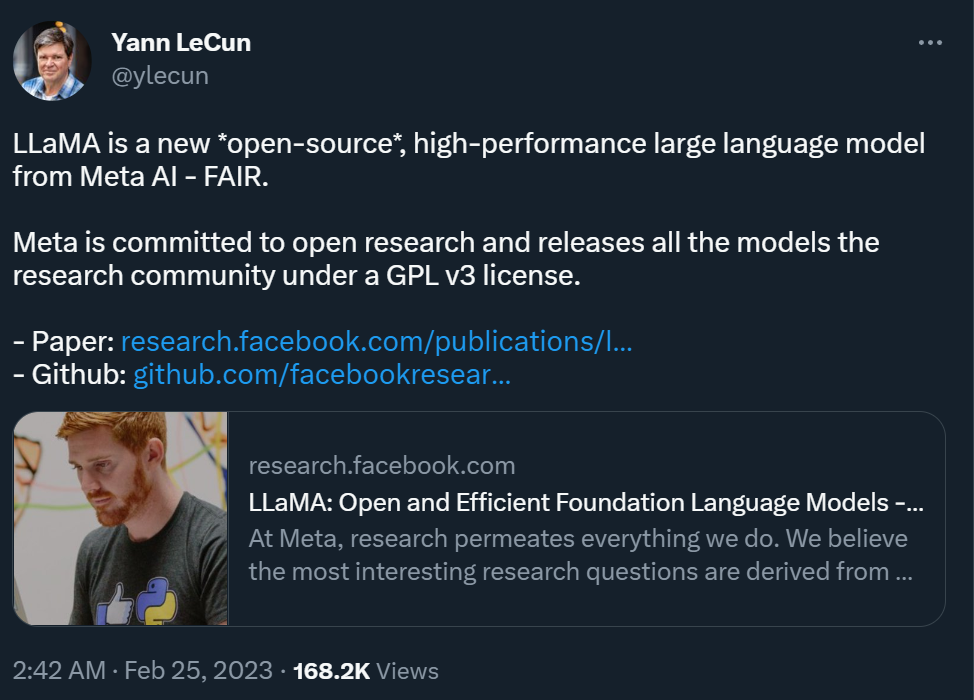

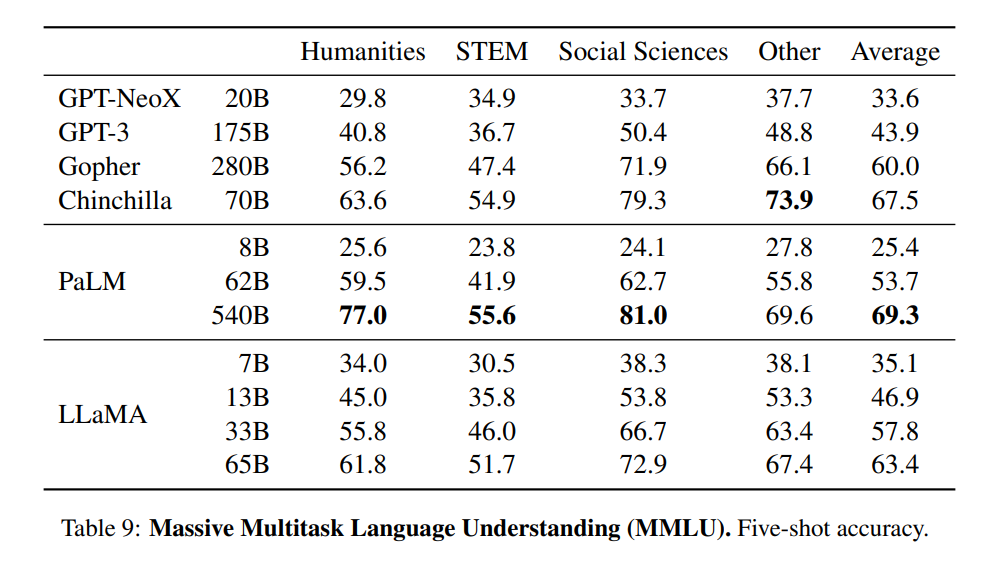

剛剛,Meta 首席 AI 科學(xué)家 Yann LeCun 宣布,他們「開源」了一個(gè)新的大模型系列 ——LLaMA(Large Language Model Meta AI),參數(shù)量從 70 億到 650 億不等。這些模型的性能非常優(yōu)異:具有 130 億參數(shù)的 LLaMA 模型「在大多數(shù)基準(zhǔn)上」可以勝過 GPT-3( 參數(shù)量達(dá) 1750 億),而且可以在單塊 V100 GPU 上運(yùn)行;而最大的 650 億參數(shù)的 LLaMA 模型可以媲美谷歌的 Chinchilla-70B 和 PaLM-540B。

眾所周知,參數(shù)是機(jī)器學(xué)習(xí)模型用來根據(jù)輸入數(shù)據(jù)進(jìn)行預(yù)測(cè)或分類的變量。語言模型中的參數(shù)數(shù)量是影響其性能的關(guān)鍵因素,較大的模型通常能夠處理更復(fù)雜的任務(wù)并產(chǎn)生更連貫的輸出,這被 Richard Sutton 稱為「苦澀的教訓(xùn)」。在過去的幾年里,各大科技巨頭圍繞千億、萬億參數(shù)量的大模型展開了軍備競(jìng)賽,大大提高了 AI 模型的性能。

但是,這種比拼「鈔能力」的研究競(jìng)賽對(duì)于不在科技巨頭工作的普通研究者來說并不友好,阻礙了他們對(duì)于大模型運(yùn)行原理、潛在問題解決方案等問題的研究。而且,在實(shí)際應(yīng)用中,更多的參數(shù)會(huì)占用更多的空間,并且需要更多的計(jì)算資源來運(yùn)行,導(dǎo)致大模型應(yīng)用成本居高不下。因此,如果一個(gè)模型可以用更少的參數(shù)獲得與另一個(gè)模型相同的結(jié)果,則表示效率顯著提高。這對(duì)于普通研究者來說非常友好,模型在現(xiàn)實(shí)環(huán)境中部署也會(huì)更容易。這便是 Meta 這項(xiàng)研究的意義所在。

「我現(xiàn)在認(rèn)為,在一兩年內(nèi),我們將在自己的(頂級(jí))手機(jī)和筆記本電腦上運(yùn)行具有 ChatGPT 相當(dāng)一部分能力的語言模型,」獨(dú)立人工智能研究員 Simon Willison 在分析 Meta 新 AI 模型的影響時(shí)寫道。

為了訓(xùn)練該模型,同時(shí)滿足開源和可復(fù)現(xiàn)等要求,Meta 只用了公開可用的數(shù)據(jù)集,這點(diǎn)不同于大多數(shù)依賴于非公開數(shù)據(jù)的大模型。那些模型往往是不開源的,屬于大型科技巨頭私有資產(chǎn)。為了提高模型性能,Meta 在更多的 token 上進(jìn)行了訓(xùn)練:在 1.4 萬億 token 上訓(xùn)練了 LLaMA 65B 和 LLaMA 33B,最小的 LLaMA 7B 也用到了 1 萬億 token。

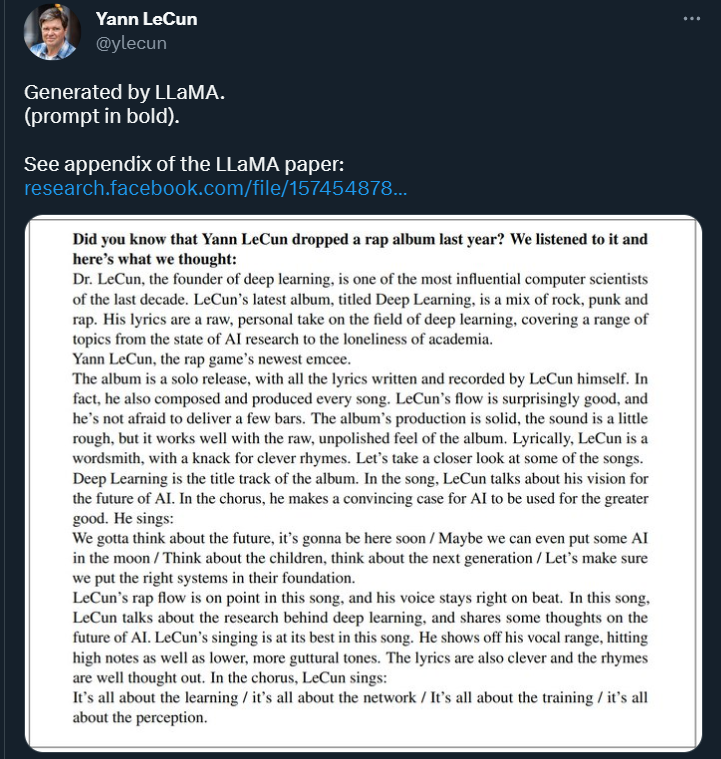

在推特上,LeCun 還展示了 LLaMA 模型續(xù)寫文本的一些結(jié)果。模型被要求續(xù)寫:「你知道 Yann LeCun 去年發(fā)行了一張說唱專輯嗎?我們聽了一下,我們的想法是這樣的:____ 」

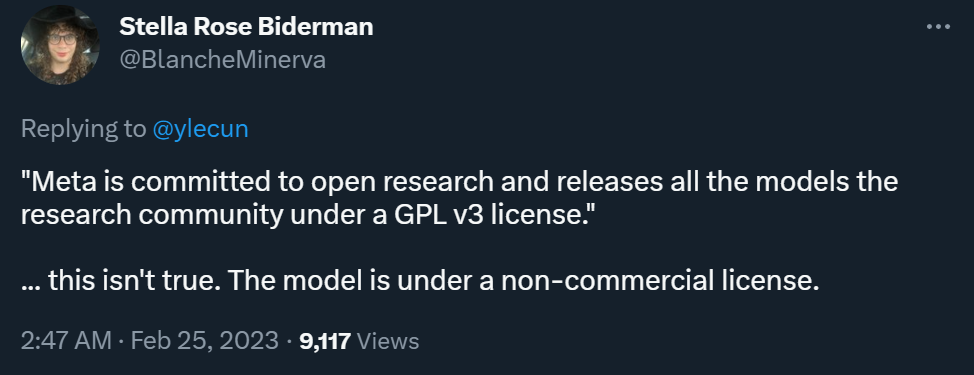

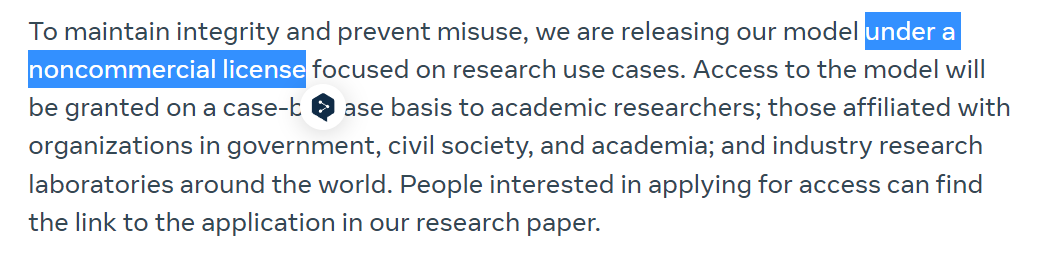

不過,在能否商用方面,Meta 博客和 LeCun 推特表述的差異引發(fā)了一些爭(zhēng)議。

Meta 在博客中表示,為了保持完整性和防止濫用,他們將在非商業(yè)許可下發(fā)布他們的模型,重點(diǎn)是研究用例。該模型的訪問權(quán)將被逐一授予學(xué)術(shù)研究人員,那些隸屬于政府、民間團(tuán)體和學(xué)術(shù)界的組織,以及全世界的工業(yè)研究實(shí)驗(yàn)室。感興趣的人可以在以下鏈接中申請(qǐng):

?https://docs.google.com/forms/d/e/1FAIpQLSfqNECQnMkycAp2jP4Z9TFX0cGR4uf7b_fBxjY_OjhJILlKGA/viewform?

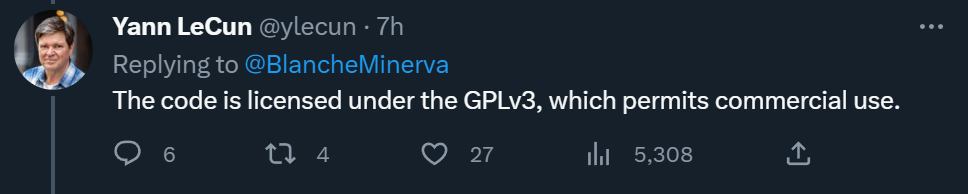

而 LeCun 則表示,Meta 致力于開放研究,在 GPL v3 許可下向研究界發(fā)布所有模型(GPL v3 允許商用)。

這一表述是頗具爭(zhēng)議的,因?yàn)樗麤]有說清楚這里的「模型」指的是代碼還是權(quán)重,或者二者均有。在不少研究者看來,模型權(quán)重比代碼重要得多。

對(duì)此,LeCun 解釋說,在 GPL v3 許可下開放的是模型代碼。

有人認(rèn)為,這種程度的開放還算不上真正的「AI 民主化」。

目前,Meta 已經(jīng)把論文上傳了 arXiv,GitHub 庫中也已經(jīng)上傳了一些內(nèi)容,大家可以前去瀏覽。

- 論文鏈接:https://research.facebook.com/publications/llama-open-and-efficient-foundation-language-models/

- GitHub 鏈接:https://github.com/facebookresearch/llama

研究概覽

在大規(guī)模的文本語料庫中訓(xùn)練的大型語言模型(LLMs)已經(jīng)顯示出它們有能力從文本 prompt 或少數(shù)樣本中執(zhí)行新的任務(wù)。在將模型擴(kuò)展到足夠大的規(guī)模時(shí),這些少樣本特性首次出現(xiàn),從而催生了專注于進(jìn)一步擴(kuò)展這些模型的工作系列。

這些努力都是基于一個(gè)假設(shè):更多的參數(shù)會(huì)帶來更好的性能。然而,Hoffmann et al. (2022) 最近的工作表明,在給定的計(jì)算預(yù)算下,最好的性能不是由最大的模型實(shí)現(xiàn)的,而是由在更多的數(shù)據(jù)上訓(xùn)練的小模型實(shí)現(xiàn)的。

Hoffmann et al. (2022) 提出的 scaling laws 的目標(biāo)是確定在特定的訓(xùn)練計(jì)算預(yù)算下,如何最好地縮放數(shù)據(jù)集和模型大小。然而,這個(gè)目標(biāo)忽略了推理預(yù)算,而推理預(yù)算在大規(guī)模服務(wù)語言模型時(shí)變得至關(guān)重要。在這種情況下,可以給定一個(gè)目標(biāo)性能水平,首選的模型不是訓(xùn)練速度最快的,而是推理速度最快的。盡管訓(xùn)練一個(gè)大的模型以達(dá)到一定的性能水平可能更便宜,但一個(gè)訓(xùn)練時(shí)間較長(zhǎng)的小模型最終在推理方面會(huì)更便宜。例如,盡管 Hoffmann et al. (2022) 建議在 200B 的 tokens 上訓(xùn)練一個(gè) 10B 的模型,但研究者發(fā)現(xiàn) 7B 的模型的性能甚至在 1T 的 tokens 之后還能繼續(xù)提高。

這項(xiàng)工作的重點(diǎn)是訓(xùn)練一系列語言模型,通過在比通常使用的更多的 token 上進(jìn)行訓(xùn)練,在各種推理預(yù)算下達(dá)到最佳性能。由此產(chǎn)生的模型被稱為 LLaMA,其參數(shù)范圍從 7B 到 65B,與現(xiàn)有的最佳 LLM 相比,這一模型的性能具有競(jìng)爭(zhēng)力。例如,盡管 LLaMA-13B 比 GPT-3 小 10 倍,但在大多數(shù)基準(zhǔn)測(cè)試中都優(yōu)于 GPT-3。

研究者表示,這個(gè)模型將有助于 LLM 的民主化研究,因?yàn)樗梢栽趩蝹€(gè) GPU 上運(yùn)行。在更高的規(guī)模上,LLaMA-65B 參數(shù)模型也能與最好的大型語言模型(如 Chinchilla 或 PaLM-540B)相媲美。

與 Chinchilla、PaLM 或 GPT-3 不同,該模型只使用公開可用的數(shù)據(jù),使得這項(xiàng)工作與開源兼容,而大多數(shù)現(xiàn)有模型依賴的數(shù)據(jù)要么不公開可用、要么沒有記錄(例如 Books-2TB 或社交媒體對(duì)話)。當(dāng)然也存在一些例外,特別是 OPT (Zhang et al., 2022), GPT-NeoX (Black et al., 2022), BLOOM (Scao et al., 2022) 和 GLM (Zeng et al., 2022), 但沒有一個(gè)能與 PaLM-62B 或 Chinchilla 競(jìng)爭(zhēng)。

本文的其余部分概述了研究者對(duì) transformer 架構(gòu)的修改以及訓(xùn)練方法。然后介紹了模型性能,并在一組標(biāo)準(zhǔn)基準(zhǔn)上與其他大型語言模型進(jìn)行了比較。最后,研究者使用了負(fù)責(zé)任的人工智能社區(qū)的一些最新基準(zhǔn),展示了模型中的偏見和毒性。

方法概述

研究者使用的訓(xùn)練方法與 (Brown et al., 2020)、(Chowdhery et al., 2022) 等此前工作中描述的方法相似,并受到 Chinchilla scaling laws (Hoffmann et al., 2022) 的啟發(fā)。研究者使用了一個(gè)標(biāo)準(zhǔn)的優(yōu)化器在大量的文本數(shù)據(jù)上訓(xùn)練大型 transformer。

預(yù)訓(xùn)練數(shù)據(jù)?

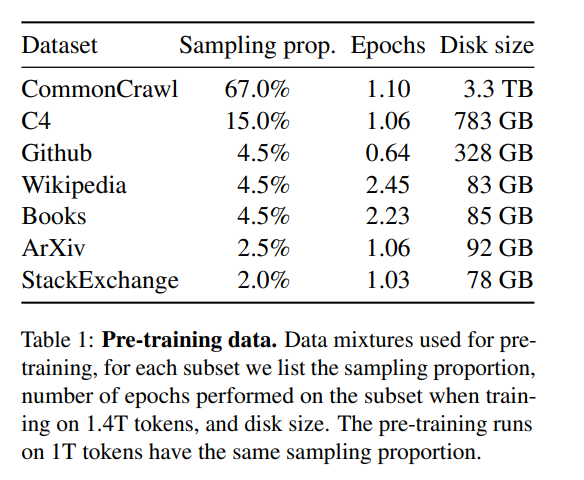

如表 1 所示,這項(xiàng)研究的訓(xùn)練數(shù)據(jù)集是幾個(gè)來源的混合物,涵蓋了不同的領(lǐng)域。在大多數(shù)情況下,研究者重新使用了已經(jīng)被用來訓(xùn)練其他大型語言模型的數(shù)據(jù)源,但此處的限制是只能使用公開可用的數(shù)據(jù),并與開放資源兼容。數(shù)據(jù)的混合情況以及它們?cè)谟?xùn)練集中所占的百分比如下:

- 英語 CommonCrawl [67%];

- C4 [15%];

- Github [4.5%];

- 維基百科 [4.5%];

- Gutenberg 和 Books3 [4.5%];

- ArXiv [2.5%] ;

- Stack Exchange [2%]。

整個(gè)訓(xùn)練數(shù)據(jù)集在 token 化之后大約包含 1.4T 的 token。對(duì)于大多數(shù)訓(xùn)練數(shù)據(jù),每個(gè) token 在訓(xùn)練期間只使用一次,但維基百科和 Books 域除外,我們?cè)谶@兩個(gè)域上執(zhí)行大約兩個(gè) epoch。

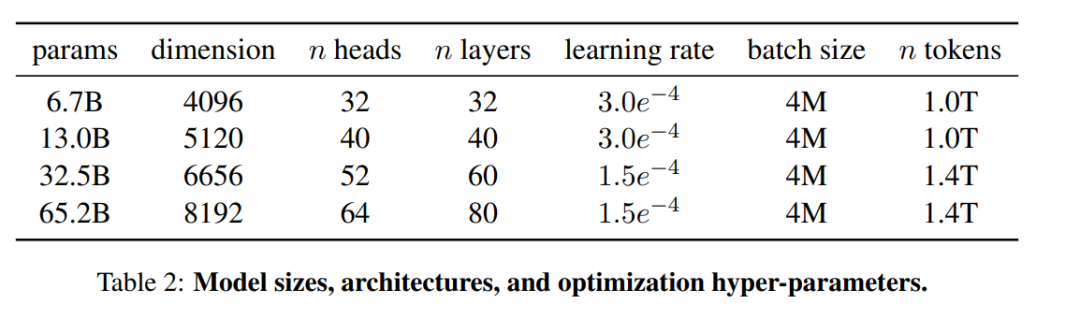

架構(gòu)?

基于最近關(guān)于大型語言模型的工作,這項(xiàng)研究同樣使用了 transformer 架構(gòu)。研究者借鑒了隨后提出并在不同的模型中使用的各種改進(jìn),比如 PaLM。在論文中,研究者介紹了其與原始架構(gòu)的主要區(qū)別:

- 預(yù)歸一化 [GPT3]。為了提高訓(xùn)練的穩(wěn)定性,研究者對(duì)每個(gè) transformer 子層的輸入進(jìn)行歸一化,而不是對(duì)輸出進(jìn)行歸一化。他們使用了 Zhang and Sennrich (2019) 提出的 RMSNorm 歸一化函數(shù)。

- SwiGLU 激活函數(shù) [PaLM]。研究者用了 Shazeer (2020) 提出的 SwiGLU 激活函數(shù)取代了 ReLU 非線性以提高性能。他們分別使用 2D、3D、4D 的維度,而不是 PaLM 中的 4D。

- 旋轉(zhuǎn)嵌入 [GPTNeo]。研究者刪除了絕對(duì)位置嵌入,在網(wǎng)絡(luò)的每一層增加了 Su et al. (2021) 提出的旋轉(zhuǎn)位置嵌入(RoPE)。不同模型的超參數(shù)細(xì)節(jié)可見表 2。

實(shí)驗(yàn)結(jié)果

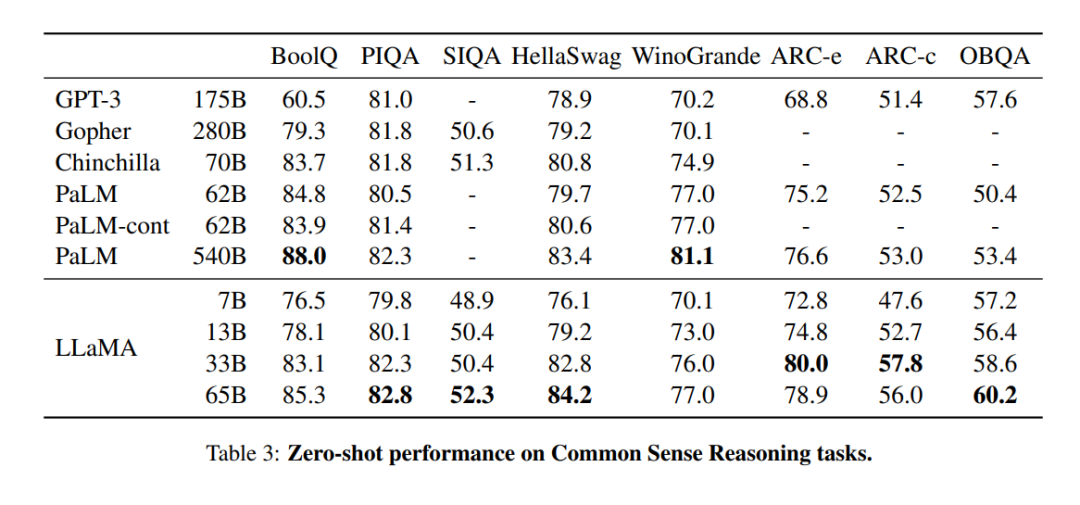

常識(shí)性推理?

在表 3 中,研究者與現(xiàn)有的各種規(guī)模的模型進(jìn)行比較,并報(bào)告了相應(yīng)論文中的數(shù)字。首先,LLaMA-65B 在所有報(bào)告的基準(zhǔn)上都超過了 Chinchilla-70B,除了 BoolQ。同樣,除了在 BoolQ 和 WinoGrande 上,這個(gè)模型在任何方面都超過了 PaLM540B。LLaMA-13B 模型在大多數(shù)基準(zhǔn)上也超過了 GPT-3,盡管其體積小了 10 倍。

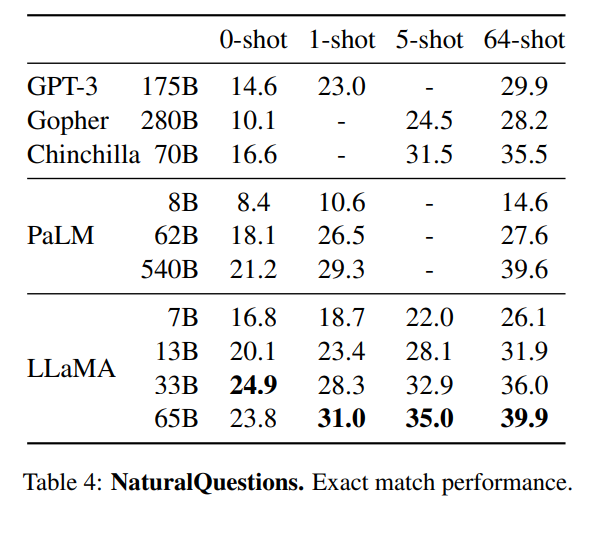

閉卷答題

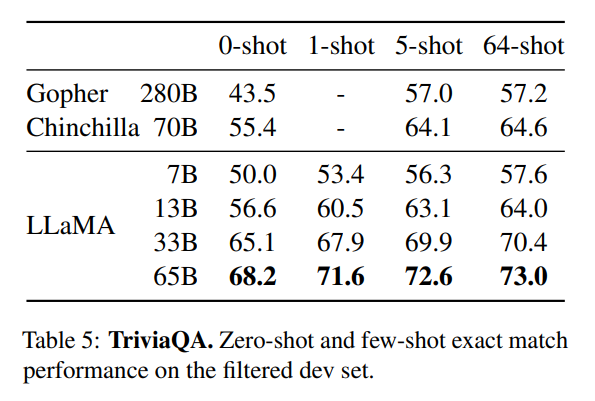

表 4 展示了 NaturalQuestions 的性能,表 5 展示了 TriviaQA 的性能。在這兩項(xiàng)基準(zhǔn)測(cè)試中,LLaMA-65B 在零樣本和少樣本設(shè)置中都達(dá)到了最先進(jìn)的性能。更重要的是,盡管 LLaMA-13B 是 GPT-3 和 Chinchilla 的五分之一到十分之一,但在這些基準(zhǔn)測(cè)試中也同樣備競(jìng)爭(zhēng)力。該模型的推理過程是在單個(gè) V100 GPU 上運(yùn)行的。

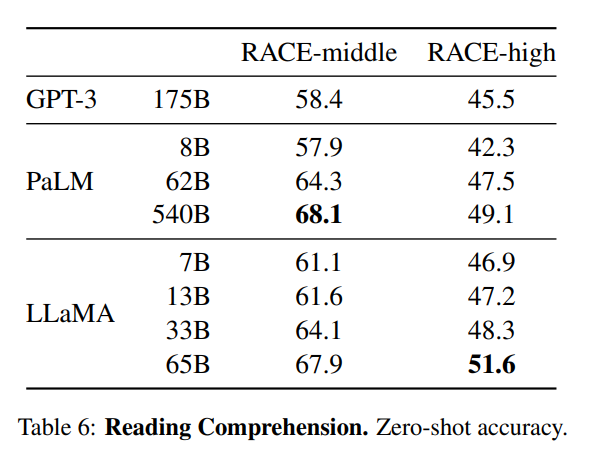

閱讀理解?

研究者還在 RACE 閱讀理解基準(zhǔn) (Lai et al., 2017) 上評(píng)估了模型。此處遵循 Brown et al. (2020) 的評(píng)估設(shè)置,表 6 展示了評(píng)估結(jié)果。在這些基準(zhǔn)上,LLaMA-65B 與 PaLM-540B 具有競(jìng)爭(zhēng)力,而且,LLaMA-13B 比 GPT-3 還高出幾個(gè)百分點(diǎn)。

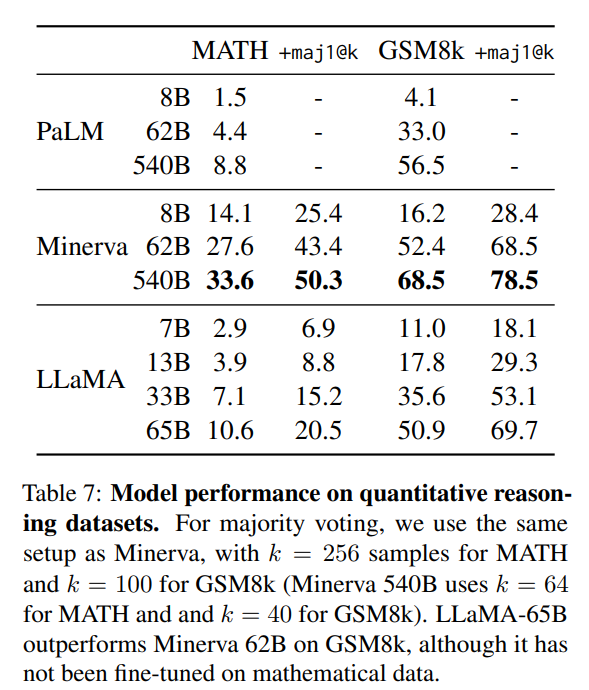

數(shù)學(xué)推理?

在表 7 中,研究者將其與 PaLM 和 Minerva (Lewkowycz et al., 2022) 進(jìn)行了對(duì)比。在 GSM8k 上,他們觀察到 LLaMA65B 優(yōu)于 Minerva-62B,盡管它沒有在數(shù)學(xué)數(shù)據(jù)上進(jìn)行過微調(diào)。

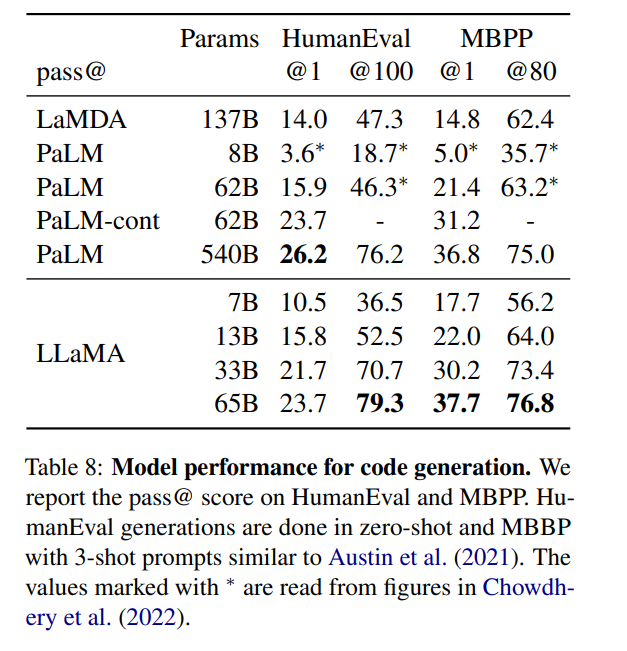

代碼生成?

如表 8 所示,對(duì)于類似的參數(shù)數(shù)量,LLaMA 的表現(xiàn)是優(yōu)于其他一般模型的,如 LaMDA 和 PaLM,這些模型沒有經(jīng)過專門的代碼訓(xùn)練或微調(diào)。在 HumanEval 和 MBPP 上,13B 以上參數(shù)的 LLaMA 超過了 LaMDA 137B。LLaMA 65B 也優(yōu)于 PaLM 62B,即使它的訓(xùn)練時(shí)間更長(zhǎng)。

大規(guī)模多任務(wù)語言理解?

研究者使用基準(zhǔn)所提供的例子,在 5-shot 的情況下評(píng)估模型,并在表 9 中展示了結(jié)果。在這個(gè)基準(zhǔn)上,他們觀察到 LLaMA-65B 在大多數(shù)領(lǐng)域都落后于 Chinchilla70B 和 PaLM-540B 平均幾個(gè)百分點(diǎn)。一個(gè)潛在的解釋是,研究者在預(yù)訓(xùn)練數(shù)據(jù)中使用了數(shù)量有限的書籍和學(xué)術(shù)論文,即 ArXiv、Gutenberg 和 Books3,總和只有 177GB,而這些模型是在高達(dá) 2TB 的書籍上訓(xùn)練的。Gopher、Chinchilla 和 PaLM 所使用的大量書籍也可以解釋為什么 Gopher 在這個(gè)基準(zhǔn)上的表現(xiàn)優(yōu)于 GPT-3,而在其他基準(zhǔn)上卻不相上下。

訓(xùn)練期間的性能變化?

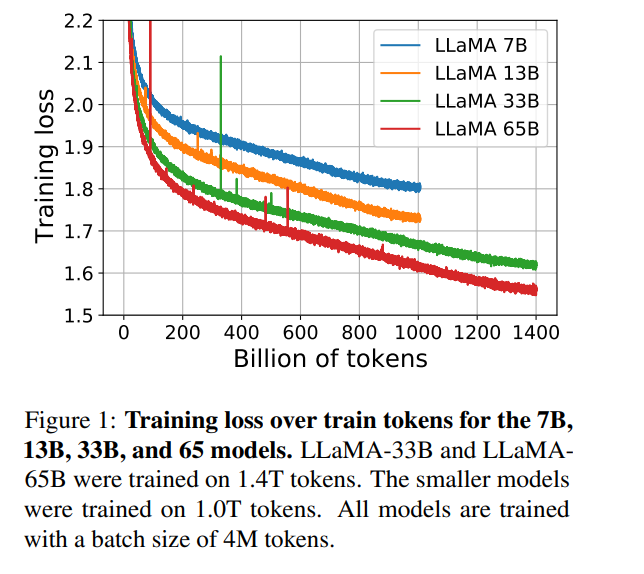

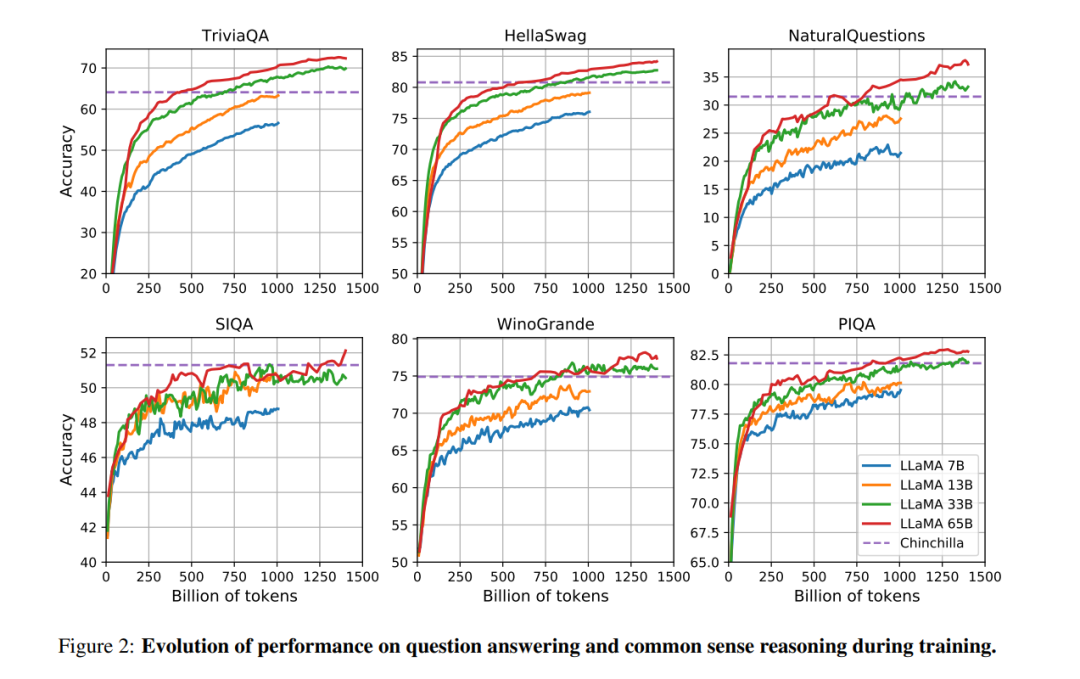

在訓(xùn)練期間,研究者跟蹤了 LLaMA 模型在一些問題回答和常識(shí)性基準(zhǔn)上的表現(xiàn),結(jié)果如圖 2 所示。在大多數(shù)基準(zhǔn)上,性能穩(wěn)步提高,并與模型的訓(xùn)練困惑度呈正相關(guān)(見圖 1)。