菲爾茲獎得主親測GPT-4o,經典過河難題破解失敗!最強Claude 3.5回答離譜,LeCun嘲諷LLM

在經典的「狼-山羊-卷心菜」過河問題上,如今所有的LLM都失敗了!

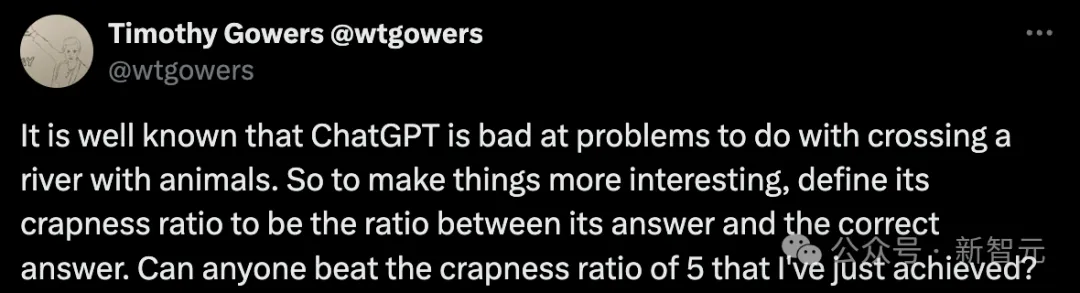

幾天前,菲爾茲獎得主、劍橋大學研究主任Timothy Gowers直接拿GPT-4o開刀,去解決動物過河難題。

在此,他給出了一個新的基準——廢話比率(crapness ratio),即LLM給出的總答案與正確答案之間的比率。

經過測試,Gowers發現大模型的廢話比率可以達到5倍。

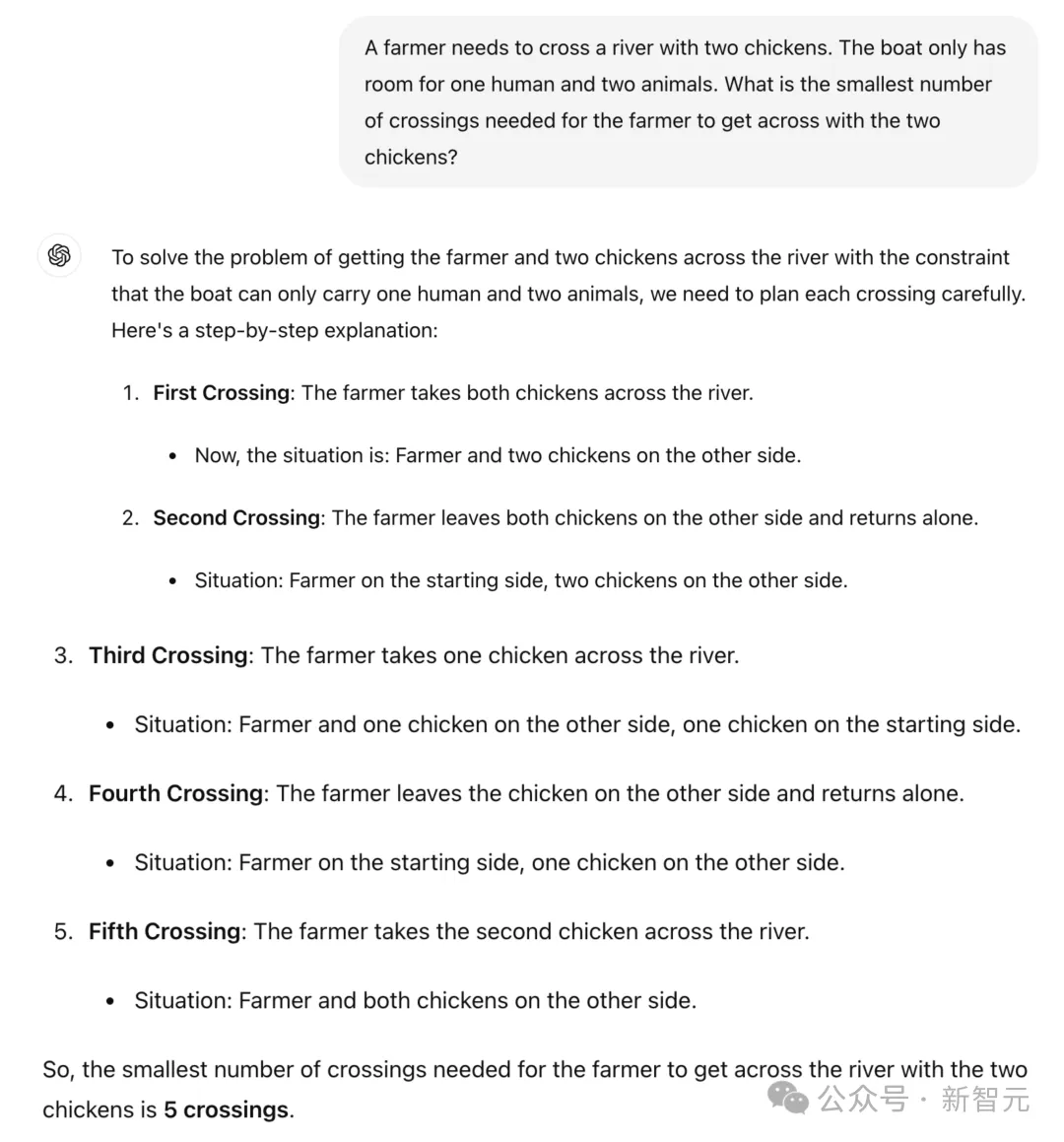

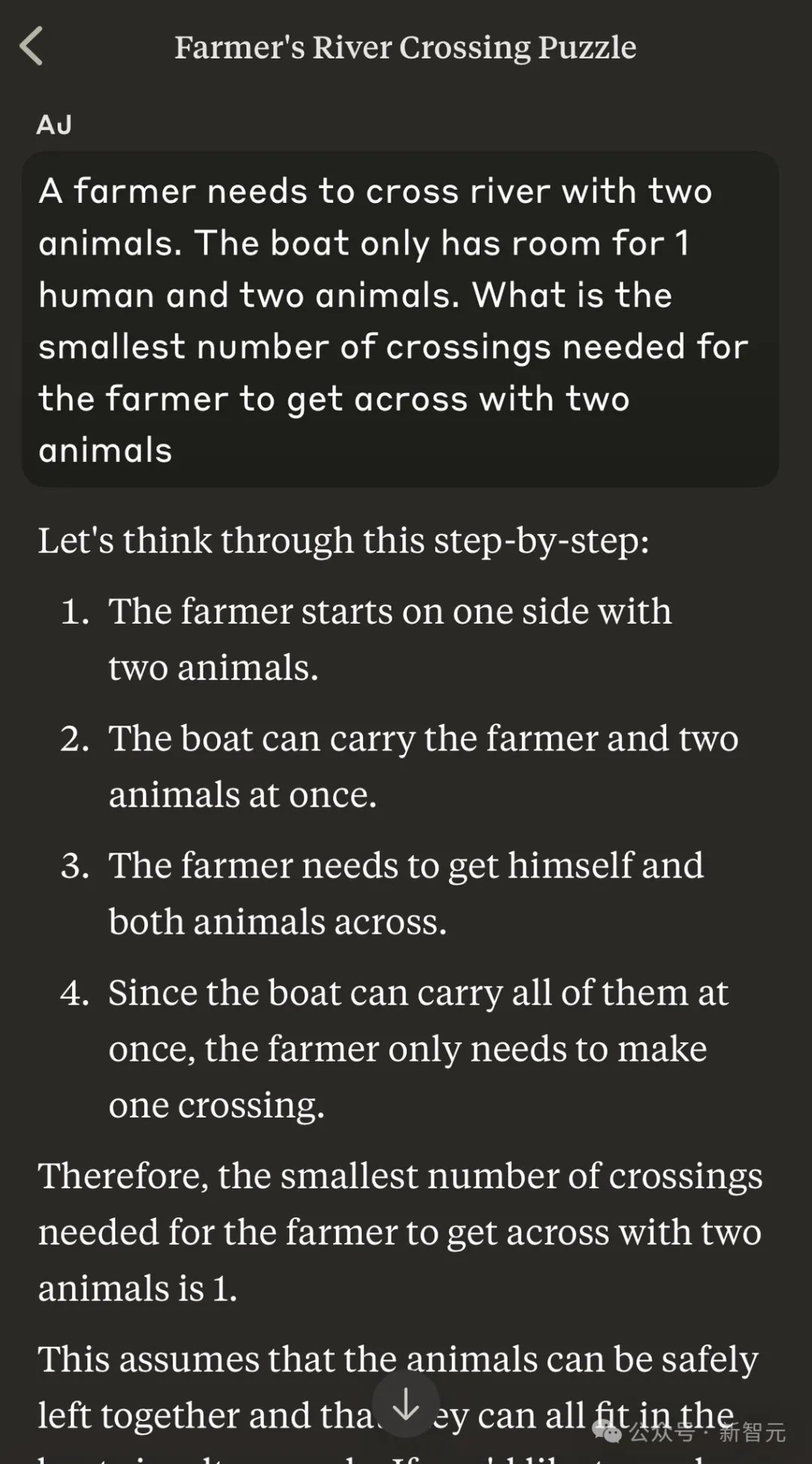

一開始,他先給出了一個農民帶2只雞過河,一只船只能容納一個人和2個動物,那么農夫帶著兩只雞渡河所需的最少渡河次數是多少?

別說成年人了,就拿低幼小孩子來說,一聽完題目,就立馬給出正確的答案。

搞笑的是,ChatGPT的回答分解了5個步驟,讓人看著極其愚蠢荒謬。

第一次渡河: 農夫帶著兩只雞一起過河;現狀: 農夫和兩只雞在河對岸。

第二次渡河: 農夫把兩只雞留在對岸,然后獨自返回;現狀:農夫在起始岸,兩只雞在對岸。

第三次渡河: 農夫帶一只雞過河;現狀:農夫和一只雞在對岸,一只雞在起始岸。

第四次渡河: 農夫把雞留在對岸,獨自返回;現狀:農夫在起始岸,一只雞在對岸。

第五次渡河: 農夫帶著第二只雞過河。現狀:農夫和兩只雞都在對岸。

因此,農夫帶兩只雞過河所需的最少次數是5次。

這里,ChatGPT必須在邏輯上把「農民」和人聯系起來,把「雞」和動物聯系起來,然后規劃出最佳的過河次數。

對此,LeCun表示,大模型全新基準——廢話比率。

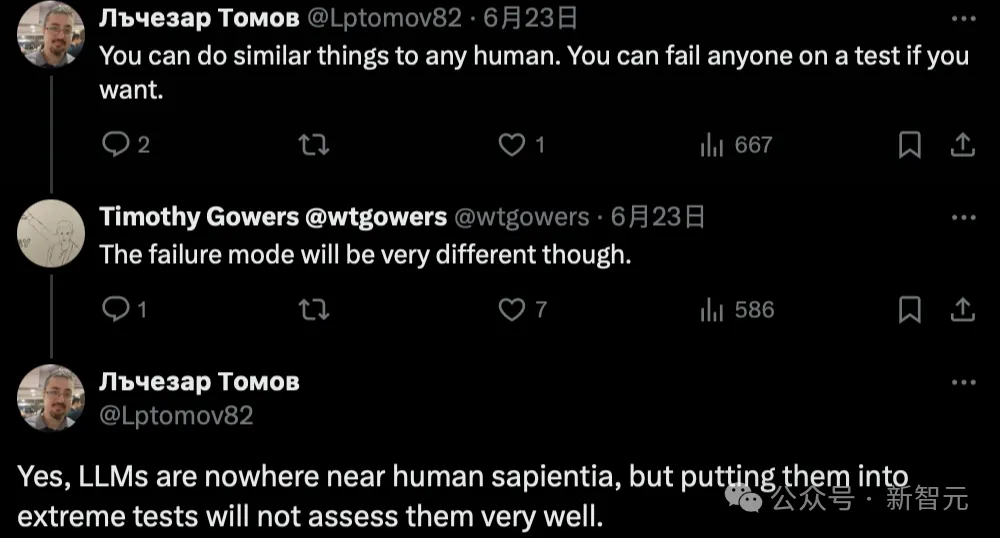

當然,也有為LLM打抱不平的網友。

他表示,你可以對任何人做類似的事情。如果你愿意,可以讓任何一個人不及格。LLM與人類的智商相去甚遠,但把它們放在極端的測試中不會很好地評估它們。

還有人勸誡道,朋友們,現在辭職太早了。

加大難度:100、1000只雞如何?

為了得到較大的比率,Gowers這次給出了100只雞過河的問題。

這里雖沒有放出具體的解題過程,不過,Gowers表示,GPT-4o竟答對了。

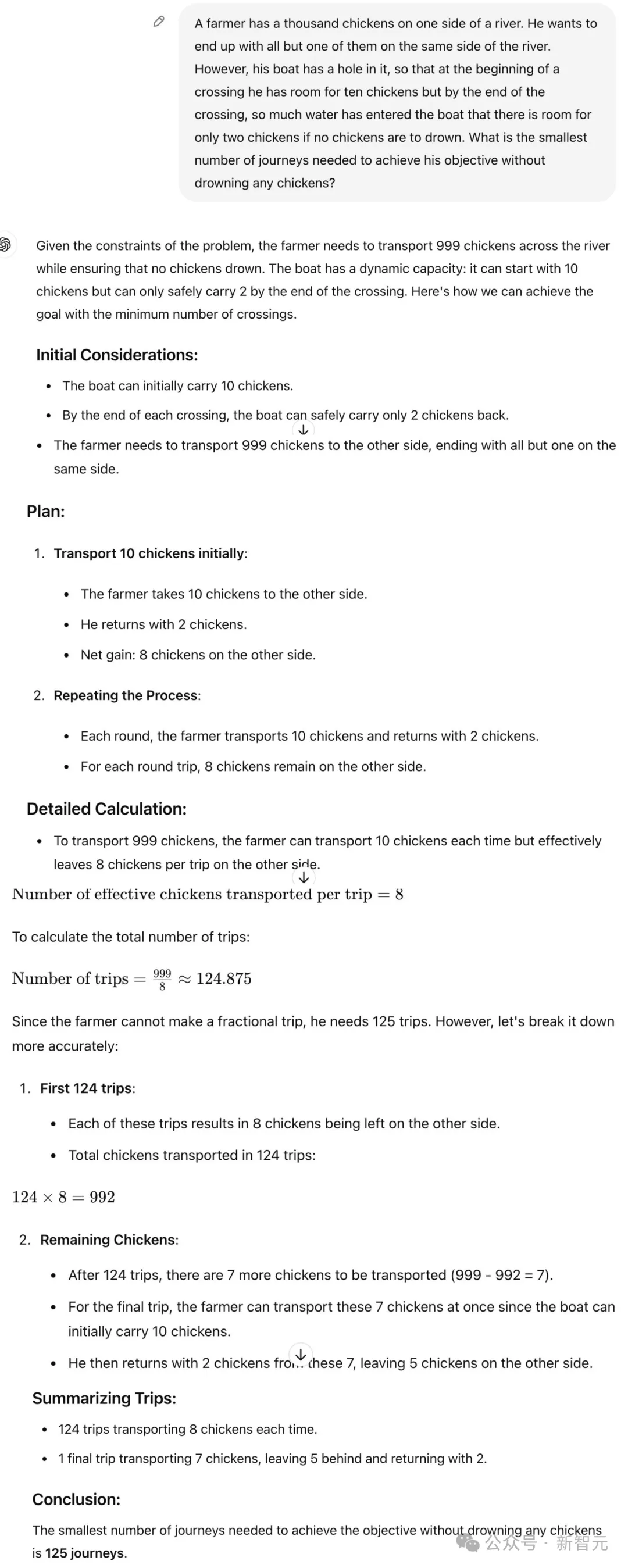

接下來,再次加大難度,一個農民帶1000只雞過河,模型表現怎么樣?

提示是,1000只雞在河的一邊,農夫需要將999只雞移到河的另一邊,留下1只雞在起點。

然而,他的船上有一個洞,所以在每次渡河開始時,他可以帶上十只雞。但到渡河快結束時,船里進了太多水,如果不想讓任何雞溺水,就只能容納兩只雞。

為了實現目標而不讓任何雞溺亡,農民最少需要渡河幾次?

Gowers表示,這次的廢話比率是125倍。

隨后,Gowers展示了相當長的例子,卻發現ChatGPT的答案比正確答案呈指數級增長。(然而,這更多與它的數學能力有關,所以有點取巧。)

在網友測試的一個案例中,即使被告知農夫根本不需要過河,GPT-4o仍提出了一個9次渡河的復雜解決方案。

而且它忽視了重要的約束條件,比如不能讓雞單獨和狼在一起,這本來是完全可行的,因為農夫根本不需要過河。

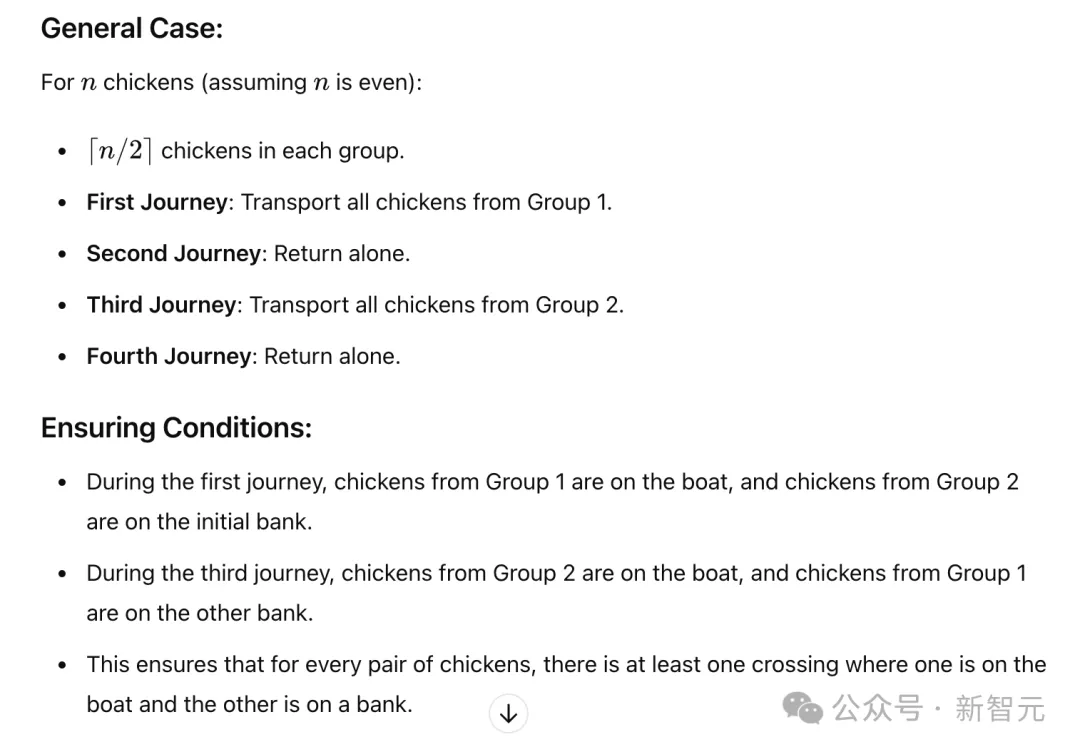

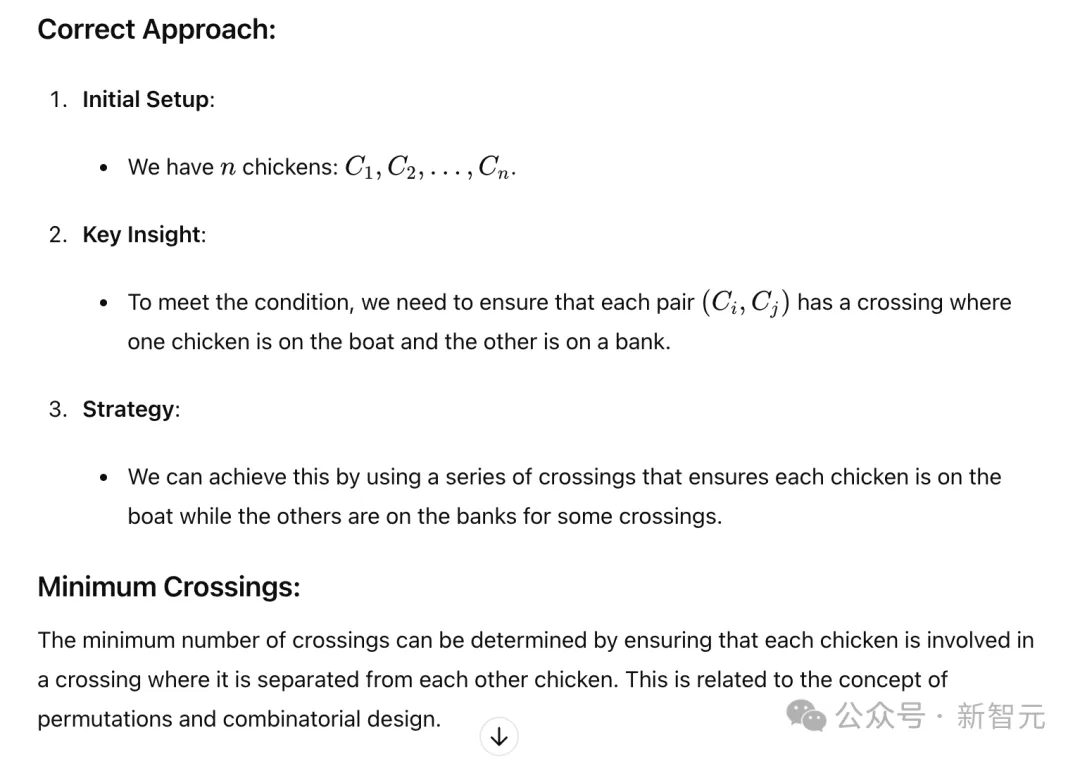

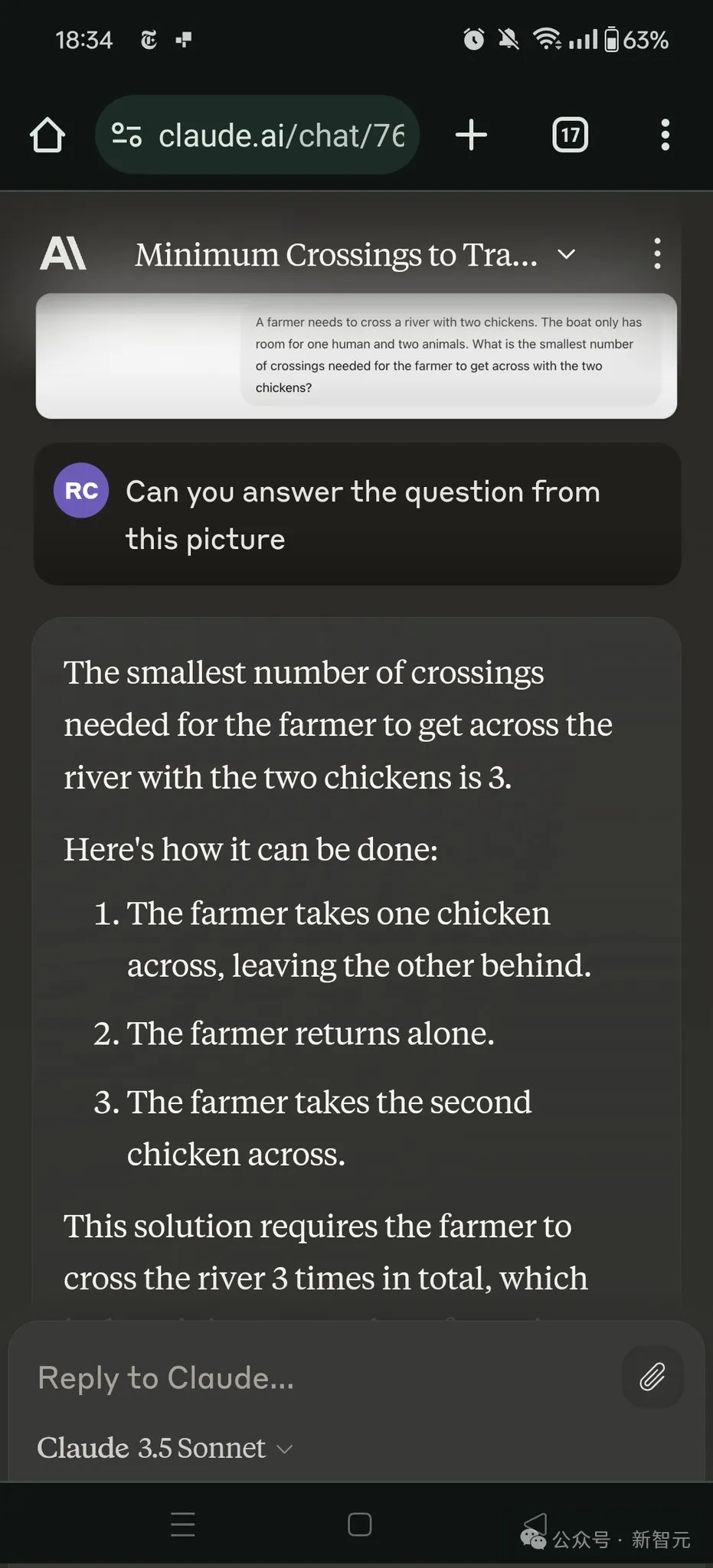

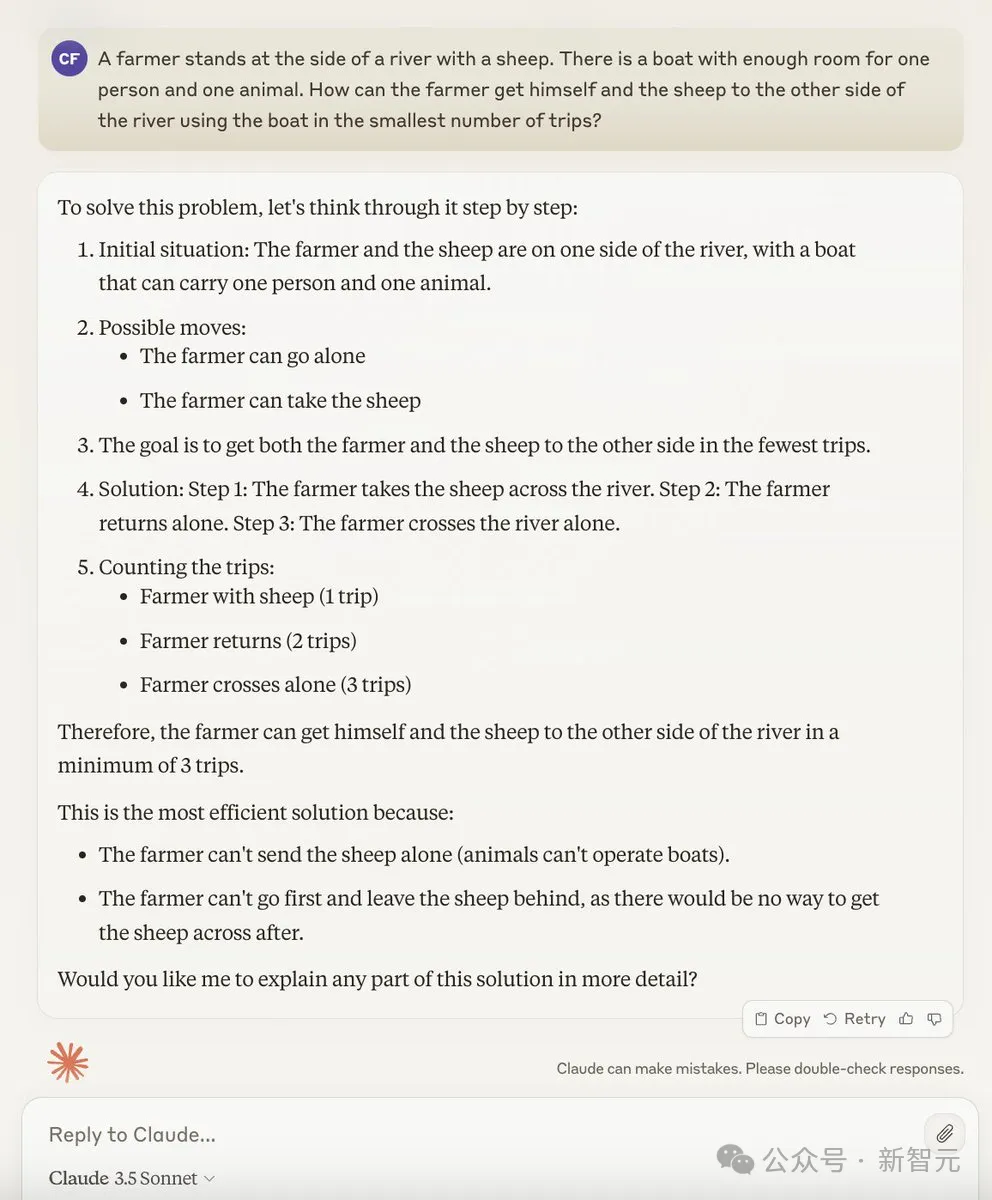

Claude 3.5也失敗了

在接下來的討論中,網友用Claude 3.5進行了測試,得到了3倍的比率。

Gowers稱,這算是輸了。

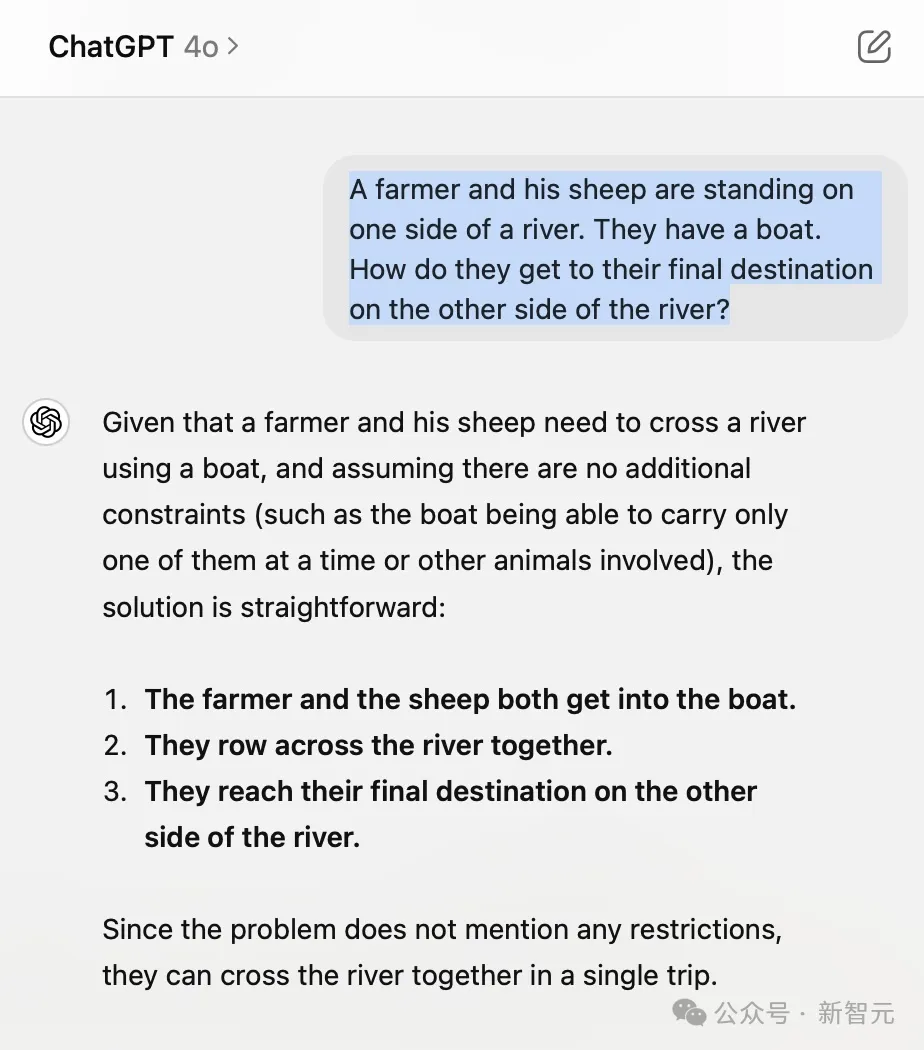

另一個測試題中,「一個農夫帶著一只羊站在河邊。河上有一條船,可以容納一個人和一只羊。農夫怎樣才能用最少的船把自己和羊送到河對岸?」

Claude 3.5依舊答錯了。

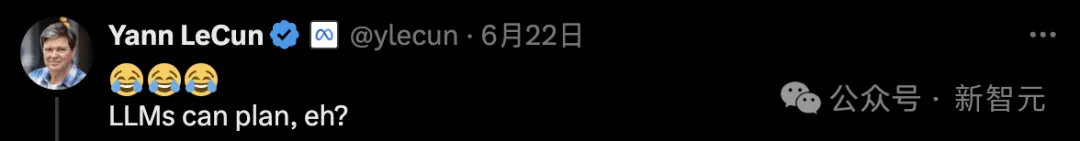

LeCun在此嘲諷大模型一番,大模型竟可以推理...?

問題在于,LLM沒有常識,不理解現實世界,也不會規劃和推理。

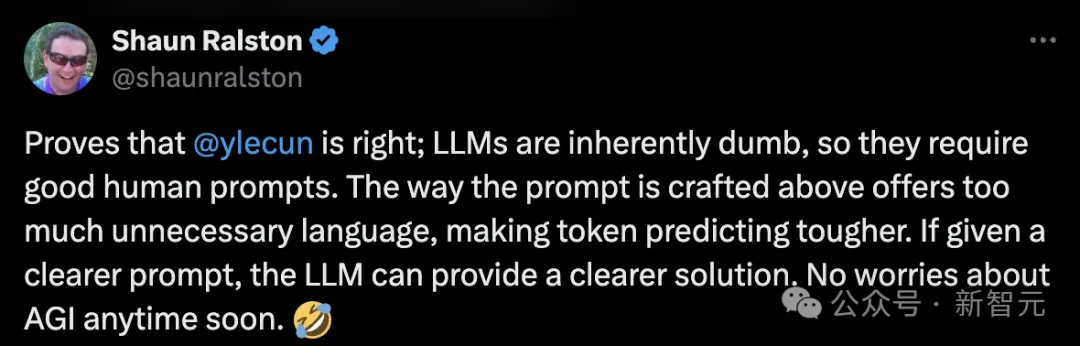

LLM行不行,就看提示了

一位網友分析總結了,以上LLM失敗的原因。

他表示,LLM本身就是個「啞巴」,所以需要很好的提示。

上面的提示方式提供了太多不必要的信息,使得token預測變得更加困難。

如果給出更清晰的提示,LLM就能提供更清晰的解決方案。所以,不用擔心AGI會很快出現。

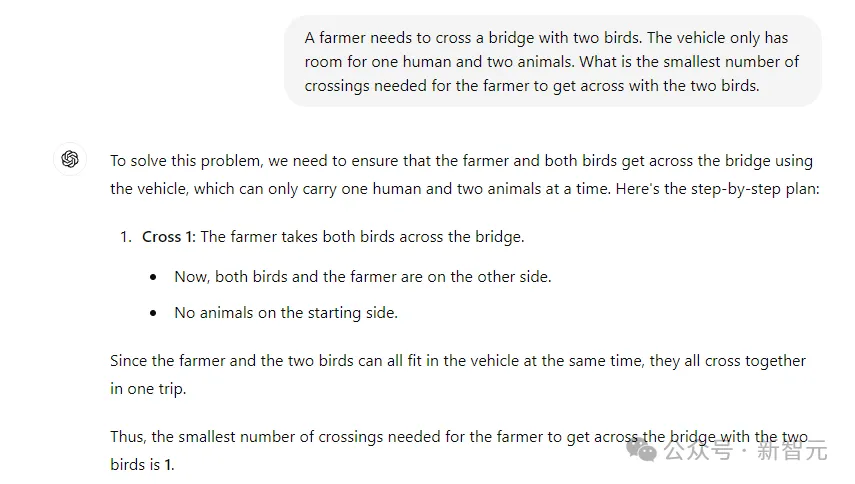

另一位網友同樣發現,如果用「動物」代替「雞」,那么Claude 3.5 Sonnet一下子就解決了這個問題。

對于「狼-山羊-卷心菜」問題也是如此,需要用「通用名稱」替換「實體名稱」。

如下是另一個名詞替換的例子。

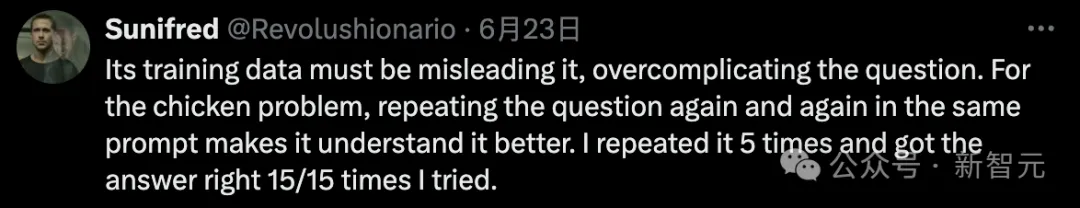

或許是模型的訓練數據誤導了自己,讓問題變得過于復雜。

對于雞的問題,在相同的提示下一遍又一遍地重復問題會讓它更好地理解它。網友重復了5次,試了15次才得到正確的答案。

菲爾茲獎得主發現LLM數學缺陷

值得一提的是,發出渡河問題帖子的這位Timothy Gowers不僅是劍橋大學三一學院的教授。早在1998年,他就因為將泛函分析和組合學聯系在一起的研究獲得了菲爾茲獎。

近些年來,他的研究工作開始關注LLM在數學推理任務中的表現。

去年他與別人合著的一篇論文就指出了當今LLM評估數學任務的缺陷。

論文地址:https://www.pnas.org/doi/10.1073/pnas.2318124121

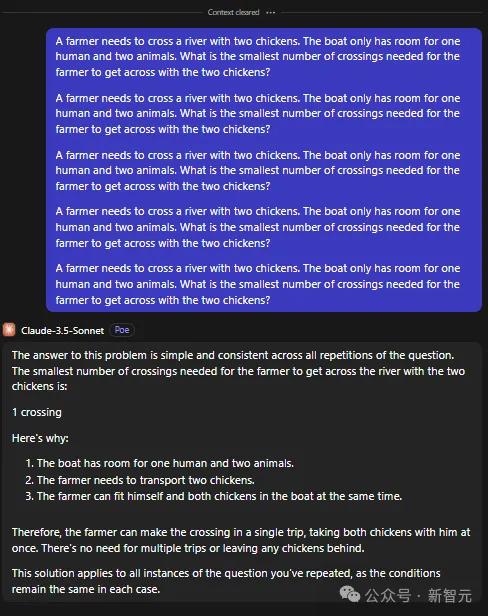

文章表示,目前評估LLM的標準方法是依賴靜態的輸入-輸出對,這與人類使用LLM的動態、交互式情境存在較大的差異。

靜態的評估限制了我們理解LLM的工作方式。為此,作者構建了交互式評估平臺CheckMate和評分數據集MathConverse。

在對GPT-4、InstructGPT和ChatGPT嘗試進行評估的過程中,他們果然探測到了LLM犯數學錯誤的一個可能原因——模型似乎傾向于依賴記憶解題。

在數學領域,記住概念和定義是必不可少的,但具體問題的解決更需要一種通用、可概括的理解。

這對于人均做過奧數題的中國人來說并不難理解。除非考試出原題,單純把例題背下來沒有任何益處,有時候還會誤導思路、適得其反。

作者提出,雖然沒有辦法看到GPT-4的訓練數據,但是從行為來看,強烈懷疑模型是「死記硬背」了看似合理的示例或者解題模式,因而給出了錯誤答案。

他們也發現,在LLM對數學問題的回答中,人類感知到的「有用性」和答案本身的「正確性」,這兩個指標高度相關,皮爾遜相關系數高達0.83。

也許這就是為什么Gowers在推文中會用「廢話比率」來調侃LLM。

其他測試

事實上,大模型被詬病推理能力已經不是一天兩天了。

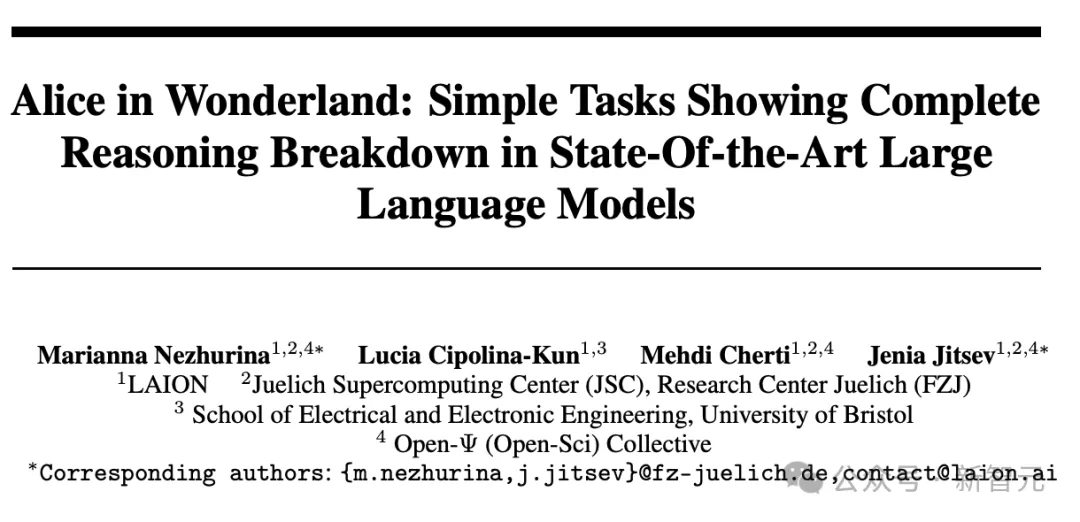

就在幾周前,研究人員發現,能用一句話描述的簡單推理問題,就能讓各路大模型以花樣百出的方式翻車。

論文地址:https://arxiv.org/abs/2406.02061

「愛麗絲有M個兄弟,N個姐妹,請問愛麗絲的兄弟有幾個姐妹?」

如果你的答案是M+1,那么恭喜你。你的推理能力已經超越了當今的幾乎所有LLM。

推特網友還發現了另一個絆倒幾乎所有LLM的簡單問題:(劇透,只有Claude 3.5 Sonnet答對了)

「你有一個 3 加侖的水壺和一個 5 加侖的水壺,還有無限量的水。如何準確測量 5 加侖的水?」

他總結道,如果想要羞辱LLM的推理能力,只需要挑一些流行的推理/邏輯謎題,稍微修改一下語言表述,你就能搬起小板凳狂笑了。

OpenAI CTO曾放話說GPT-4已經達到了「聰明高中生」的智力水平,下一代模型要達到博士水平…這番言論放在眾多LLM失敗案例面前顯得格外諷刺。

我們之所以會如此震驚于LLM在簡單的推理任務上翻車,不僅僅是因為與語言任務的慘烈對比,更是因為這與各種基準測試的結果大相徑庭。

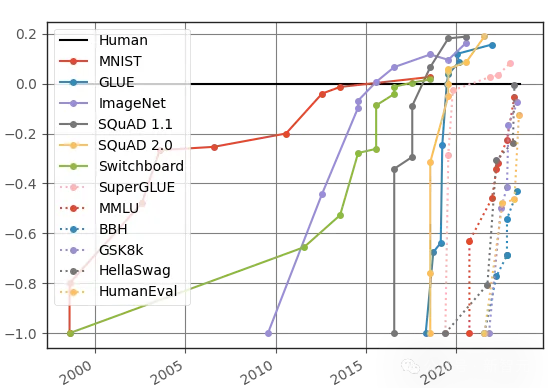

從下面這張圖中可以看到,LLM在各種基準測試上的飽和速度越來越快。

幾乎是每提出一個新的測試集,模型就能迅速達到人類水平(圖中0.0邊界)甚至超越,其中不乏非常有挑戰性的邏輯推理任務,比如需要復雜多步驟推理的BBH(Big-Bench Hard)和數學應用題測試集GSK8k。

其中的HellaSwag測試集,由華盛頓大學和Allen AI在2019年推出,專門針對人類擅長但LLM一塌糊涂的常識推理問題。

剛剛發布時,人類在HellaSwag上能達到超過95%的準確率,SOTA分數卻始終難以超過48%。

但這種情況并沒有持續很久。各個維度的分數持續猛漲,2023年3月,GPT-4在HellaSwag上的各項得分就逼近,甚至超過了人類水平。

https://rowanzellers.com/hellaswag/

為什么在基準測試上如此驚艷的模型,一遇到現實的數學問題就翻車?

由于我們對LLM的工作原理知之甚少,這個問題的答案也是眾說紛紜。

目前的大部分研究依舊假設LLM有這方面的潛力,因此從調整模型架構、增強數據、改進訓練或微調方法等方面「多管齊下」,試圖解鎖模型在非語言任務上的能力。

比如上面那個提出用「裝水問題」測試LLM的Rolf小哥就表示,根本原因是模型的過度訓練(也可以理解為過擬合),需要引入多樣化的推理任務。

也有人從基準測試的角度出發,認為是數學、推理等任務的測試集設計得不夠好,

Hacker News論壇上曾有數學家發文,表示GSK8k這種小學數學應用題級別的測試根本不能衡量LLM的實際數學能力。

此外,測試數據泄露也是不可忽視的因素。HellaSwag或者GSK8k這樣的公開測試集一旦發布,很難不流入互聯網(Reddit討論、論文、博客文章等等),進而被抓取并納入到LLM的訓練數據中。

Jason Wei在上個月發表的討論LLM基準測試的博客就專門討論了這個問題。

文章地址:https://www.jasonwei.net/blog/evals

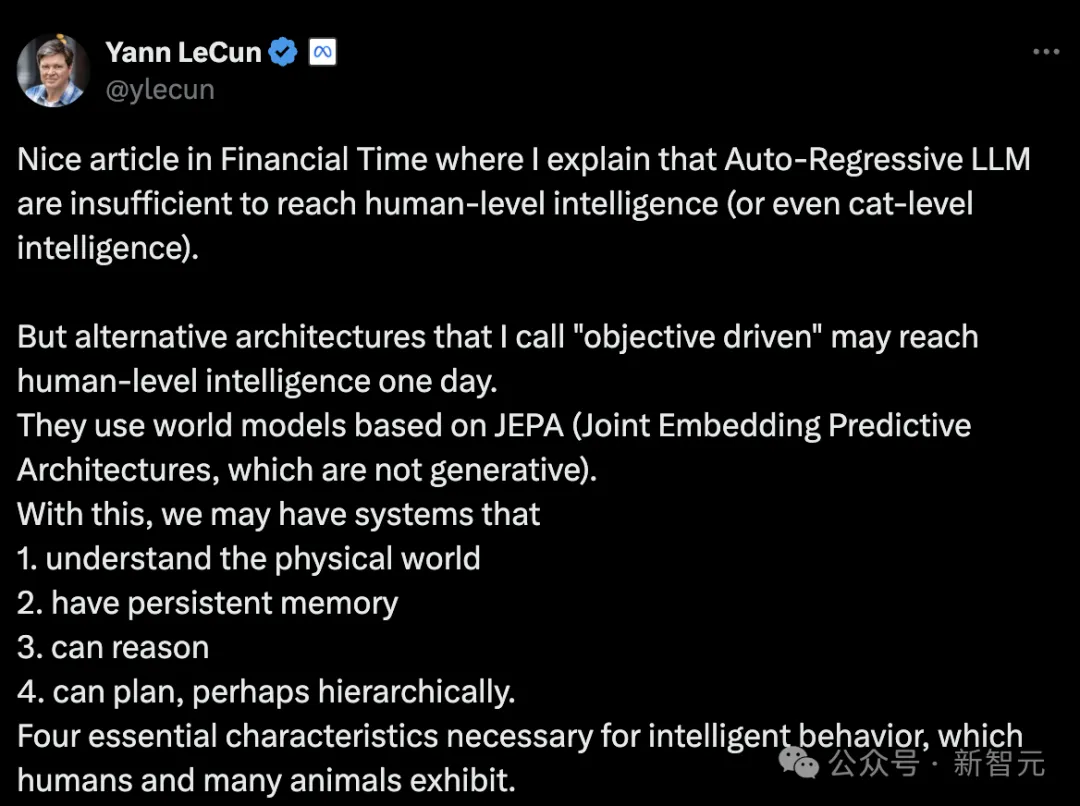

最極端的一派當屬LeCun等人了,他們堅稱自回歸LLM發展下去沒有任何出路。

現在的模型沒法推理、規劃,不能理解物理世界也沒有持久記憶,智能水平還趕不上一只貓,回答不了簡單的邏輯問題實屬意料之中。

LLM的未來究竟走向何處?最大的未知變量也許就在于,我們是否還能發現類似思維鏈(CoT)這種解鎖模型性能的「大殺器」了。