AI 黑箱難題怎么破?神經網絡模型算法給你答案

現在對于AI 完成某項任務已不是什么新鮮事,畢竟在工業、醫療、農業等諸多方面都大放異彩。最近,機器人的大腦又不斷被開發,不但開始擁有好奇心來驅動自學,而且還像人們解釋為什么作出了某些決策?機器人發展將迎來質的飛躍。

“我們需要質疑為什么算法程序會做出這樣那樣的決定,如果我們不在 AI 動機解釋上花功夫,就無法信任這個智能系統。”卡內基梅隆大學計算機科學教授 Manuela Veloso表示說。

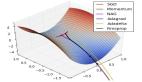

據了解, 創業公司 OptimizingMind 發明了一項能觀察智能機器決策過程的技術。 這個算法的目的是創造“透明訪問”系統,以呈現機器學習是如何做出預期的。OptimizingMind的負責人 Tsvi Achler 說:“該系統以人腦的神經模型為基礎,能把任何深度網絡轉化為該系統的模式。它的目的是探索 AI 行為的潛在預期,并且找出 AI 思維模式的哪個方面對決策影響***”。

“我感興趣的是,大腦和計算機的共同點在哪里?為什么人腦可以在學會任何模型之后把它解釋出來。如果我說 ‘章魚’,你是否能告訴我那是什么?如果我問章魚觸手長什么樣,你能告訴我嗎?”

當然AI與人類大腦的主要區別之一在于:我們會條件反射地自主去學習,而AI則要有一系列的程序輸入,而且牽一發動全身。這種靈活性與自主性對于AI來說還有很大的潛力可以突破。

此外,這個系統的“透明訪問“也十分炫酷。這個系統提供了一種實時觀察 AI 決策的方法,抓取重點信息上節省大量的時間。它可以程師們大幅減少機器開發的時間,幫企業節省資源。Achler 還表示,在提供透明度之外,這個算法還可以被修改。不但預期(expectations)能被表達出來,每個單獨預期還能隨著新信息立刻改變。

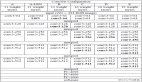

今天,大多數機器學習的方法使用一個正反饋技術。風險投資公司 Naiss.io 的聯合創始人 Ed Fernandez 說,正反饋使用優化過的權重執行任務。在正反饋系統里,獨特性信息依據訓練中出現的頻率被錄入權重。這意味著整套訓練中的權重必須經過優化。這又意味著可以“根據正在被識別的模式執行優化”,這不是為了權重而優化,而是為了模式識別去優化。

如今,在機器人與商業捆綁日益緊密之時,更加智能細分的機器人已成時下必需,如果能在機器人行動動機上有所突破,那么,未來我們看到的將不再是答非所問跑題王,也不是獨臂行天下的低能機器人,而是心靈手巧,知錯能改的機器人。